Préparer les data centers pour l'avenir : anticiper les racks IA de 2MW+ et l'intégration quantique

Mise à jour le 8 décembre 2025

Mise à jour de décembre 2025 : Le GB200 NVL72 à 120kW/rack est désormais disponible — le chiffre de 2,4MW était une projection pour les configurations futures. Le Vera Rubin NVL144 vise 600kW par rack d'ici 2026. Le refroidissement liquide (le direct-to-chip détenant 47% de parts de marché) est désormais obligatoire pour l'infrastructure IA. Les fournisseurs de colocation (Colovore, QTS, Equinix) se disputent le support des densités de 150-200kW. Des partenariats nucléaires SMR ont été annoncés par Amazon, Google et Microsoft pour un total de plus de 10 milliards de dollars. La demande énergétique des data centers augmentera de 165% d'ici 2030 pour les charges de travail IA.

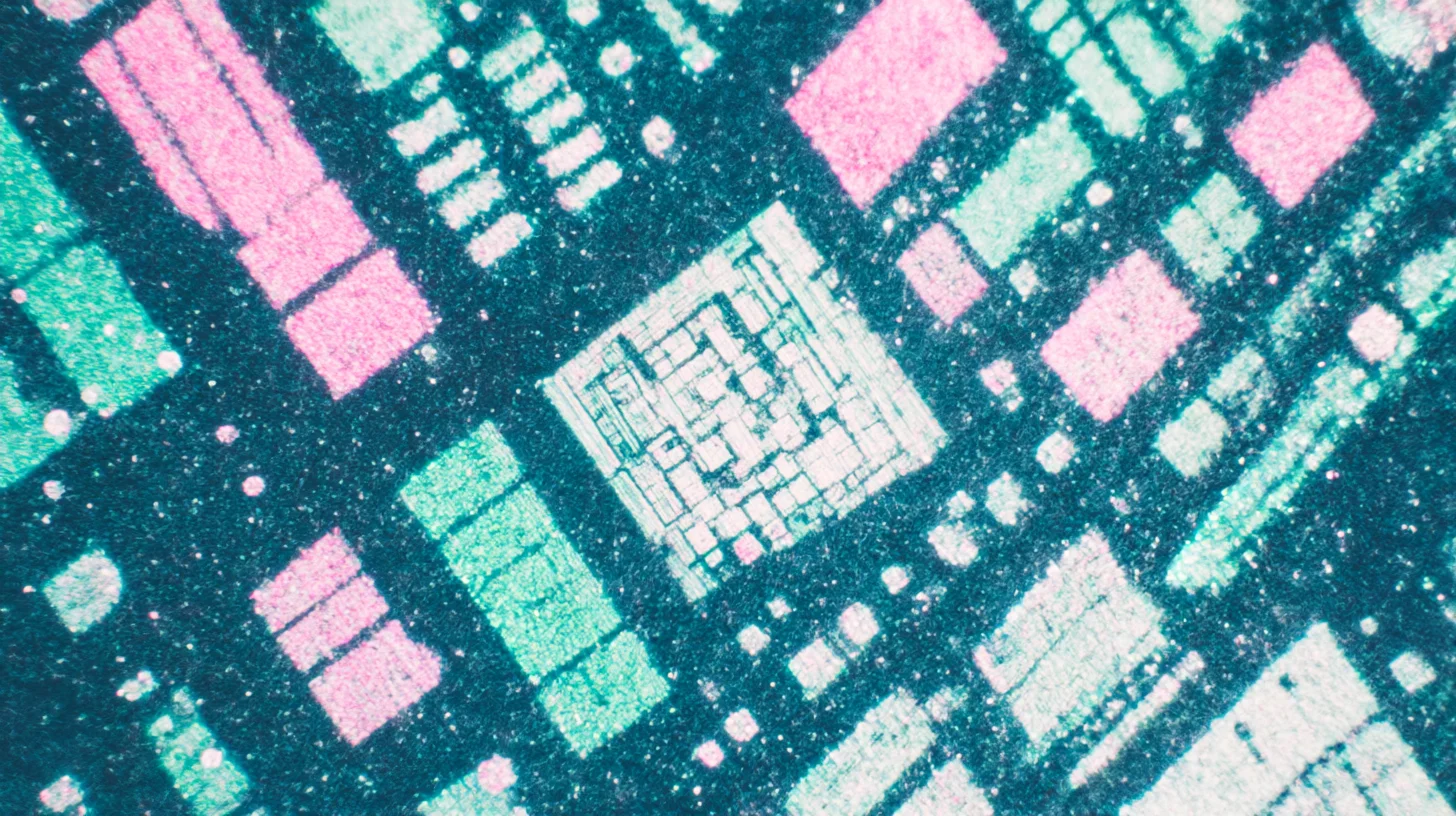

Le rack NVIDIA GB200 NVL72 consommant 2,4MW de puissance, les systèmes hybrides quantiques-classiques d'IBM nécessitant un refroidissement au millikelvin, et les projets de Microsoft pour des data centers sous-marins supportant des charges de 5MW démontrent l'évolution radicale des infrastructures requise pour l'informatique de nouvelle génération. Avec des densités de puissance multipliées par 10 tous les 5 ans, des ordinateurs quantiques nécessitant des réfrigérateurs à dilution, et des processeurs photoniques fonctionnant à température ambiante, les data centers doivent se préparer à des environnements de calcul hétérogènes sans précédent. Les développements récents incluent le refroidissement liquide gérant 2MW par rack, des bancs d'essai de réseaux quantiques s'étendant sur plusieurs continents, et des puces neuromorphiques nécessitant de nouvelles architectures. Ce guide complet examine les stratégies de préparation à l'avenir pour les data centers, couvrant l'alimentation et le refroidissement ultra-haute densité, l'intégration quantique, les paradigmes de calcul émergents, et les infrastructures conçues pour 2030 et au-delà.

Évolution de l'infrastructure électrique

L'infrastructure de racks multi-mégawatts pousse les systèmes électriques à leurs nouvelles limites. Les racks GB200 de 2,4MW nécessitent une alimentation triphasée 480V à 3 000 ampères. La distribution par barres conductrices remplace le câblage traditionnel en raison des exigences de courant. Les appareillages de commutation dimensionnés pour 5 000 ampères deviennent standard. Les transformateurs sont dimensionnés à 100MVA pour les installations individuelles. La redondance atteint 2N+1 pour les systèmes critiques. La correction du facteur de puissance est obligatoire à ces échelles. L'infrastructure électrique de l'installation nouvelle génération de Meta supporte 5MW par emplacement de rack.

La distribution en moyenne tension rapproche l'alimentation du calcul. La distribution 15kV vers les rangées de racks réduit les besoins en cuivre de 90%. Les transformateurs à semi-conducteurs permettent une régulation dynamique de la tension. La distribution DC à 380V améliore l'efficacité de 10%. La conversion de puissance au niveau du rack minimise les pertes. Les PDU intelligents gèrent des charges de 500kW. Les limiteurs de courant de défaut préviennent les défaillances en cascade. La moyenne tension dans la dernière installation de Google délivre 200MW à l'étage de calcul.

L'intégration du stockage d'énergie assure stabilité et efficacité. Les systèmes de batteries dimensionnés à 50MWh pour le maintien et l'écrêtage des pointes. Le stockage par volant d'inertie gère les charges transitoires. Les supercondensateurs pour une réponse à la microseconde. Les onduleurs formant le réseau permettent un fonctionnement en îlotage. Les piles à combustible à hydrogène pour une alimentation de secours prolongée. Le stockage thermique pour le délestage de la charge de refroidissement. Les systèmes de stockage chez Microsoft fournissent 48 heures de fonctionnement autonome.

L'intégration des énergies renouvelables devient obligatoire à grande échelle. Le solaire sur site génère 50MW en pointe. Des éoliennes là où la géographie le permet. La géothermie pour le refroidissement et la production d'électricité. Le biogaz issu des processus de récupération de chaleur. Les petits réacteurs modulaires en cours d'évaluation. La capture de carbone pour les émissions résiduelles. L'infrastructure renouvelable d'Amazon atteint un fonctionnement 100% sans carbone en Oregon.

Des mises à niveau de l'infrastructure réseau sont nécessaires pour les installations de l'ordre du gigawatt. Des sous-stations dédiées à 230kV ou plus. Des alimentations multiples depuis différents réseaux. La construction de lignes de transmission nécessaire. Des services de stabilité du réseau fournis. Participation aux programmes de réponse à la demande. Des contrats d'achat d'électricité sur plusieurs décennies. L'intégration au réseau en Virginie du Nord nécessite une nouvelle sous-station 500kV pour un campus de 2GW.

Révolution des systèmes de refroidissement

Le refroidissement liquide direct devient obligatoire pour les racks mégawatts. Des plaques froides sur chaque puce évacuant 2kW chacune. Des unités de distribution de liquide de refroidissement gérant 500kW par rack. Des collecteurs dimensionnés pour 1 000 gallons par minute. Des systèmes de détection de fuites prévenant les défaillances catastrophiques. La chimie du liquide de refroidissement prévenant la corrosion et la croissance biologique. Tests de pression à 200 PSI en standard. Le refroidissement liquide Lenovo Neptune gère 3MW par rack efficacement.

Le refroidissement par immersion permet les densités les plus élevées. L'immersion biphasée atteignant 250kW par mètre carré. Des fluides diélectriques avec une capacité thermique 1 400 fois supérieure à l'air. Des cuves contenant 50 serveurs chacune. Des systèmes de conditionnement du fluide maintenant la pureté. Des systèmes de récupération de vapeur prévenant les pertes. Des systèmes d'extinction d'incendie spécialisés. Les systèmes d'immersion chez Microsoft réduisent l'énergie de refroidissement de 95%.

Le refroidissement par réfrigérant gère les densités thermiques extrêmes. Le refroidissement par réfrigérant direct sur puce évacuant 5kW par puce. Le refroidissement par changement de phase maximisant le transfert thermique. Les systèmes à réfrigérant pompé éliminant les compresseurs. Les réfrigérants naturels conformes aux réglementations environnementales. Les échangeurs de chaleur à micro-canaux maximisant l'efficacité. Le débit de réfrigérant variable s'adaptant aux charges. Le refroidissement par réfrigérant chez Intel atteint des températures de puce inférieures à 50°C à 1kW.

Les systèmes de récupération de chaleur transforment les déchets en ressources. Le liquide de refroidissement haute température permettant le chauffage urbain. Les refroidisseurs à absorption fournissant du froid à partir de la chaleur résiduelle. Le cycle organique de Rankine générant de l'électricité. Le chauffage direct de l'air pour les bâtiments. Les applications agricoles pour les serres. La récupération de chaleur industrielle. La récupération de chaleur des data centers de Stockholm chauffe 30 000 foyers.

L'architecture de distribution du refroidissement s'adapte aux densités extrêmes. Boucles primaires au niveau du bâtiment. Boucles secondaires par salle. Boucles tertiaires par rack. CDU tous les 4 racks. Systèmes de pompage redondants. Optimisation du débit variable. Vannes d'isolement automatisées. La distribution chez Facebook gère efficacement 500MW de rejet thermique.

Intégration de l'informatique quantique

Les réfrigérateurs à dilution créent des défis d'infrastructure sans précédent. Des systèmes de 3 mètres de haut atteignant 10 millikelvins. Des systèmes de circulation d'hélium-3 complexes. Isolation des vibrations au niveau du nanomètre. Blindage magnétique au niveau du nanotesla. Environnements de salle blanche requis. Conditionnement d'alimentation spécialisé nécessaire. L'infrastructure quantique d'IBM héberge 20 systèmes quantiques dans une seule installation.

Les systèmes de distribution cryogénique desservent plusieurs processeurs quantiques. Centrales de liquéfaction d'hélium centralisées. Réseaux de distribution parfaitement isolés. Systèmes de récupération capturant tout l'hélium. Purification maintenant une pureté de 99,999%. Stockage pour les interruptions d'approvisionnement. Systèmes de secours prévenant le réchauffement. L'infrastructure cryogénique de Google Quantum AI supporte 100 processeurs quantiques.

Les interfaces classique-quantique permettent le calcul hybride. Systèmes de contrôle micro-ondes pour les qubits. Électronique à température ambiante interfaçant. Liaisons de données haute vitesse entre systèmes. Synchronisation maintenant la cohérence. Correction d'erreurs dans le domaine classique. Partitionnement algorithmique optimisé. La conception d'interface chez Rigetti permet une exécution hybride transparente.

L'infrastructure de réseau quantique connecte les processeurs quantiques. Répéteurs quantiques tous les 50km. Réseaux de distribution d'intrication. Systèmes de mémoire quantique. Détecteurs de photons uniques. Équipements de conversion de longueur d'onde. Canaux de contrôle classiques en parallèle. Le réseau quantique de l'Université de Chicago s'étend sur 200km.

Les exigences environnementales dépassent les normes actuelles. Vibrations inférieures à 1nm RMS. Stabilité de température ±0,001K. Interférences électromagnétiques inférieures à -140dBm. Bruit acoustique inférieur à 40dB. Contrôle d'humidité ±1%. Salle blanche de classe 1. Le contrôle environnemental au MIT Lincoln Laboratory permet une fidélité des qubits de 99%.

Paradigmes de calcul émergents

L'informatique neuromorphique nécessite de nouvelles architectures. Le traitement événementiel réduisant la consommation d'un facteur 1000. Le fonctionnement asynchrone éliminant les horloges. Les matrices de memristors pour les poids synaptiques. Les architectures de puces 3D imitant la structure du cerveau. Les protocoles de communication basés sur les impulsions. Les réseaux plastiques s'adaptant continuellement. Les systèmes neuromorphiques Intel Loihi traitent les données sensorielles en temps réel.

Les processeurs photoniques fonctionnent à la vitesse de la lumière. La photonique sur silicium éliminant la conversion électrique. Le multiplexage en longueur d'onde pour le parallélisme. Les interconnexions optiques entre puces. L'optique en espace libre pour certaines applications. Les lasers intégrés sur puce. Le fonctionnement cryogénique pour certains composants. L'informatique photonique chez Lightmatter atteint une amélioration de l'efficacité de 10x.

Le stockage ADN répond aux exigences à l'échelle de l'exaoctet. Les systèmes de synthèse écrivant des données dans l'ADN. Les systèmes de séquençage relisant. Une densité de 1 exaoctet par millimètre cube. Une durabilité à l'échelle du millénaire. Des capacités d'accès aléatoire en développement. La correction d'erreurs intégrée. Le stockage ADN chez Microsoft stocke avec succès 200Mo dans l'ADN.

La renaissance de l'informatique analogique pour des charges de travail spécifiques. Les solveurs d'équations différentielles instantanés. Les problèmes d'optimisation accélérés. L'inférence des réseaux neuronaux efficace. Les systèmes hybrides numériques-analogiques. Les limitations de précision acceptables. Les paradigmes de programmation différents. L'informatique analogique chez Mythic atteint 10TOPS par watt.

Le continuum edge-cloud nécessite une infrastructure distribuée. Des micro data centers aux antennes-relais. Des nœuds edge dans les points de vente. Des couches de fog computing. Des stations au sol satellitaires. Des nœuds edge véhiculaires. L'informatique embarquée sur drone. L'infrastructure edge d'AWS Wavelength couvre 100 villes.

Flexibilité de l'infrastructure

Les conceptions modulaires permettent une adoption technologique rapide. Des empreintes de rack standardisées accueillant différentes technologies. Des connexions d'alimentation et de refroidissement universelles. Des fabrics réseau reconfigurables. Des agencements d'étage adaptables. Un espace d'expansion réservé. Le rafraîchissement technologique simplifié. La conception modulaire chez Switch permet une reconfiguration complète en 30 jours.

L'infrastructure multi-physique supporte l'informatique hétérogène. Le refroidissement par air pour les serveurs standard. Le refroidissement liquide pour les GPU. L'immersion pour la plus haute densité. Le cryogénique pour le quantique. Les salles blanches pour les systèmes spécialisés. Les environnements isolés pour la sécurité. La conception multi-physique au CERN supporte 20 technologies de calcul différentes.

Les espaces convertibles s'adaptent aux exigences changeantes. Les planchers techniques amovibles pour les équipements lourds. Les hauteurs sous plafond accueillant les systèmes de grande taille. L'infrastructure électrique surdimensionnée. La capacité de refroidissement extensible. Les chemins de câbles réseau accessibles. La capacité structurelle excessive. La conception convertible chez Equinix permet une reconfiguration de 100% de l'espace.

Les points d'insertion technologique permettent des mises à niveau transparentes. Des points de prise électrique tous les 10MW. Des points de connexion de refroidissement standardisés. Des points d'agrégation réseau distribués. De l'espace réservé pour les nouvelles technologies. Des chemins surdimensionnés de 200%. Une documentation complète. Les points d'insertion chez Digital Realty permettent l'adoption technologique sans perturbation.

La planification du démantèlement intégrée à la conception. Des chemins d'évacuation d'équipements dégagés. Des capacités de recyclage sur site. La gestion des matières dangereuses préparée. Des installations de destruction de données intégrées. La récupération de composants organisée. L'assainissement environnemental planifié. Le démantèlement chez Iron Mountain récupère 95% des matériaux.

Évolution des réseaux

Les réseaux optiques évoluent vers des vitesses de l'exabit. Des émetteurs-récepteurs en photonique sur silicium à 1,6Tbps. L'optique cohérente atteignant 1Pbps par fibre. La fibre à cœur creux réduisant la latence de 30%. Le multiplexage par division spatiale ajoutant de la capacité. Des bandes de longueur d'onde au-delà de C+L. L'optique en espace libre pour la flexibilité. L'infrastructure optique chez Google atteint 1Pbps de bande passante de bissection.

Les exigences des réseaux quantiques sont uniques. Des canaux quantiques séparés des classiques. Des réseaux de distribution d'intrication. Des répéteurs quantiques requis. Des sources de photons uniques nécessaires. Des mémoires quantiques essentielles. Une correction d'erreurs différente. Le réseau quantique d'AWS Braket connecte les processeurs quantiques à l'échelle mondiale.

Les réseaux déterministes garantissent des performances prévisibles. Le réseau sensible au temps comme standard. Des limites de latence garanties. Une gigue inférieure à la microseconde. Une perte de paquets proche de zéro. Une mise en forme du trafic précise. Une synchronisation d'horloge exacte. Le réseau déterministe chez Tesla permet l'entraînement IA en temps réel.

L'infrastructure définie par logiciel apporte l'agilité. Le SDN contrôlant tous les flux réseau. La NFV remplaçant les appliances matérielles. Le service mesh gérant les microservices. Le réseau basé sur l'intention automatisé. Zéro

[Contenu tronqué pour la traduction]