Рідинне охолодження проти повітряного для дата-центрів ШІ: аналіз витрат і переваг 2025 року

Оновлено 8 грудня 2025 року

Повітряне охолодження досягає фізичної межі рівно на 41,3 кВт на стійку. Після цього порогу об'єм повітря, необхідний для відведення тепла, перевищує можливості будь-якої практичної конструкції, створюючи акустичні кошмари та термальний хаос, які жодна інженерія не здатна вирішити.¹ Рідинне охолодження обіцяє порятунок завдяки кращій термодинаміці, але за цінами, від яких фінансові директори втрачають спокій: $2-3 мільйони за мегават для модернізації.² Вибір між повітряним і рідинним охолодженням визначає не лише бюджети на інфраструктуру, а й конкурентоспроможність на ринках ШІ, де мілісекунди розділяють переможців від аутсайдерів.

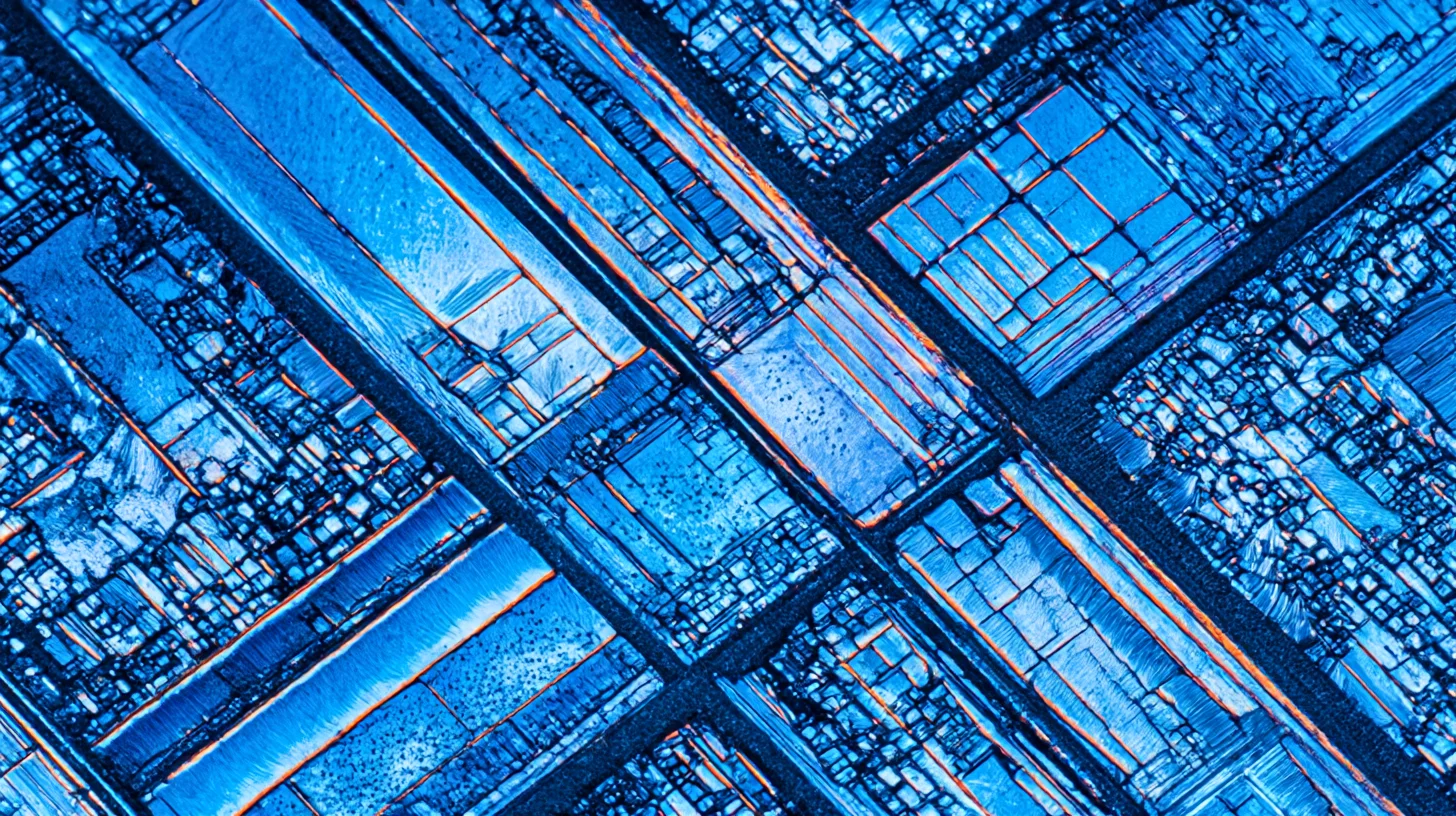

Оновлення за грудень 2025 року: 2025 рік став переломним — рідинне охолодження перетворилося «з передового на базове». Ринок рідинного охолодження дата-центрів досяг $5,52 мільярда у 2025 році і, за прогнозами, сягне $15,75 мільярда до 2030 року (CAGR 23,31%). При тому, що 22% дата-центрів вже впроваджують системи рідинного охолодження, технологія позбулася нішевого статусу і стала основною інфраструктурою. Охолодження безпосередньо на чипі займає домінуючу частку ринку — 47%. Microsoft розпочав масове розгортання по кампусах Azure у липні 2025 року та тестує мікрофлюїдику для майбутніх поколінь. Colovore забезпечив об'єкт вартістю $925 мільйонів з потужністю до 200 кВт на стійку. Сучасні чипи ШІ, такі як NVIDIA H100/H200 та AMD MI300X, генерують понад 700 Вт на GPU — теплову щільність, з якою повітряне охолодження просто не справляється. Гібридні архітектури охолодження, що поєднують повітря та рідину, стають практичним стандартом розгортання.

Дата-центри в усьому світі споживають 460 тераватт-годин на рік, при цьому охолодження становить 40% загального енергоспоживання традиційних об'єктів.³ Остання дорожня карта GPU від NVIDIA показує подвоєння енергоспоживання кожні два роки, досягаючи 1500 ватів на чип до 2026 року.⁴ Організації опинилися на переломному етапі, коли поступові покращення повітряного охолодження не встигають за експоненціальним зростанням теплової щільності. Рішення, прийняте сьогодні, фіксує операційні витрати на наступне десятиліття.

Microsoft витратив $1 мільярд на модернізацію об'єктів для рідинного охолодження після того, як виявилося, що їхня інфраструктура з повітряним охолодженням не може підтримувати навчання GPT.⁵ Amazon Web Services стратегічно застосовує обидві технології: повітряне охолодження для сховищ і CPU-навантажень, а рідинне — для GPU-кластерів.⁶ Різні підходи відображають фундаментальну істину: жодна окрема технологія охолодження не вирішує всі завдання, а неправильний вибір коштує мільйони за непотрібні активи.

Фізика, що визначає все

Повітря переносить у 3300 разів менше тепла на одиницю об'єму, ніж вода за стандартних умов.⁷ Цей єдиний факт визначає кожне рішення щодо охолодження в сучасних дата-центрах. Переміщення одного кіловата тепла за допомогою повітря вимагає 100 кубічних футів на хвилину (CFM) повітряного потоку при підвищенні температури на 10°F. Масштабуйте це до стійки 40 кВт, і вам потрібно 4000 CFM — еквівалент швидкості вітру урагану категорії 2 в холодному коридорі.⁸

Питома теплоємність води 4,186 кДж/кг·К означає, що один галон може поглинути стільки ж тепла, скільки 3000 кубічних футів повітря.⁹ Помірна швидкість потоку 10 галонів на хвилину обробляє 100 кВт теплового навантаження при підвищенні температури на 20°F. Таке ж охолодження повітрям вимагало б 10 000 CFM, генеруючи 95 децибелів шуму і споживаючи 25 кВт лише на живлення вентиляторів.¹⁰ Фізична перевага стає непереборною в міру зростання щільності.

Коефіцієнти теплопередачі розповідають повну історію. Конвекція повітря до поверхні досягає 25-250 Вт/м²·К залежно від швидкості.¹¹ Конвекція води до поверхні досягає 3000-15 000 Вт/м²·К — покращення в 60 разів, що дозволяє використовувати значно менші теплообмінники.¹² Прямий контакт між рідиною та корпусом чипа через холодні пластини досягає понад 50 000 Вт/м²·К, наближаючись до теоретичних меж кондуктивної теплопередачі.¹³

Температурні перепади множать ці переваги. Повітряне охолодження вимагає різниці 30-40°F між вхідною температурою та температурою компонентів для забезпечення адекватного теплового потоку. Рідинне охолодження працює з перепадами 10-15°F, підтримуючи нижчі температури переходу, що зменшує струм витоку та покращує надійність.¹⁴ Кожне зниження робочої температури на 10°C подвоює термін служби компонентів згідно з моделюванням за рівнянням Арреніуса.¹⁵

Висота над рівнем моря та вологість додатково обмежують ефективність повітряного охолодження. Висота Денвера в одну милю знижує щільність повітря на 17%, вимагаючи пропорційно більшого повітряного потоку для еквівалентного охолодження.¹⁶ Середовища з високою вологістю ризикують конденсацією, коли холодне повітря зустрічається з теплими поверхнями, потенційно спричиняючи катастрофічний вихід обладнання з ладу. Системи рідинного охолодження працюють незалежно від умов навколишнього середовища, забезпечуючи стабільну продуктивність від Долини Смерті до Гімалаїв.

Технології повітряного охолодження та їхні межі

Традиційне повітряне охолодження з підлогою, що піднімається, домінувало в дата-центрах протягом сорока років завдяки простоті та надійності. Блоки Computer Room Air Conditioning (CRAC) подають холодне повітря під підняту підлогу, створюючи надлишковий тиск, який проштовхує повітря через перфоровані плитки в холодні коридори. Сервери втягують повітря через свої корпуси та викидають нагріте повітря в гарячі коридори. Система чудово працює для 3-5 кВт на стійку, але катастрофічно відмовляє вище 15 кВт, коли рециркуляція гарячого повітря перевищує охолоджувальну потужність.¹⁷

Ізоляція гарячих/холодних коридорів покращує ефективність, запобігаючи змішуванню повітря. Пластикові штори або жорсткі панелі розділяють гарячі та холодні зони, підтримуючи температурні перепади, що покращують ефективність охолодження. Правильно реалізована ізоляція зменшує енергію охолодження на 20-30% і збільшує охолоджувальну потужність на 40%.¹⁸ Дата-центри Google досягають PUE 1,10, використовуючи вдосконалене повітряне охолодження з повною ізоляцією, доводячи потенціал технології при ідеальному виконанні.¹⁹

Внутрішньорядне охолодження наближає холодильне обладнання до джерел тепла, скорочуючи шляхи повітря та зменшуючи енергію вентиляторів. Серія CRV від Vertiv розміщує охолоджувальні блоки між серверними стійками, обробляючи до 55 кВт на блок.²⁰ Охолоджувачі InRow від Schneider Electric досягають аналогічної потужності зі змінною швидкістю вентиляторів, що адаптуються до теплового навантаження.²¹ Підхід працює для розгортань середньої щільності, але вимагає один охолоджувальний блок на кожні 2-3 серверні стійки, займаючи цінну площу.

Теплообмінники на задніх дверях представляють останній рубіж повітряного охолодження проти зростаючої щільності. Ці пасивні або активні блоки монтуються на задніх дверях стійок, охолоджуючи відпрацьоване повітря перед його потраплянням у приміщення. ChilledDoor від Motivair обробляє до 75 кВт на стійку, використовуючи циркуляцію охолодженої води.²² Технологія зберігає існуючі схеми повітряного потоку, водночас відводячи тепло біля джерела, але монтаж вимагає точного вирівнювання, а вага дверей створює структурні проблеми для старіших стійок.

Охолодження прямого розширення (DX) усуває інфраструктуру охолодженої води, подаючи холодоагент безпосередньо до охолоджувальних блоків. Підхід зменшує складність і покращує ефективність для менших об'єктів, але ризики витоку холодоагенту та обмежена масштабованість стримують впровадження. Facebook відмовився від охолодження DX після того, як витоки холодоагенту спричинили численні евакуації об'єктів, повністю перейшовши на системи на водній основі.²³

Розширена таксономія рідинного охолодження

Однофазне охолодження безпосередньо на чипі домінує в поточних рідинних розгортаннях завдяки перевіреній надійності та керованій складності. Холодні пластини, встановлені на CPU та GPU, циркулюють охолоджувач при 15-30°C, відводячи 70-80% тепла сервера, поки вентилятори обробляють решту.²⁴ Система InRackCDU від Asetek підтримує 120 кВт на стійку з резервними насосами та детекцією витоків.²⁵ Технологія вимагає мінімальних модифікацій сервера, дозволяючи модернізацію без заміни існуючого обладнання.

Двофазне охолодження безпосередньо на чипі використовує фазові переходи холодоагенту для кращого відведення тепла. Охолоджувач кипить при температурах поверхні чипа близько 50°C, при цьому пара забирає приховану теплоту пароутворення. Waterless DLC від ZutaCore досягає охолодження 900 Вт на GPU, використовуючи холодоагент R-1234ze при низькому тиску.²⁶ Саморегулююча природа кипіння підтримує рівномірні температури незалежно від коливань теплового навантаження, але складність системи та вартість холодоагенту обмежують впровадження.

Однофазне занурення повністю занурює сервери в діелектричну рідину, усуваючи всі вимоги до повітряного охолодження. Системи ICEraQ від GRC використовують синтетичну олію, підтримуючи сервери при вхідних температурах 45-50°C.²⁷ SmartPod від Submer використовує подібну технологію з біорозкладними рідинами, обробляючи 100 кВт на 60 квадратних футах.²⁸ Занурення усуває вентилятори, знижує частоту відмов і забезпечує екстремальну щільність, але вартість рідини $50-100 за галон та проблеми з обслуговуванням сповільнюють впровадження.²⁹

Двофазне занурення представляє технологічну вершину охолодження. Рідини Novec від 3M киплять при точно контрольованих температурах між 34-56°C, забезпечуючи ізотермічне охолодження, що підтримує оптимальні температури компонентів.³⁰ Project Natick від Microsoft продемонстрував двофазне занурення, що обробляє тепловий потік 250 Вт/см², в 10 разів вищий за межі повітряного охолодження.³¹ BitFury розгортає 160 мегаватів двофазного імерсійного охолодження для криптовалютного майнінгу, доводячи масштабованість попри вартість рідини $200 за галон.³²

Гібридні підходи поєднують технології для оптимізованого охолодження. Рідинне охолодження обробляє компоненти високої потужності, тоді як повітряне охолодження обслуговує пам'ять, сховища та мережеве обладнання. Системи Apollo від HPE використовують цей підхід з охолодженням безпосередньо на чипі для процесорів та традиційним повітряним охолодженням для всього іншого.³³ Стратегія балансує продуктивність і вартість, але вимагає управління двома паралельними охолоджувальними інфраструктурами.

Порівняння капітальних витрат виявляє несподіванки

Інфраструктура повітряного охолодження спочатку виглядає оманливо дешевою. Блоки CRAC коштують $30 000-50 000 за потужність 30 тонн, достатню для 100 кВт ІТ-навантаження.³⁴ Монтаж піднятої підлоги коштує $15-25 за квадратний фут.³⁵ Ізоляція гарячого коридору додає $5000-10 000 на стійку.³⁶ Повна система повітряного охолодження для об'єкта 1 МВт коштує $1,5-2 мільйони — здавалося б, розумно, поки не виникають вимоги до щільності.

Інфраструктура рідинного охолодження вимагає значних початкових інвестицій. Охолоджувальні розподільчі блоки (CDU) коштують $75 000-150 000 за потужність 500 кВт.³⁷ Монтаж трубопроводів коштує $50-100 за лінійний фут, включаючи ізоляцію та детекцію витоків.³⁸ Холодні пластини та колектори додають $5000-10 000 на сервер.³⁹ Повна інфраструктура рідинного охолодження для 1 МВт коштує $3-4 мільйони — вдвічі дорожче за повітряне охолодження.

Приховані витрати кардинально змінюють розрахунки. Повітряне охолодження при 40 кВт на стійку вимагає 25 стійок на мегават, займаючи 2500 квадратних футів. Рідинне охолодження при 100 кВт на стійку потребує лише 10 стійок на 1000 квадратних футах. При річних орендних ставках $200 за квадратний фут економія площі генерує $300 000 щорічних переваг.⁴⁰ Будівельні витрати для нових об'єктів становлять в середньому $10-15 мільйонів за мегават для повітряного охолодження проти $8-12 мільйонів для рідинного охолодження через зменшені вимоги до площі.⁴¹

Сценарії модернізації парадоксально сприяють рідинному охолодженню. Існуючі об'єкти зазвичай підтримують 100-150 ватів на квадратний фут. Модернізація повітряного охолодження для обробки сучасної щільності вимагає нових блоків CRAC, більших повітропроводів, потужніших вентиляторів і часто нового розподілу електроенергії — фактично повної реконструкції об'єкта. Модернізація рідинного охолодження додає CDU та трубопроводи, зберігаючи існуючу інфраструктуру для застарілого обладнання. Проекти модернізації Introl постійно показують на 20-30% нижчі витрати для конверсії на рідинне охолодження порівняно з модернізацією повітряного охолодження.

Цикли оновлення обладнання значно впливають на розрахунки TCO. Сервери з повітряним охолодженням вимагають заміни кожні 3-4 роки, оскільки підшипники вентиляторів зношуються, а накопичення пилу погіршує ефективність охолодження. Системи з рідинним охолодженням без рухомих частин продовжують цикли оновлення до 5-7 років.⁴² Подовжений термін служби відкладає капітальні витрати вартістю $2-3 мільйони на мегават за десятиліття.

Операційні витрати змінюють картину

Витрати на електроенергію домінують в операційних бюджетах, і переваги ефективності рідинного охолодження накопичуються щорічно. Повітряне охолодження споживає 0,5-1,2 кВт на кВт ІТ-навантаження в типових реалізаціях.⁴³ Рідинне охолодження зменшує накладні витрати на охолодження до 0,1-0,3 кВт на кВт ІТ-навантаження.⁴⁴ Для об'єкта 10 МВт, що працює безперервно при $0,10 за кВт·год,

[Контент скорочено для перекладу]