Refroidissement liquide vs refroidissement par air pour les centres de données IA : analyse coûts-bénéfices 2025

Mis à jour le 8 décembre 2025

Le refroidissement par air atteint ses limites physiques à exactement 41,3 kW par rack. Au-delà de ce seuil, le volume d'air nécessaire pour évacuer la chaleur dépasse ce que toute conception pratique peut fournir, créant des cauchemars acoustiques et un chaos thermique qu'aucune ingénierie ne peut résoudre.¹ Le refroidissement liquide promet le salut grâce à une thermodynamique supérieure, mais à des coûts qui font douter les directeurs financiers de leur santé mentale : 2 à 3 millions de dollars par mégawatt pour les installations de retrofit.² Le choix entre refroidissement par air et liquide détermine non seulement les budgets d'infrastructure, mais aussi la viabilité compétitive sur les marchés de l'IA où des millisecondes séparent les gagnants des autres.

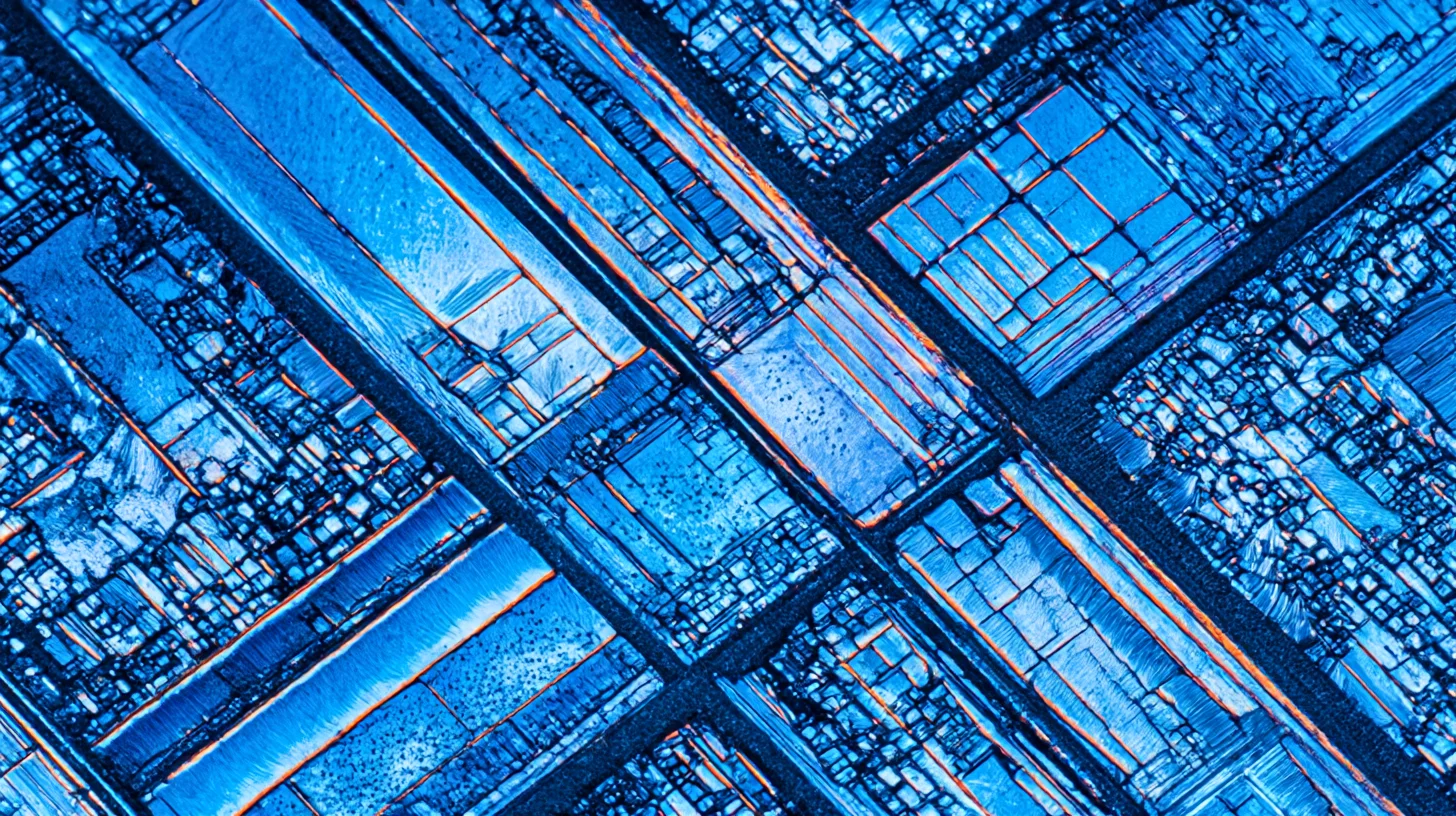

Mise à jour décembre 2025 : 2025 marque l'année où le refroidissement liquide est passé « de technologie de pointe à standard de base ». Le marché du refroidissement liquide pour centres de données a atteint 5,52 milliards de dollars en 2025 et devrait atteindre 15,75 milliards de dollars d'ici 2030 (TCAC de 23,31 %). Avec 22 % des centres de données mettant désormais en œuvre des systèmes de refroidissement liquide, la technologie a abandonné son statut de niche pour devenir une infrastructure essentielle. Le refroidissement direct sur puce détient une part de marché dominante de 47 %, Microsoft ayant commencé le déploiement de sa flotte sur les campus Azure en juillet 2025 et testant la microfluidique pour les générations futures. Colovore a sécurisé une installation de 925 millions de dollars offrant jusqu'à 200 kW par rack. Les puces IA modernes comme les NVIDIA H100/H200 et AMD MI300X génèrent plus de 700 W par GPU — des densités thermiques que le refroidissement par air ne peut tout simplement pas gérer. Les architectures de refroidissement hybride combinant air et liquide deviennent la norme de déploiement pratique.

Les centres de données consomment mondialement 460 térawattheures par an, le refroidissement représentant 40 % de la consommation énergétique totale dans les installations traditionnelles.³ La dernière feuille de route GPU de NVIDIA montre une consommation d'énergie doublant tous les deux ans, atteignant 1 500 watts par puce d'ici 2026.⁴ Les organisations font face à un point d'inflexion où les améliorations incrémentales du refroidissement par air ne peuvent pas suivre la croissance exponentielle de la densité thermique. La décision prise aujourd'hui verrouille les coûts opérationnels pour la prochaine décennie.

Microsoft a dépensé 1 milliard de dollars pour retrofiter ses installations pour le refroidissement liquide après avoir découvert que son infrastructure refroidie par air ne pouvait pas supporter les charges de travail d'entraînement GPT.⁵ Amazon Web Services déploie les deux technologies de manière stratégique, utilisant le refroidissement par air pour le stockage et les charges de travail CPU tout en réservant le refroidissement liquide aux clusters GPU.⁶ Les approches divergentes reflètent une vérité fondamentale : aucune technologie de refroidissement unique ne résout tous les défis, et un mauvais choix coûte des millions en actifs échoués.

La physique qui détermine tout

L'air transporte 3 300 fois moins de chaleur par unité de volume que l'eau dans des conditions standard.⁷ Ce seul fait guide chaque décision de refroidissement dans les centres de données modernes. Déplacer un kilowatt de chaleur avec de l'air nécessite 100 pieds cubes par minute (CFM) de débit d'air avec une élévation de température de 10°F. Extrapolez cela à un rack de 40 kW, et vous avez besoin de 4 000 CFM — l'équivalent d'une vitesse de vent d'ouragan de catégorie 2 dans l'allée froide.⁸

La capacité thermique massique de l'eau de 4,186 kJ/kg·K signifie qu'un seul gallon peut absorber autant de chaleur que 3 000 pieds cubes d'air.⁹ Un débit modeste de 10 gallons par minute gère 100 kW de charge thermique avec une élévation de température de 20°F. Le même refroidissement avec de l'air nécessiterait 10 000 CFM, générant 95 décibels de bruit et consommant 25 kW juste pour la puissance des ventilateurs.¹⁰ L'avantage physique devient insurmontable à mesure que la densité augmente.

Les coefficients de transfert thermique racontent l'histoire complète. La convection air-surface atteint 25-250 W/m²·K selon la vitesse.¹¹ La convection eau-surface atteint 3 000-15 000 W/m²·K, une amélioration de 60x qui permet des échangeurs de chaleur considérablement plus petits.¹² Le contact direct entre le liquide et le boîtier de la puce via des plaques froides atteint plus de 50 000 W/m²·K, approchant les limites théoriques du transfert thermique conductif.¹³

Les différentiels de température multiplient ces avantages. Le refroidissement par air nécessite une différence de 30-40°F entre les températures d'entrée et des composants pour générer un flux thermique adéquat. Le refroidissement liquide fonctionne avec des différentiels de 10-15°F, maintenant des températures de jonction plus basses qui réduisent le courant de fuite et améliorent la fiabilité.¹⁴ Chaque réduction de 10°C de la température de fonctionnement double la durée de vie des composants selon la modélisation de l'équation d'Arrhenius.¹⁵

L'altitude et l'humidité contraignent davantage l'efficacité du refroidissement par air. L'altitude d'un mile de Denver réduit la densité de l'air de 17 %, nécessitant proportionnellement plus de débit d'air pour un refroidissement équivalent.¹⁶ Les environnements à haute humidité risquent la condensation lorsque l'air froid rencontre des surfaces chaudes, pouvant causer une défaillance catastrophique de l'équipement. Les systèmes de refroidissement liquide fonctionnent indépendamment des conditions ambiantes, offrant des performances constantes de la Vallée de la Mort à l'Himalaya.

Technologies de refroidissement par air et leurs limites

Le refroidissement par air traditionnel sous plancher technique a dominé les centres de données pendant quarante ans grâce à sa simplicité et sa fiabilité. Les unités de climatisation de salle informatique (CRAC) soufflent de l'air froid sous les planchers surélevés, créant une pression positive qui force l'air à travers des dalles perforées dans les allées froides. Les serveurs aspirent l'air à travers leur châssis et évacuent l'air chauffé dans les allées chaudes. Le système fonctionne parfaitement pour 3-5 kW par rack mais échoue de manière catastrophique au-dessus de 15 kW lorsque la recirculation d'air chaud submerge la capacité de refroidissement.¹⁷

Le confinement allée chaude/allée froide améliore l'efficacité en empêchant le mélange d'air. Des rideaux en plastique ou des panneaux rigides séparent les zones chaudes et froides, maintenant les différentiels de température qui améliorent l'efficacité du refroidissement. Un confinement correctement mis en œuvre réduit l'énergie de refroidissement de 20-30 % et augmente la capacité de refroidissement de 40 %.¹⁸ Les centres de données de Google atteignent un PUE de 1,10 en utilisant un refroidissement par air avancé avec confinement complet, prouvant le potentiel de la technologie lorsqu'elle est parfaitement exécutée.¹⁹

Le refroidissement en rangée rapproche la réfrigération des sources de chaleur, raccourcissant les trajets d'air et réduisant l'énergie des ventilateurs. La série CRV de Vertiv place des unités de refroidissement entre les racks de serveurs, gérant jusqu'à 55 kW par unité.²⁰ Les refroidisseurs InRow de Schneider Electric atteignent une capacité similaire avec des ventilateurs à vitesse variable qui s'adaptent aux charges thermiques.²¹ L'approche fonctionne pour les déploiements de densité moyenne mais nécessite une unité de refroidissement pour chaque 2-3 racks de serveurs, consommant un espace au sol précieux.

Les échangeurs de chaleur de porte arrière représentent le dernier rempart du refroidissement par air contre les densités croissantes. Ces unités passives ou actives se montent sur les portes arrière des racks, refroidissant l'air d'échappement avant qu'il n'entre dans la pièce. Le ChilledDoor de Motivair gère jusqu'à 75 kW par rack en utilisant la circulation d'eau glacée.²² La technologie maintient les schémas de circulation d'air existants tout en évacuant la chaleur à la source, mais l'installation nécessite un alignement précis et le poids de la porte crée des préoccupations structurelles pour les racks plus anciens.

Le refroidissement à détente directe (DX) élimine l'infrastructure d'eau glacée en amenant le réfrigérant directement aux unités de refroidissement. L'approche réduit la complexité et améliore l'efficacité pour les installations plus petites, mais les risques de fuite de réfrigérant et l'évolutivité limitée contraignent l'adoption. Facebook a abandonné le refroidissement DX après que des fuites de réfrigérant aient causé plusieurs évacuations d'installations, passant entièrement aux systèmes à base d'eau.²³

La taxonomie en expansion du refroidissement liquide

Le refroidissement direct sur puce monophasé domine les déploiements liquides actuels grâce à une fiabilité éprouvée et une complexité gérable. Des plaques froides montées sur les CPU et GPU font circuler le liquide de refroidissement à 15-30°C, évacuant 70-80 % de la chaleur du serveur tandis que les ventilateurs gèrent le reste.²⁴ Le système InRackCDU d'Asetek supporte 120 kW par rack avec des pompes redondantes et une détection de fuites.²⁵ La technologie nécessite des modifications minimales du serveur, permettant des installations de retrofit sans remplacer le matériel existant.

Le refroidissement direct sur puce biphasé exploite les changements de phase du réfrigérant pour une évacuation thermique supérieure. Le liquide de refroidissement bout aux températures de surface de la puce autour de 50°C, la vapeur emportant la chaleur latente de vaporisation. Le Waterless DLC de ZutaCore atteint 900 W de refroidissement par GPU en utilisant le réfrigérant R-1234ze à basse pression.²⁶ La nature autorégulatrice de l'ébullition maintient des températures uniformes indépendamment des variations de charge thermique, mais la complexité du système et les coûts du réfrigérant limitent l'adoption.

L'immersion monophasée submerge des serveurs entiers dans un fluide diélectrique, éliminant tous les besoins de refroidissement par air. Les systèmes ICEraQ de GRC utilisent de l'huile synthétique maintenant les serveurs à des températures d'entrée de 45-50°C.²⁷ Le SmartPod de Submer utilise une technologie similaire avec des fluides biodégradables, gérant 100 kW dans 60 pieds carrés.²⁸ L'immersion élimine les ventilateurs, réduit les taux de défaillance et permet une densité extrême, mais les coûts de fluide de 50-100 dollars par gallon et les défis de maintenance ralentissent l'adoption.²⁹

L'immersion biphasée représente le summum technologique du refroidissement. Les fluides Novec de 3M bouillent à des températures précisément contrôlées entre 34-56°C, fournissant un refroidissement isotherme qui maintient des températures de composants optimales.³⁰ Le Project Natick de Microsoft a démontré une immersion biphasée gérant un flux thermique de 250 W/cm², 10x supérieur aux limites du refroidissement par air.³¹ BitFury déploie 160 mégawatts de refroidissement par immersion biphasée pour le minage de cryptomonnaie, prouvant l'évolutivité malgré des coûts de fluide de 200 dollars par gallon.³²

Les approches hybrides combinent les technologies pour un refroidissement optimisé. Le refroidissement liquide gère les composants haute puissance tandis que le refroidissement par air gère la mémoire, le stockage et les équipements réseau. Les systèmes Apollo de HPE utilisent cette approche, avec un refroidissement direct sur puce pour les processeurs et un refroidissement par air traditionnel pour tout le reste.³³ La stratégie équilibre performance et coût mais nécessite la gestion de deux infrastructures de refroidissement parallèles.

La comparaison des dépenses d'investissement révèle des surprises

L'infrastructure de refroidissement par air semble trompeusement bon marché initialement. Les unités CRAC coûtent 30 000-50 000 dollars par capacité de 30 tonnes, suffisante pour 100 kW de charge IT.³⁴ L'installation de plancher surélevé coûte 15-25 dollars par pied carré.³⁵ Le confinement d'allée chaude ajoute 5 000-10 000 dollars par rack.³⁶ Un système de refroidissement par air complet pour une installation de 1 MW coûte 1,5-2 millions de dollars, apparemment raisonnable jusqu'à ce que les exigences de densité émergent.

L'infrastructure de refroidissement liquide exige un investissement initial substantiel. Les unités de distribution de refroidissement (CDU) coûtent 75 000-150 000 dollars par capacité de 500 kW.³⁷ L'installation de tuyauterie coûte 50-100 dollars par pied linéaire incluant l'isolation et la détection de fuites.³⁸ Les plaques froides et les collecteurs ajoutent 5 000-10 000 dollars par serveur.³⁹ L'infrastructure de refroidissement liquide complète pour 1 MW coûte 3-4 millions de dollars, le double du prix du refroidissement par air.

Les coûts cachés modifient le calcul de manière spectaculaire. Le refroidissement par air à 40 kW par rack nécessite 25 racks par mégawatt, consommant 2 500 pieds carrés. Le refroidissement liquide à 100 kW par rack n'a besoin que de 10 racks dans 1 000 pieds carrés. À des taux de location de 200 dollars par pied carré par an, les économies d'espace génèrent 300 000 dollars de bénéfices annuels.⁴⁰ Les coûts de construction pour les nouvelles installations moyennent 10-15 millions de dollars par mégawatt pour le refroidissement par air contre 8-12 millions de dollars pour le refroidissement liquide en raison des besoins réduits en espace.⁴¹

Les scénarios de retrofit favorisent le refroidissement liquide de manière contre-intuitive. Les installations existantes supportent généralement 100-150 watts par pied carré. La mise à niveau du refroidissement par air pour gérer les densités modernes nécessite de nouvelles unités CRAC, des conduits plus grands, des ventilateurs plus puissants, et souvent une nouvelle distribution électrique — essentiellement vider l'installation. Les retrofits de refroidissement liquide ajoutent des CDU et de la tuyauterie tout en maintenant l'infrastructure existante pour l'équipement legacy. Les projets de retrofit d'Introl montrent systématiquement des coûts 20-30 % inférieurs pour les conversions au refroidissement liquide comparées aux mises à niveau du refroidissement par air.

Les cycles de renouvellement d'équipement impactent significativement les calculs de TCO. Les serveurs refroidis par air nécessitent un remplacement tous les 3-4 ans à mesure que les roulements de ventilateurs s'usent et que l'accumulation de poussière dégrade l'efficacité du refroidissement. Les systèmes refroidis par liquide sans pièces mobiles étendent les cycles de renouvellement à 5-7 ans.⁴² La durée de vie prolongée reporte les dépenses d'investissement d'une valeur de 2-3 millions de dollars par mégawatt sur une décennie.

Les dépenses d'exploitation renversent la situation

Les coûts énergétiques dominent les budgets opérationnels, et les avantages d'efficacité du refroidissement liquide se cumulent annuellement. Le refroidissement par air consomme 0,5-1,2 kW par kW de charge IT dans les implémentations typiques.⁴³ Le refroidissement liquide réduit les frais généraux de refroidissement à 0,1-0,3 kW par kW de charge IT.⁴⁴ Pour une installation de 10 MW fonctionnant en continu à 0,10 $ par kWh, le

[Contenu tronqué pour la traduction]