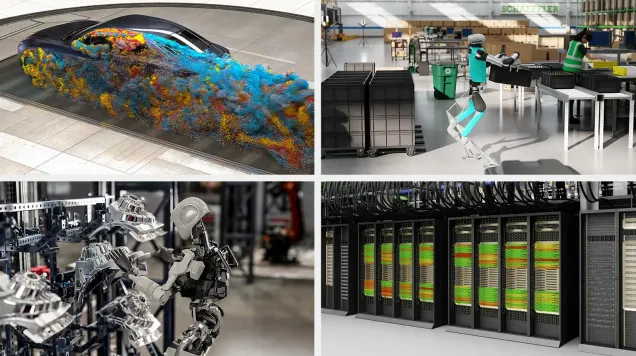

NVIDIA Omniverse: Hệ điều hành AI Vật lý trị giá 50 nghìn tỷ USD

NVIDIA Omniverse hỗ trợ hơn 252 doanh nghiệp với mức tăng hiệu quả 30-70%. Hệ điều hành AI vật lý trị giá 50 nghìn tỷ USD này đang biến đổi ngành sản xuất, robot và xe tự hành.

Điều phối, lập lịch và triển khai: Kubernetes, Slurm, Ray và các nền tảng giữ cho cụm GPU hoạt động hiệu quả.

Hạ tầng GPU đắt tiền sẽ trở nên vô giá trị nếu để không hoạt động. MLOps—thực hành duy trì hệ thống AI hoạt động hiệu quả—đã trở thành một chuyên ngành quan trọng không kém gì kỹ thuật ML.

Hub này bao gồm khía cạnh vận hành của AI: từ lập lịch các tác vụ huấn luyện phân tán đến triển khai mô hình ở quy mô lớn, và tự động hóa hạ tầng giúp quản lý được toàn bộ quy trình.

Khoảng cách giữa "demo AI" và "AI trong sản xuất" được kết nối bởi vận hành. Nội dung MLOps của chúng tôi giúp bạn xây dựng các thực hành và nền tảng biến đầu tư GPU thành giá trị kinh doanh.

NVIDIA Omniverse hỗ trợ hơn 252 doanh nghiệp với mức tăng hiệu quả 30-70%. Hệ điều hành AI vật lý trị giá 50 nghìn tỷ USD này đang biến đổi ngành sản xuất, robot và xe tự hành.

Từ các thiết lập máy chủ đơn lẻ đến các cụm 100,000 GPU khổng lồ, hướng dẫn toàn diện này khám phá các chiến lược triển khai GPU doanh nghiệp cho hạ tầng AI. Khám phá những thông tin chuyên sâu có thể...

CEO của Introl Ryan Puckett đã được chọn vào danh sách chung kết cho Giải thưởng Doanh nhân Của Năm EY 2025 tại khu vực Midwest. Dưới sự lãnh đạo của ông, Introl đã tăng gấp đôi doanh thu hàng năm kể ...

Bài báo năm 2017 'Attention Is All You Need' đã khơi mào một cuộc cách mạng AI thông qua kiến trúc Transformer. Thay thế các RNN và LSTM tuần tự bằng các cơ chế self-attention có thể song song hóa, Tr...

Bạn đã bao giờ nghĩ đến điều gì xảy ra phía sau hậu trường khi bạn tương tác với các mô hình AI siêu nhanh tạo ra hình ảnh photorealistic hoặc xử lý các bộ dữ liệu khổng lồ trong vài mili giây? Phép m...

Hãy cho chúng tôi biết về dự án của bạn và chúng tôi sẽ phản hồi trong vòng 72 giờ.

Cảm ơn bạn đã gửi yêu cầu. Đội ngũ của chúng tôi sẽ xem xét và phản hồi trong vòng 72 giờ.