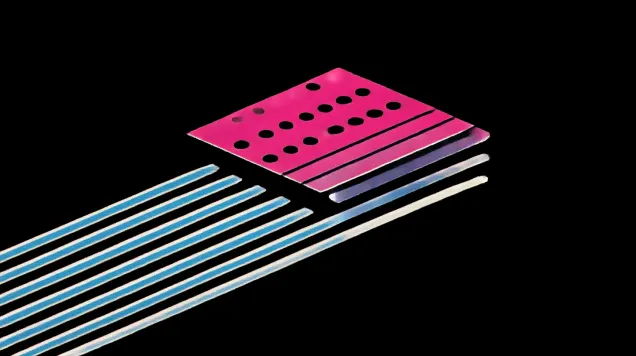

การใช้งาน NVMe-oF: การแยกสถาปัตยกรรม Storage สำหรับการติดตั้ง GPU 100,000 ตัว

การนำ NVMe-oF มาใช้กำลังเร่งตัวขึ้นพร้อมกับไดรฟ์ PCIe Gen5 ที่ให้ความเร็ว 14GB/s และ Fabric 400GbE ที่กำลังกลายเป็นมาตรฐาน ข้อกำหนด NVMe 2.0 ได้รับการรับรองแล้วพร้อมการรองรับ multi-path และ zoned name...