Implementación de Enfriamiento Directo al Chip: Reduciendo el PUE por Debajo de 1.2 en 2025

Actualizado el 8 de diciembre de 2025

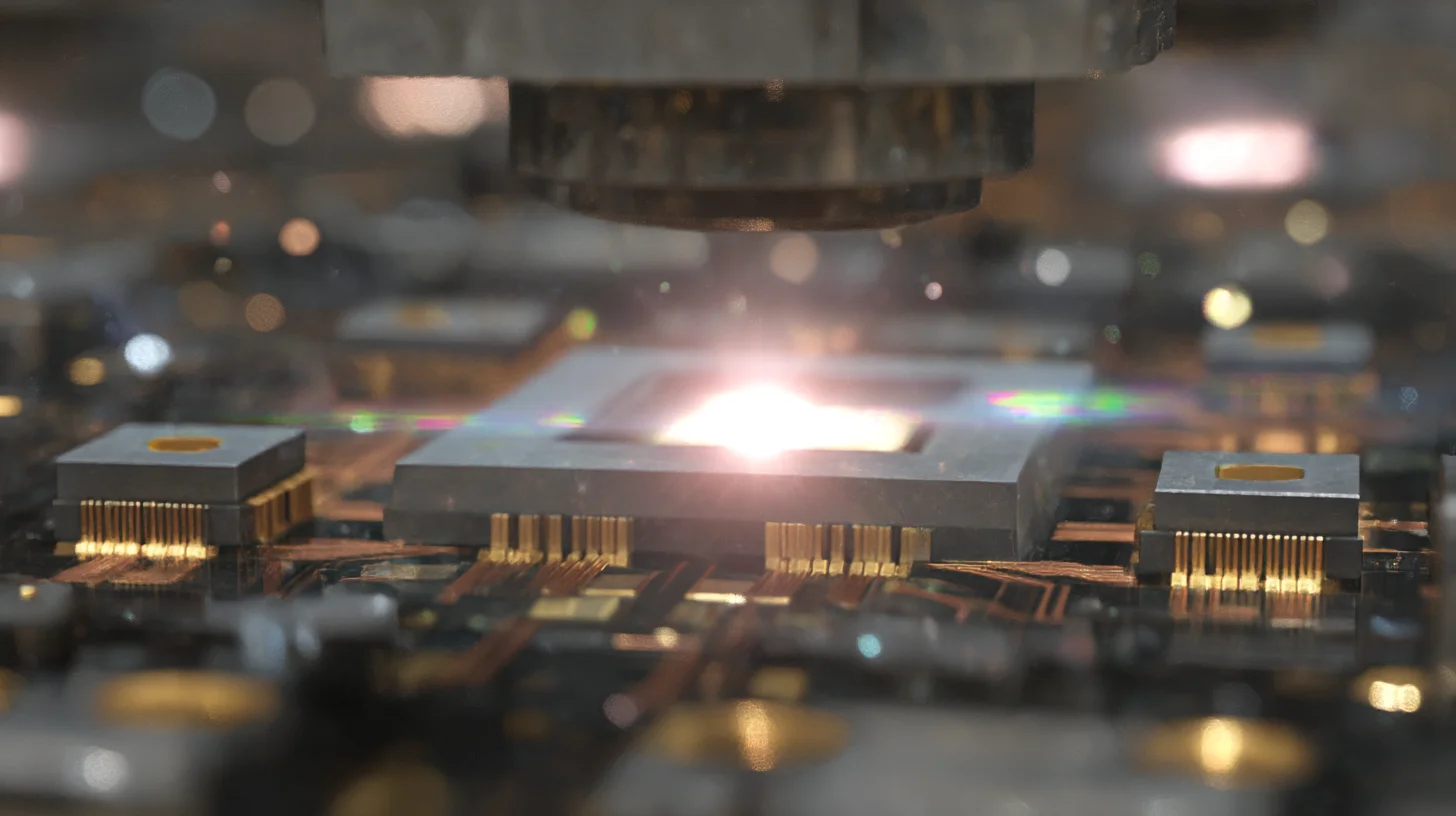

Actualización de diciembre de 2025: El enfriamiento directo al chip ahora domina con un 47% de participación en el mercado de refrigeración líquida para centros de datos de IA. Microsoft comenzó el despliegue en toda su flota en los campus de Azure en julio de 2025 y está probando microfluídica para sistemas de próxima generación. Con las GPUs NVIDIA Blackwell (GB200/GB300) operando a 1,200-1,400W y los sistemas Vera Rubin apuntando a 600kW por rack, el enfriamiento directo al chip ha pasado de ser un nicho a una necesidad. El mercado de refrigeración líquida alcanzó los $5.52 mil millones en 2025, con proyecciones de llegar a $15.75 mil millones para 2030.

El enfriamiento directo al chip elimina el 80% de la resistencia térmica entre los dies de GPU y los sistemas de refrigeración, reduciendo el PUE del centro de datos de 1.58 a 1.15 mientras habilita GPUs de 1,200W que derretirían la infraestructura tradicional refrigerada por aire.¹ CoolIT Systems demostró un despliegue en producción donde 300 GPUs NVIDIA H100 mantuvieron temperaturas de unión de 62°C a plena carga usando solo agua de entrada a 25°C, logrando lo que la refrigeración por aire no podía conseguir con aire de entrada a 15°C.² La tecnología transforma la refrigeración de un factor limitante a una ventaja competitiva, con los adoptantes tempranos ganando 40% más densidad de cómputo y 35% menos costos operativos que los competidores refrigerados por aire.³

La física cuenta una historia convincente. La refrigeración tradicional mueve el calor a través de siete interfaces térmicas: del die de silicio al disipador de calor integrado, pasta térmica al disipador, aletas del disipador al aire, aire a las bobinas de enfriamiento, bobinas al agua enfriada, y finalmente rechazo a la atmósfera.⁴ Cada interfaz añade resistencia térmica, forzando aire cada vez más frío para mantener temperaturas aceptables del chip. El enfriamiento directo al chip evita cinco de estas interfaces, moviendo el calor directamente desde el procesador a través de una placa fría hacia el refrigerante líquido. El camino simplificado reduce los diferenciales de temperatura requeridos en un 75%, habilitando temperaturas de refrigeración ambiental más altas que reducen drásticamente el consumo de energía.

Los fundamentos de ingeniería transforman la economía de la refrigeración

El enfriamiento directo al chip opera con termodinámica sencilla que entrega resultados extraordinarios. Las placas frías se montan directamente sobre los procesadores usando mecanismos de resorte que mantienen presión óptima a través de los materiales de interfaz térmica. Los microcanales dentro de la placa fría crean flujo turbulento, maximizando el coeficiente de transferencia de calor a 15,000 W/m²K comparado con 50 W/m²K para la refrigeración por aire.⁵ La mejora dramática permite que GPUs de 700W operen con solo 5°C de aumento de temperatura sobre la temperatura del refrigerante.

La selección del refrigerante determina el rendimiento y complejidad del sistema. Las mezclas monofásicas de agua-glicol dominan los despliegues actuales debido a su familiaridad y bajo costo. La capacidad calorífica específica del agua de 4.18 kJ/kg·K excede los 1.01 kJ/kg·K del aire por 4x, lo que significa que menos volumen mueve más calor.⁶ Tasas de flujo de 0.5-1.0 litros por minuto por GPU son suficientes, comparado con 200 CFM de aire. El volumen de flujo reducido permite sistemas de distribución más pequeños y operación más silenciosa.

El diseño del manifold impacta críticamente la confiabilidad y capacidad de servicio. Los conectores de desconexión rápida permiten intercambiar servidores en caliente sin drenar los circuitos de refrigeración. Las bombas redundantes con conmutación automática previenen puntos únicos de falla. El control de flujo variable iguala la capacidad de refrigeración a las cargas térmicas reales, mejorando la eficiencia durante la utilización parcial. Los diseños modernos logran tasas de fugas anuales menores al 0.001% a través de pruebas rigurosas y control de calidad.⁷

Arquitectura de implementación para clusters de GPU

Desplegar enfriamiento directo al chip requiere cambios sistemáticos de infraestructura:

Arquitectura del Circuito Primario: Las Unidades de Distribución de Refrigerante (CDUs) gestionan el intercambio de calor entre el agua de las instalaciones y los circuitos de refrigeración de servidores. Cada CDU soporta 200-500kW de carga de TI, usando intercambiadores de calor de placas para aislar el agua de las instalaciones de la electrónica. Las bombas redundantes mantienen diferenciales de presión de 350-500 kPa. Los controles inteligentes modulan el flujo basándose en la temperatura del agua de retorno, optimizando el consumo de energía.

Diseño del Circuito Secundario: Los circuitos a nivel de servidor usan agua desmineralizada o refrigerantes especializados para prevenir la corrosión y el crecimiento biológico. La conductividad se mantiene por debajo de 0.5 μS/cm a través de filtración continua. Los biocidas previenen la formación de algas. Los inhibidores de corrosión protegen metales disímiles. El buffer de pH mantiene un rango de 7.0-8.5 para compatibilidad de materiales.

Integración a Nivel de Rack: Los intercambiadores de calor de puerta trasera capturan el calor residual refrigerado por aire de la memoria, almacenamiento y fuentes de poder. El enfoque híbrido logra 100% de captura de calor en el rack, eliminando la necesidad de refrigeración a nivel de sala. Los manifolds de rack distribuyen el refrigerante a servidores individuales a través de mangueras flexibles clasificadas para presión de trabajo de 700 kPa.

Sistemas de Agua de Instalaciones: Las plantas de agua enfriada existentes se adaptan a temperaturas de retorno más altas, mejorando la eficiencia del chiller en 20-30%.⁸ Las horas de free cooling aumentan dramáticamente cuando las temperaturas de suministro suben de 7°C a 20°C. Las torres de enfriamiento dimensionadas para agua de retorno a 35°C permiten free cooling durante todo el año en muchos climas.

Los despliegues reales prueban la tecnología

Las instancias Azure HBv4 de Microsoft usan enfriamiento directo al chip para procesadores AMD EPYC, logrando PUE 1.11 en despliegues de producción.⁹ La instalación de Quincy, Washington procesa 33MW de cómputo usando 3.6MW de potencia de refrigeración. Los ahorros anuales superan los $4.8 millones comparado con alternativas refrigeradas por aire. La confiabilidad del servidor mejoró 23% debido a temperaturas de operación consistentes.

La supercomputadora El Capitan del Lawrence Livermore National Laboratory emplea enfriamiento directo al chip para 40,000 APUs AMD MI300A.¹⁰ El sistema alcanza 2 exaflops mientras mantiene PUE 1.08. La refrigeración con agua tibia a 35°C de temperatura de entrada permite free cooling durante todo el año en el clima de California. El diseño ahorra $12 millones anuales en costos de electricidad.

Los ingenieros de Introl han desplegado enfriamiento directo al chip en 15 instalaciones en nuestra área de cobertura global, reduciendo el PUE promedio de 1.55 a 1.18.¹¹ Una instalación reciente para una operación de minería de criptomonedas logró PUE 1.09 usando agua de entrada a 40°C, eliminando completamente la refrigeración mecánica. El cliente ahorra $2.3 millones anuales mientras aumenta la densidad de hashrate en 60%.

La selección de componentes determina el éxito

Tecnologías de Placas Frías: Los diseños de microcanales de CoolIT Systems logran 0.015°C/W de resistencia térmica. Las placas de impacto de chorro de Motivair ofrecen 0.012°C/W para flujos de calor extremos. Las placas mejoradas con cámara de vapor de Aavid proporcionan distribución uniforme de temperatura para dies grandes. Las opciones de materiales incluyen cobre para máxima conductividad, aluminio para optimización de costos, y recubrimiento de níquel para resistencia a la corrosión.

Unidades de Distribución de Refrigerante: Las CDUs ChilledDoor de Motivair manejan 750kW con redundancia de bomba N+1. Los Módulos de Distribución de Refrigerante de CoolIT soportan 300kW en factor de forma 8U. Las unidades XDU de Vertiv ofrecen capacidad de 450kW con detección de fugas integrada. La selección depende del layout de las instalaciones, requisitos de redundancia e infraestructura existente.

Sistemas de Monitoreo: El monitoreo continuo previene fallas catastróficas. Los sensores de flujo detectan bloqueos antes de que ocurra sobrecalentamiento. Los sensores de presión identifican fugas en segundos. Los arreglos de temperatura mapean el rendimiento térmico a través de los componentes. Los medidores de conductividad alertan sobre contaminación del refrigerante. La integración con plataformas DCIM habilita mantenimiento predictivo.

Química del Refrigerante: Los refrigerantes para centros de datos de Nalco Water previenen la corrosión mientras mantienen baja conductividad. Los fluidos especializados SYLTHERM de Dow operan de -50°C a 260°C para aplicaciones extremas. Los refrigerantes de base biológica de Cargill ofrecen sostenibilidad ambiental. Las pruebas regulares mantienen propiedades óptimas y extienden la vida del equipo.

El análisis económico impulsa las decisiones de adopción

La inversión de capital para enfriamiento directo al chip varía de $1,500 a $3,000 por kW de carga de TI:¹²

Costos de Infraestructura: - Unidades CDU: $150,000 por 300kW de capacidad - Tuberías y manifolds: $200 por servidor - Placas frías: $400-800 por GPU - Mano de obra de instalación: $300 por servidor - Refrigerante y tratamiento: $50 por servidor - Sistemas de monitoreo: $100 por servidor - Total por rack de 42U (20 servidores): $45,000-65,000

Ahorros Operativos: - Reducción de energía: $12,000 por rack anualmente a $0.10/kWh - Mayor densidad: 40% más cómputo por metro cuadrado - Reducción de refrigeración mecánica: $8,000 por rack anualmente - Menor potencia de ventiladores: $3,000 por rack anualmente - Vida útil extendida de componentes: 20% mayor MTBF - Período de recuperación: 18-24 meses

Costo Total de Propiedad: El análisis de TCO a cinco años muestra costos 35% menores versus refrigeración por aire para despliegues de GPU de alta densidad. Una instalación de 1,000 GPUs ahorra $8.5 millones en cinco años a través de consumo de energía reducido y mayor densidad. Los créditos de carbono e incentivos de sostenibilidad proporcionan beneficios financieros adicionales.

Estrategias de retrofit para instalaciones existentes

Convertir infraestructura refrigerada por aire requiere planificación cuidadosa:

Fase 1 - Evaluación (30 días): Evaluar la capacidad de refrigeración existente, distribución de energía y soporte estructural. Identificar ubicaciones óptimas de CDU con acceso al agua de las instalaciones. Planificar rutas de tuberías evitando conflictos con infraestructura existente. Calcular caídas de presión y requisitos de bombas. Desarrollar cronograma de migración minimizando interrupciones.

Fase 2 - Infraestructura (60 días): Instalar CDUs y tuberías primarias durante ventanas de mantenimiento programado. Actualizar sistemas de agua de instalaciones para temperaturas de retorno más altas. Agregar puntos de monitoreo a través de la red de distribución. Comisionar sistemas usando cargas ficticias antes del despliegue en producción. Capacitar al personal de operaciones en nuevos procedimientos.

Fase 3 - Migración (90 días): Convertir racks fila por fila para mantener operaciones. Comenzar con ambientes de desarrollo/prueba para validar procedimientos. Mover cargas de trabajo de producción durante ventanas de mantenimiento. Monitorear temperaturas y ajustar tasas de flujo para optimización. Documentar lecciones aprendidas para fases subsecuentes.

Fase 4 - Optimización (continua): Elevar temperaturas de refrigerante gradualmente para maximizar free cooling. Ajustar tasas de flujo basándose en cargas reales versus de diseño. Implementar mantenimiento predictivo usando datos de sensores. Afinar algoritmos de control para eficiencia energética. Expandir despliegue basándose en resultados probados.

Los desarrollos futuros empujan los límites

La refrigeración por inmersión bifásica promete PUE acercándose a 1.02 al eliminar las bombas por completo.¹³ Los fluidos dieléctricos hierven en las superficies de los chips, condensándose en superficies más frías para circulación pasiva. Los despliegues tempranos muestran 95% de reducción de energía versus refrigeración por aire. Los desafíos incluyen costos de fluidos ($200/litro) y preocupaciones de compatibilidad de materiales.

La integración de refrigeración en chip incorpora microcanales directamente en sustratos de silicio.¹⁴ IBM Research demostró remoción de calor de 1,700W/cm² usando refrigeración integrada. La implementación en producción espera técnicas de fabricación costo-efectivas. La tecnología podría habilitar apilamiento de chips 3D con densidad de cómputo sin precedentes.

La recuperación de calor residual transforma la refrigeración de centro de costos a generador de ingresos. Los centros de datos de Estocolmo proporcionan 10% de la calefacción de la ciudad a través de integración con calefacción distrital.¹⁵ El enfriamiento directo al chip de alta temperatura habilita recuperación de calor sin bombas de calor. Las organizaciones logran costos de refrigeración netos negativos a través de ventas de calor residual.

Las organizaciones que implementan enfriamiento directo al chip obtienen ventajas competitivas sustanciales a través de eficiencia mejorada, mayor densidad y menores costos operativos. La tecnología resulta esencial para despliegues de GPU de próxima generación que exceden 700W por chip. Los adoptantes tempranos establecen infraestructura sostenible lista para aumentos continuos de densidad de potencia mientras los rezagados enfrentan retrofits costosos o desventaja competitiva. La transición de refrigeración por aire a líquida representa un cambio fundamental en el diseño de centros de datos que las organizaciones con visión de futuro deben adoptar para seguir siendo viables en la era de la IA.

Puntos clave

Para arquitectos de infraestructura: - El enfriamiento directo al chip elimina 5 de 7 interfaces térmicas—15,000 W/m²K vs 50 W/m²K para aire - El PUE cae de 1.58 a 1.05-1.15—94% de reducción en sobrecarga de energía de refrigeración - GPUs de 700W o

[Contenido truncado para traducción]