ダイレクト・トゥ・チップ冷却の実装:2025年にPUEを1.2以下に削減

2025年12月8日更新

2025年12月アップデート: ダイレクト・トゥ・チップ冷却は現在、AIデータセンターの液冷市場で47%という圧倒的なシェアを占めています。Microsoftは2025年7月からAzureキャンパス全体でフリート展開を開始し、次世代システム向けにマイクロフルイディクスのテストを行っています。NVIDIA Blackwell GPU(GB200/GB300)が1,200〜1,400Wで動作し、Vera Rubinシステムがラックあたり600kWを目標としている中、ダイレクト・トゥ・チップ冷却はニッチから必需品へと移行しました。液冷市場は2025年に55.2億ドルに達し、2030年までに157.5億ドルに達すると予測されています。

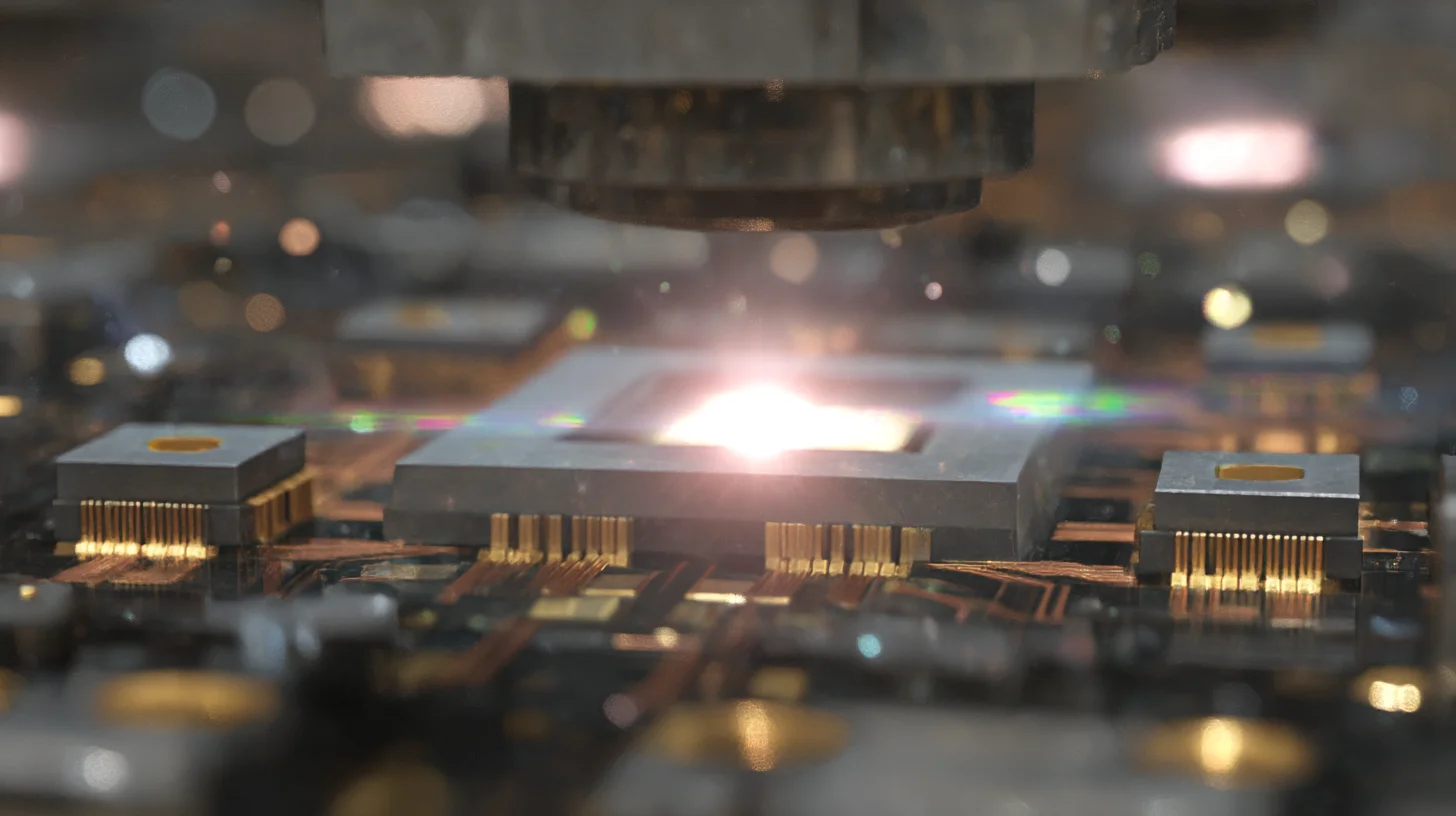

ダイレクト・トゥ・チップ冷却は、GPUダイと冷却システム間の熱抵抗の80%を排除し、データセンターのPUEを1.58から1.15に低下させながら、従来の空冷インフラでは溶けてしまう1,200W GPUを可能にします。¹ CoolIT Systemsは、25°Cの入水温度でわずか62°Cのジャンクション温度を維持しながら300台のNVIDIA H100 GPUをフル負荷で運用する本番環境を実証しました。これは15°Cの入気温度を使用した空冷では達成できなかった成果です。² この技術は、冷却を制限要因から競争優位性へと変革し、早期採用者は空冷の競合他社と比較して40%高いコンピューティング密度と35%低い運用コストを獲得しています。³

物理法則は説得力のあるストーリーを語っています。従来の冷却は、シリコンダイから統合ヒートスプレッダー、サーマルペーストからヒートシンク、ヒートシンクフィンから空気、空気から冷却コイル、コイルから冷水、そして最終的に大気への放熱という7つの熱界面を通じて熱を移動させます。⁴ 各界面は熱抵抗を追加し、許容可能なチップ温度を維持するためにますます冷たい空気を必要とします。ダイレクト・トゥ・チップ冷却はこれらの界面のうち5つをバイパスし、コールドプレートを通じてプロセッサから液体冷却剤に直接熱を移動させます。簡素化された経路により必要な温度差が75%削減され、エネルギー消費を大幅に削減する高い周囲温度での冷却が可能になります。

エンジニアリングの基礎が冷却経済を再構築

ダイレクト・トゥ・チップ冷却は、驚異的な結果をもたらす単純な熱力学で動作します。コールドプレートは、熱界面材料全体に最適な圧力を維持するスプリング式メカニズムを使用してプロセッサに直接取り付けられます。コールドプレート内のマイクロチャネルは乱流を生成し、熱伝達係数を空冷の50 W/m²Kと比較して15,000 W/m²Kに最大化します。⁵ この劇的な改善により、700W GPUは冷却剤温度より5°C高いだけの温度上昇で動作できます。

冷却剤の選択がシステムの性能と複雑さを決定します。単相の水-グリコール混合物は、馴染みやすさと低コストのため、現在の展開で主流となっています。水の比熱容量4.18 kJ/kg·Kは空気の1.01 kJ/kg·Kの4倍を超え、より少ない体積でより多くの熱を移動できることを意味します。⁶ GPUあたり毎分0.5〜1.0リットルの流量で十分であり、空気の200 CFMと比較されます。流量体積の削減により、より小型の配管システムと静かな運転が可能になります。

マニホールドの設計は、信頼性と保守性に重大な影響を与えます。クイックディスコネクトフィッティングにより、冷却ループを排水せずにサーバーのホットスワップが可能になります。自動フェイルオーバー付きの冗長ポンプは単一障害点を防ぎます。可変流量制御は冷却能力を実際の熱負荷に合わせ、部分的な使用率時の効率を向上させます。現代の設計は、厳格なテストと品質管理により年間0.001%未満の漏れ率を達成しています。⁷

GPUクラスター向け実装アーキテクチャ

ダイレクト・トゥ・チップ冷却の展開には、体系的なインフラ変更が必要です:

一次ループアーキテクチャ:Cooling Distribution Units(CDU)は、施設水とサーバー冷却ループ間の熱交換を管理します。各CDUは200〜500kWのIT負荷をサポートし、プレート熱交換器を使用して施設水を電子機器から隔離します。冗長ポンプは350〜500 kPaの圧力差を維持します。スマートコントロールは戻り水温度に基づいて流量を調整し、エネルギー消費を最適化します。

二次ループ設計:サーバーレベルのループは、腐食と生物学的成長を防ぐために脱塩水または特殊な冷却剤を使用します。導電率は継続的なろ過により0.5 μS/cm以下に維持されます。殺藻剤は藻類の形成を防ぎます。腐食抑制剤は異種金属を保護します。pHバッファリングは材料互換性のために7.0〜8.5の範囲を維持します。

ラックレベル統合:リアドア熱交換器は、メモリ、ストレージ、電源からの残留空冷熱を捕捉します。このハイブリッドアプローチはラックで100%の熱捕捉を達成し、室内レベルの冷却の必要性を排除します。ラックマニホールドは、700 kPaの作動圧力定格のフレキシブルホースを通じて個々のサーバーに冷却剤を分配します。

施設水システム:既存の冷水プラントは高い戻り水温度に適応し、チラー効率を20〜30%向上させます。⁸ 供給温度が7°Cから20°Cに上昇すると、フリークーリング時間が劇的に増加します。35°Cの戻り水用に設計された冷却塔は、多くの気候で年間を通じてフリークーリングを可能にします。

実際の展開が技術を証明

MicrosoftのAzure HBv4インスタンスは、AMD EPYCプロセッサにダイレクト・トゥ・チップ冷却を使用し、本番展開でPUE 1.11を達成しています。⁹ ワシントン州クインシーの施設は、3.6MWの冷却電力を使用して33MWのコンピューティングを処理しています。年間節約額は空冷代替と比較して480万ドルを超えます。サーバーの信頼性は一貫した動作温度により23%向上しました。

ローレンス・リバモア国立研究所のEl Capitanスーパーコンピューターは、40,000台のAMD MI300A APUにダイレクト・トゥ・チップ冷却を採用しています。¹⁰ このシステムはPUE 1.08を維持しながら2エクサフロップスを達成しています。35°Cの入水温度での温水冷却により、カリフォルニアの気候で年間を通じてフリークーリングが可能になります。この設計により年間1,200万ドルの電気代が節約されます。

Introlのエンジニアは、グローバルカバレッジエリアの15施設にダイレクト・トゥ・チップ冷却を展開し、平均PUEを1.55から1.18に削減しました。¹¹ 暗号通貨マイニング事業者への最近の設置では、40°Cの入水温度を使用してPUE 1.09を達成し、機械的冷却を完全に排除しました。クライアントはハッシュレート密度を60%増加させながら年間230万ドルを節約しています。

コンポーネント選択が成功を決定

コールドプレート技術:CoolIT Systemsのマイクロチャネル設計は0.015°C/Wの熱抵抗を達成します。Motivairのジェットインピンジメントプレートは極端な熱流束に対して0.012°C/Wを提供します。Aavidのベイパーチャンバー強化プレートは大きなダイに均一な温度分布を提供します。材料の選択には、最大導電率のための銅、コスト最適化のためのアルミニウム、耐食性のためのニッケルめっきが含まれます。

冷却剤分配ユニット:Motivair ChilledDoor CDUはN+1ポンプ冗長性で750kWを処理します。CoolIT Coolant Distribution Modulesは8Uフォームファクターで300kWをサポートします。Vertiv XDUユニットは統合リーク検出付きで450kW容量を提供します。選択は施設のレイアウト、冗長性要件、および既存のインフラに依存します。

監視システム:継続的な監視により壊滅的な障害を防ぎます。流量センサーは過熱前に詰まりを検出します。圧力センサーは数秒以内に漏れを特定します。温度アレイはコンポーネント全体の熱性能をマッピングします。導電率計は冷却剤の汚染を警告します。DCIMプラットフォームとの統合により予知保全が可能になります。

冷却剤化学:Nalco Waterのデータセンター冷却剤は低導電率を維持しながら腐食を防ぎます。DowのSYLTHERM特殊流体は極端なアプリケーション向けに-50°Cから260°Cで動作します。Cargillのバイオベース冷却剤は環境の持続可能性を提供します。定期的なテストにより最適な特性が維持され、機器寿命が延長されます。

経済分析が採用決定を推進

ダイレクト・トゥ・チップ冷却への設備投資は、IT負荷1kWあたり1,500〜3,000ドルの範囲です:¹²

インフラコスト: - CDUユニット:300kW容量あたり150,000ドル - 配管とマニホールド:サーバーあたり200ドル - コールドプレート:GPUあたり400〜800ドル - 設置労働:サーバーあたり300ドル - 冷却剤と処理:サーバーあたり50ドル - 監視システム:サーバーあたり100ドル - 42Uラック(20サーバー)あたりの合計:45,000〜65,000ドル

運用コスト削減: - エネルギー削減:0.10ドル/kWhでラックあたり年間12,000ドル - 密度向上:平方フィートあたり40%多いコンピューティング - 機械的冷却削減:ラックあたり年間8,000ドル - ファン電力削減:ラックあたり年間3,000ドル - コンポーネント寿命延長:20%長いMTBF - 回収期間:18〜24ヶ月

総所有コスト:5年間のTCO分析では、高密度GPU展開で空冷と比較して35%低いコストを示しています。1,000 GPU施設はエネルギー消費の削減と密度の向上により5年間で850万ドルを節約します。カーボンクレジットと持続可能性インセンティブは追加の財務的利益を提供します。

既存施設向けレトロフィット戦略

空冷インフラの変換には慎重な計画が必要です:

フェーズ1 - 評価(30日):既存の冷却能力、配電、および構造的サポートを評価します。施設水へのアクセスが可能な最適なCDU位置を特定します。既存のインフラとの競合を避けて配管ルートを計画します。圧力損失とポンプ要件を計算します。中断を最小限に抑える移行スケジュールを策定します。

フェーズ2 - インフラ(60日):予定されたメンテナンスウィンドウ中にCDUと一次配管を設置します。高い戻り水温度に対応するように施設水システムをアップグレードします。配管ネットワーク全体に監視ポイントを追加します。本番展開前にダミー負荷を使用してシステムを試運転します。新しい手順について運用スタッフをトレーニングします。

フェーズ3 - 移行(90日):運用を維持しながらラックを列ごとに変換します。手順を検証するために開発/テスト環境から開始します。メンテナンスウィンドウ中に本番ワークロードを移動します。温度を監視し、最適化のために流量を調整します。後続のフェーズのために学んだ教訓を文書化します。

フェーズ4 - 最適化(継続):フリークーリングを最大化するために冷却剤温度を徐々に上げます。実際の負荷と設計負荷に基づいて流量を調整します。センサーデータを使用して予知保全を実施します。エネルギー効率のために制御アルゴリズムを微調整します。実証された結果に基づいて展開を拡大します。

将来の開発が限界を押し広げる

二相浸漬冷却は、ポンプを完全に排除することでPUE 1.02に近づくことを約束しています。¹³ 誘電性流体はチップ表面で沸騰し、より冷たい表面で凝縮して受動的な循環を行います。初期の展開では空冷と比較して95%のエネルギー削減を示しています。課題には流体コスト(リットルあたり200ドル)と材料互換性の懸念が含まれます。

オンチップ冷却統合は、シリコン基板にマイクロチャネルを直接埋め込みます。¹⁴ IBM Researchは埋め込み冷却を使用して1,700W/cm²の熱除去を実証しました。本番実装はコスト効率の高い製造技術を待っています。この技術は前例のないコンピューティング密度を持つ3Dチップスタッキングを可能にする可能性があります。

廃熱回収は、冷却をコストセンターから収益生成に変換します。ストックホルムのデータセンターは、地域暖房統合を通じて市の暖房の10%を提供しています。¹⁵ 高温ダイレクト・トゥ・チップ冷却により、ヒートポンプなしで熱回収が可能になります。組織は廃熱販売を通じてネットマイナスの冷却コストを達成します。

ダイレクト・トゥ・チップ冷却を実装する組織は、効率の向上、密度の増加、および運用コストの低減により、大幅な競争優位性を獲得します。この技術は、チップあたり700Wを超える次世代GPU展開に不可欠であることが証明されています。早期採用者は、継続的な電力密度の増加に対応できる持続可能なインフラを確立し、遅れを取る者は高価なレトロフィットまたは競争上の不利に直面します。空冷から液冷への移行は、データセンター設計における根本的な変化を表しており、AIの時代に存続するために先見性のある組織が受け入れなければなりません。

重要なポイント

インフラアーキテクト向け: - ダイレクト・トゥ・チップは7つの熱界面のうち5つを排除—空気の50 W/m²Kに対して15,000 W/m²K - PUEが1.58から1.05〜1.15に低下—冷却エネルギーオーバーヘッドの94%削減 - 700W GPUが動作可能

[翻訳のためコンテンツを省略]