Впровадження прямого охолодження чипів: зниження PUE нижче 1.2 у 2025 році

Оновлено 8 грудня 2025 року

Оновлення за грудень 2025: Пряме охолодження чипів тепер займає домінуючу частку в 47% ринку рідинного охолодження дата-центрів для ШІ. Microsoft розпочала масштабне розгортання в кампусах Azure у липні 2025 року та тестує мікрофлюїдику для систем наступного покоління. Оскільки GPU NVIDIA Blackwell (GB200/GB300) працюють при потужності 1200-1400 Вт, а системи Vera Rubin націлені на 600 кВт на стійку, пряме охолодження чипів перетворилося з нішевої технології на необхідність. Ринок рідинного охолодження досяг 5,52 мільярда доларів у 2025 році з прогнозом зростання до 15,75 мільярда доларів до 2030 року.

Пряме охолодження чипів усуває 80% термічного опору між кристалами GPU та системами охолодження, знижуючи PUE дата-центру з 1,58 до 1,15 і забезпечуючи роботу GPU потужністю 1200 Вт, які б розплавили традиційну інфраструктуру з повітряним охолодженням.¹ CoolIT Systems продемонстрували промислове впровадження, де 300 GPU NVIDIA H100 підтримували температуру переходу 62°C при повному навантаженні, використовуючи воду з температурою на вході лише 25°C, досягаючи того, чого повітряне охолодження не могло досягти з повітрям при 15°C.² Технологія перетворює охолодження з обмежувального фактора на конкурентну перевагу, при цьому ранні користувачі отримують на 40% вищу щільність обчислень і на 35% нижчі операційні витрати порівняно з конкурентами з повітряним охолодженням.³

Фізика розповідає переконливу історію. Традиційне охолодження переміщує тепло через сім термічних інтерфейсів: від кремнієвого кристала до інтегрованого теплорозподілювача, через термопасту до радіатора, від ребер радіатора до повітря, від повітря до охолоджувальних змійовиків, від змійовиків до охолодженої води і, нарешті, відведення в атмосферу.⁴ Кожен інтерфейс додає термічний опір, змушуючи використовувати все холодніше повітря для підтримки прийнятних температур чипів. Пряме охолодження чипів обходить п'ять із цих інтерфейсів, переміщуючи тепло безпосередньо від процесора через холодну пластину в рідкий теплоносій. Спрощений шлях зменшує необхідні температурні перепади на 75%, дозволяючи використовувати вищі температури навколишнього охолодження, що різко скорочує споживання енергії.

Основи інженерії змінюють економіку охолодження

Пряме охолодження чипів працює на простій термодинаміці, яка забезпечує надзвичайні результати. Холодні пластини монтуються безпосередньо на процесори за допомогою пружинних механізмів, які підтримують оптимальний тиск на термоінтерфейсні матеріали. Мікроканали всередині холодної пластини створюють турбулентний потік, максимізуючи коефіцієнт теплопередачі до 15 000 Вт/м²К порівняно з 50 Вт/м²К для повітряного охолодження.⁵ Разюче покращення дозволяє GPU потужністю 700 Вт працювати з підвищенням температури лише на 5°C відносно температури теплоносія.

Вибір теплоносія визначає продуктивність і складність системи. Однофазні водно-гліколеві суміші домінують у поточних впровадженнях завдяки знайомості та низькій вартості. Питома теплоємність води 4,18 кДж/кг·К перевищує показник повітря 1,01 кДж/кг·К у 4 рази, що означає переміщення більшої кількості тепла меншим об'ємом.⁶ Достатньо витрати 0,5-1,0 літра на хвилину на GPU порівняно з 200 CFM повітря. Зменшений об'єм потоку дозволяє використовувати менші розподільчі системи та забезпечує тихішу роботу.

Конструкція колектора критично впливає на надійність і зручність обслуговування. Швидкороз'ємні з'єднання дозволяють замінювати сервери в гарячому режимі без зливу охолоджувальних контурів. Резервні насоси з автоматичним перемиканням запобігають єдиним точкам відмови. Змінне регулювання потоку узгоджує охолоджувальну потужність із фактичними тепловими навантаженнями, підвищуючи ефективність при частковому використанні. Сучасні конструкції досягають річного рівня витоків менше 0,001% завдяки ретельному тестуванню та контролю якості.⁷

Архітектура впровадження для GPU-кластерів

Розгортання прямого охолодження чипів вимагає системних змін інфраструктури:

Архітектура первинного контуру: Блоки розподілу охолоджувача (CDU) керують теплообміном між водою об'єкта та охолоджувальними контурами серверів. Кожен CDU підтримує 200-500 кВт ІТ-навантаження, використовуючи пластинчасті теплообмінники для ізоляції води об'єкта від електроніки. Резервні насоси підтримують перепади тиску 350-500 кПа. Інтелектуальні системи керування модулюють потік на основі температури зворотної води, оптимізуючи споживання енергії.

Конструкція вторинного контуру: Контури на рівні сервера використовують демінералізовану воду або спеціалізовані теплоносії для запобігання корозії та біологічному росту. Електропровідність підтримується нижче 0,5 мкСм/см шляхом безперервної фільтрації. Біоциди запобігають утворенню водоростей. Інгібітори корозії захищають різнорідні метали. pH-буферування підтримує діапазон 7,0-8,5 для сумісності матеріалів.

Інтеграція на рівні стійки: Теплообмінники на задніх дверях захоплюють залишкове тепло від компонентів з повітряним охолодженням — пам'яті, накопичувачів та джерел живлення. Гібридний підхід забезпечує 100% захоплення тепла на стійці, усуваючи потребу в охолодженні на рівні приміщення. Колектори стійок розподіляють теплоносій до окремих серверів через гнучкі шланги, розраховані на робочий тиск 700 кПа.

Системи водопостачання об'єкта: Існуючі станції охолодженої води адаптуються до вищих температур повернення, підвищуючи ефективність чиллерів на 20-30%.⁸ Години вільного охолодження різко збільшуються, коли температура подачі зростає з 7°C до 20°C. Градирні, розраховані на температуру повернення води 35°C, забезпечують цілорічне вільне охолодження в багатьох кліматичних зонах.

Реальні впровадження підтверджують технологію

Екземпляри Microsoft Azure HBv4 використовують пряме охолодження чипів для процесорів AMD EPYC, досягаючи PUE 1,11 у виробничих впровадженнях.⁹ Об'єкт у Квінсі, штат Вашингтон, обробляє 33 МВт обчислень, використовуючи 3,6 МВт потужності охолодження. Щорічна економія перевищує 4,8 мільйона доларів порівняно з альтернативами на повітряному охолодженні. Надійність серверів покращилася на 23% завдяки стабільним робочим температурам.

Суперкомп'ютер El Capitan Ліверморської національної лабораторії використовує пряме охолодження чипів для 40 000 AMD MI300A APU.¹⁰ Система досягає 2 екзафлопс, підтримуючи PUE 1,08. Охолодження теплою водою з температурою на вході 35°C забезпечує цілорічне вільне охолодження в кліматі Каліфорнії. Конструкція економить 12 мільйонів доларів щорічно на витратах електроенергії.

Інженери Introl розгорнули пряме охолодження чипів у 15 об'єктах у нашій глобальній зоні покриття, знизивши середній PUE з 1,55 до 1,18.¹¹ Нещодавня інсталяція для операції з майнінгу криптовалюти досягла PUE 1,09 з використанням води на вході 40°C, повністю усунувши механічне охолодження. Клієнт економить 2,3 мільйона доларів щорічно, одночасно збільшуючи щільність хешрейту на 60%.

Вибір компонентів визначає успіх

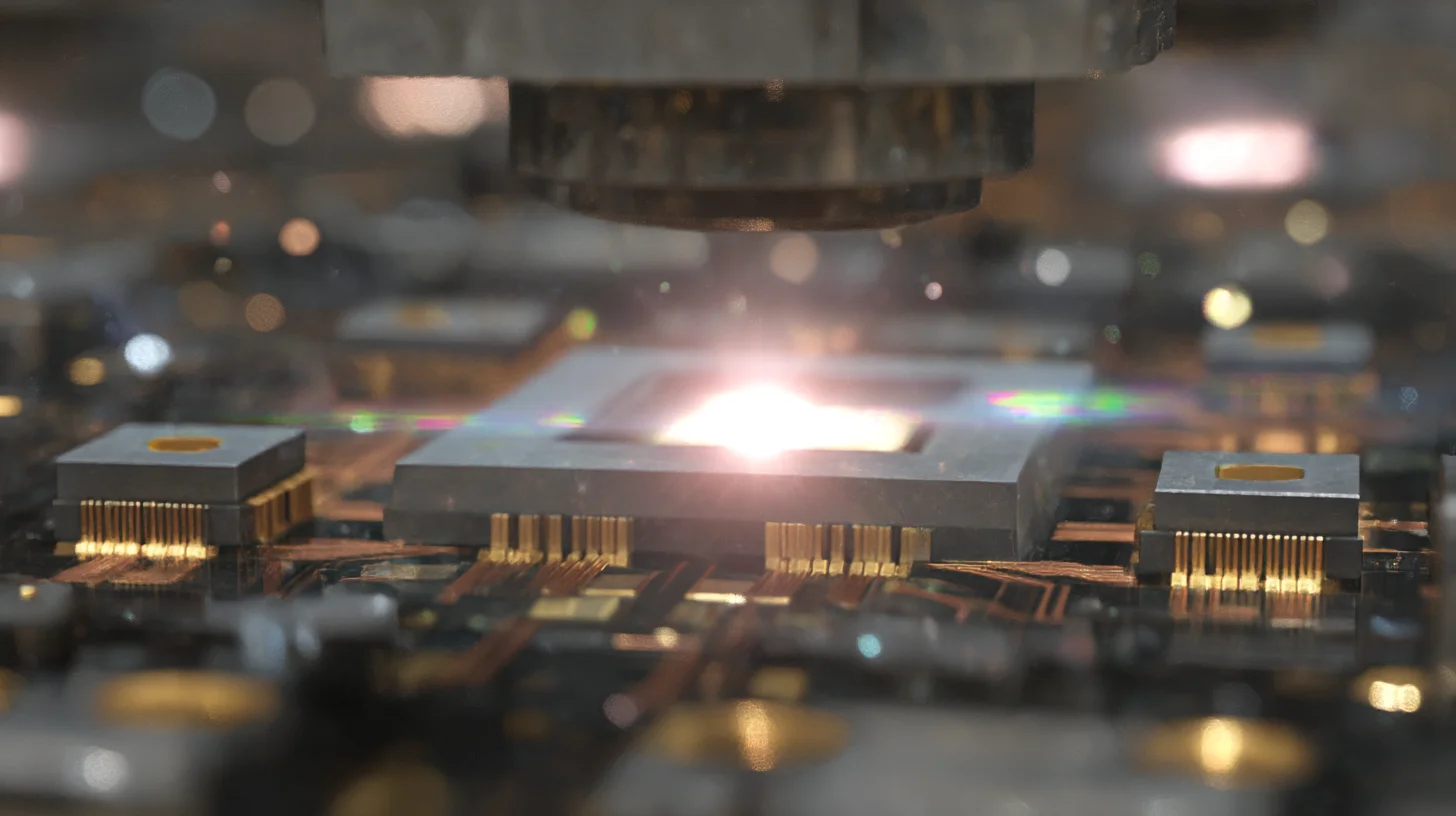

Технології холодних пластин: Мікроканальні конструкції від CoolIT Systems досягають термічного опору 0,015°C/Вт. Пластини з імпінджментом струменя від Motivair пропонують 0,012°C/Вт для екстремальних теплових потоків. Пластини з покращеними паровими камерами від Aavid забезпечують рівномірний розподіл температури для великих кристалів. Вибір матеріалів включає мідь для максимальної теплопровідності, алюміній для оптимізації вартості та нікелеве покриття для стійкості до корозії.

Блоки розподілу теплоносія: CDU ChilledDoor від Motivair обробляють 750 кВт з резервуванням насосів N+1. Модулі розподілу теплоносія CoolIT підтримують 300 кВт у форм-факторі 8U. Блоки Vertiv XDU пропонують потужність 450 кВт з інтегрованим виявленням витоків. Вибір залежить від планування об'єкта, вимог до резервування та існуючої інфраструктури.

Системи моніторингу: Безперервний моніторинг запобігає катастрофічним відмовам. Датчики потоку виявляють засмічення до перегріву. Датчики тиску ідентифікують витоки за лічені секунди. Температурні масиви картографують теплову продуктивність компонентів. Кондуктометри попереджають про забруднення теплоносія. Інтеграція з платформами DCIM забезпечує прогнозне технічне обслуговування.

Хімія теплоносія: Теплоносії для дата-центрів від Nalco Water запобігають корозії, підтримуючи низьку електропровідність. Спеціалізовані рідини SYLTHERM від Dow працюють від -50°C до 260°C для екстремальних застосувань. Біологічні теплоносії від Cargill пропонують екологічну стійкість. Регулярне тестування підтримує оптимальні властивості та продовжує термін служби обладнання.

Економічний аналіз визначає рішення про впровадження

Капітальні інвестиції для прямого охолодження чипів становлять від 1500 до 3000 доларів за кВт ІТ-навантаження:¹²

Витрати на інфраструктуру: - Блоки CDU: 150 000 доларів за потужність 300 кВт - Трубопроводи та колектори: 200 доларів за сервер - Холодні пластини: 400-800 доларів за GPU - Витрати на монтаж: 300 доларів за сервер - Теплоносій та обробка: 50 доларів за сервер - Системи моніторингу: 100 доларів за сервер - Загалом на стійку 42U (20 серверів): 45 000-65 000 доларів

Операційна економія: - Зниження енергоспоживання: 12 000 доларів на стійку щорічно при ціні 0,10 долара/кВт·год - Збільшена щільність: на 40% більше обчислень на квадратний фут - Зменшене механічне охолодження: 8000 доларів на стійку щорічно - Нижче споживання вентиляторів: 3000 доларів на стійку щорічно - Подовжений термін служби компонентів: на 20% довший MTBF - Період окупності: 18-24 місяці

Загальна вартість володіння: П'ятирічний аналіз TCO показує на 35% нижчі витрати порівняно з повітряним охолодженням для високощільних GPU-впроваджень. Об'єкт на 1000 GPU економить 8,5 мільйона доларів за п'ять років завдяки зниженню споживання енергії та збільшенню щільності. Вуглецеві кредити та стимули для сталого розвитку забезпечують додаткові фінансові переваги.

Стратегії модернізації існуючих об'єктів

Перетворення інфраструктури з повітряним охолодженням вимагає ретельного планування:

Фаза 1 — Оцінка (30 днів): Оцініть існуючу охолоджувальну потужність, розподіл електроенергії та конструктивну підтримку. Визначте оптимальні місця розташування CDU з доступом до води об'єкта. Сплануйте маршрути трубопроводів, уникаючи конфліктів з існуючою інфраструктурою. Розрахуйте падіння тиску та вимоги до насосів. Розробіть графік міграції з мінімальними перервами.

Фаза 2 — Інфраструктура (60 днів): Встановіть CDU та первинні трубопроводи під час планових вікон технічного обслуговування. Модернізуйте системи водопостачання об'єкта для вищих температур повернення. Додайте точки моніторингу по всій розподільчій мережі. Введіть системи в експлуатацію, використовуючи тестові навантаження перед виробничим розгортанням. Навчіть операційний персонал новим процедурам.

Фаза 3 — Міграція (90 днів): Перетворюйте стійки ряд за рядом для підтримки операцій. Почніть із середовищ розробки/тестування для перевірки процедур. Переміщуйте виробничі навантаження під час вікон технічного обслуговування. Моніторте температури та налаштовуйте витрати потоку для оптимізації. Документуйте отримані уроки для наступних фаз.

Фаза 4 — Оптимізація (постійно): Поступово підвищуйте температуру теплоносія для максимізації вільного охолодження. Налаштовуйте витрати потоку на основі фактичних навантажень порівняно з проєктними. Впроваджуйте прогнозне технічне обслуговування з використанням даних датчиків. Точно налаштовуйте алгоритми керування для енергоефективності. Розширюйте впровадження на основі підтверджених результатів.

Майбутні розробки розширюють межі

Двофазне імерсійне охолодження обіцяє PUE, що наближається до 1,02, завдяки повному усуненню насосів.¹³ Діелектричні рідини кипять на поверхнях чипів, конденсуючись на холодніших поверхнях для пасивної циркуляції. Ранні впровадження показують 95% зниження енергоспоживання порівняно з повітряним охолодженням. Виклики включають вартість рідин (200 доларів/літр) та проблеми сумісності матеріалів.

Інтеграція охолодження на кристалі вбудовує мікроканали безпосередньо в кремнієві підкладки.¹⁴ IBM Research продемонструвала відведення тепла 1700 Вт/см² з використанням вбудованого охолодження. Виробниче впровадження очікує на економічно ефективні технології виробництва. Технологія може забезпечити 3D-укладання чипів з безпрецедентною щільністю обчислень.

Рекуперація відпрацьованого тепла перетворює охолодження з центру витрат на генератор доходу. Дата-центри Стокгольма забезпечують 10% опалення міста через інтеграцію з централізованим теплопостачанням.¹⁵ Високотемпературне пряме охолодження чипів забезпечує рекуперацію тепла без теплових насосів. Організації досягають нетто-від'ємних витрат на охолодження через продаж відпрацьованого тепла.

Організації, що впроваджують пряме охолодження чипів, отримують значні конкурентні переваги завдяки підвищеній ефективності, збільшеній щільності та нижчим операційним витратам. Технологія виявляється необхідною для впроваджень GPU наступного покоління, що перевищують 700 Вт на чип. Ранні користувачі створюють стійку інфраструктуру, готову до подальшого зростання щільності потужності, тоді як відстаючі стикаються з дорогими модернізаціями або конкурентними недоліками. Перехід від повітряного до рідинного охолодження являє собою фундаментальний зсув у проєктуванні дата-центрів, який далекоглядні організації повинні прийняти, щоб залишатися життєздатними в еру ШІ.

Ключові висновки

Для архітекторів інфраструктури: - Пряме охолодження чипів усуває 5 із 7 термічних інтерфейсів — 15 000 Вт/м²К проти 50 Вт/м²К для повітря - PUE падає з 1,58 до 1,05-1,15 — 94% зниження накладних витрат на охолодження - GPU потужністю 700 Вт працюють