Implementierung von Direct-to-Chip-Kühlung: PUE unter 1,2 senken in 2025

Aktualisiert am 8. Dezember 2025

Update Dezember 2025: Direct-to-Chip-Kühlung dominiert nun mit einem Marktanteil von 47% den Flüssigkeitskühlungsmarkt für KI-Rechenzentren. Microsoft begann im Juli 2025 mit der Flottenbereitstellung in allen Azure-Campussen und testet Mikrofluidik für Systeme der nächsten Generation. Mit NVIDIA Blackwell GPUs (GB200/GB300), die bei 1.200-1.400W arbeiten, und Vera Rubin-Systemen, die 600kW pro Rack anstreben, hat sich Direct-to-Chip-Kühlung von einer Nische zur Notwendigkeit entwickelt. Der Flüssigkeitskühlungsmarkt erreichte 2025 ein Volumen von 5,52 Milliarden Dollar und soll bis 2030 auf 15,75 Milliarden Dollar anwachsen.

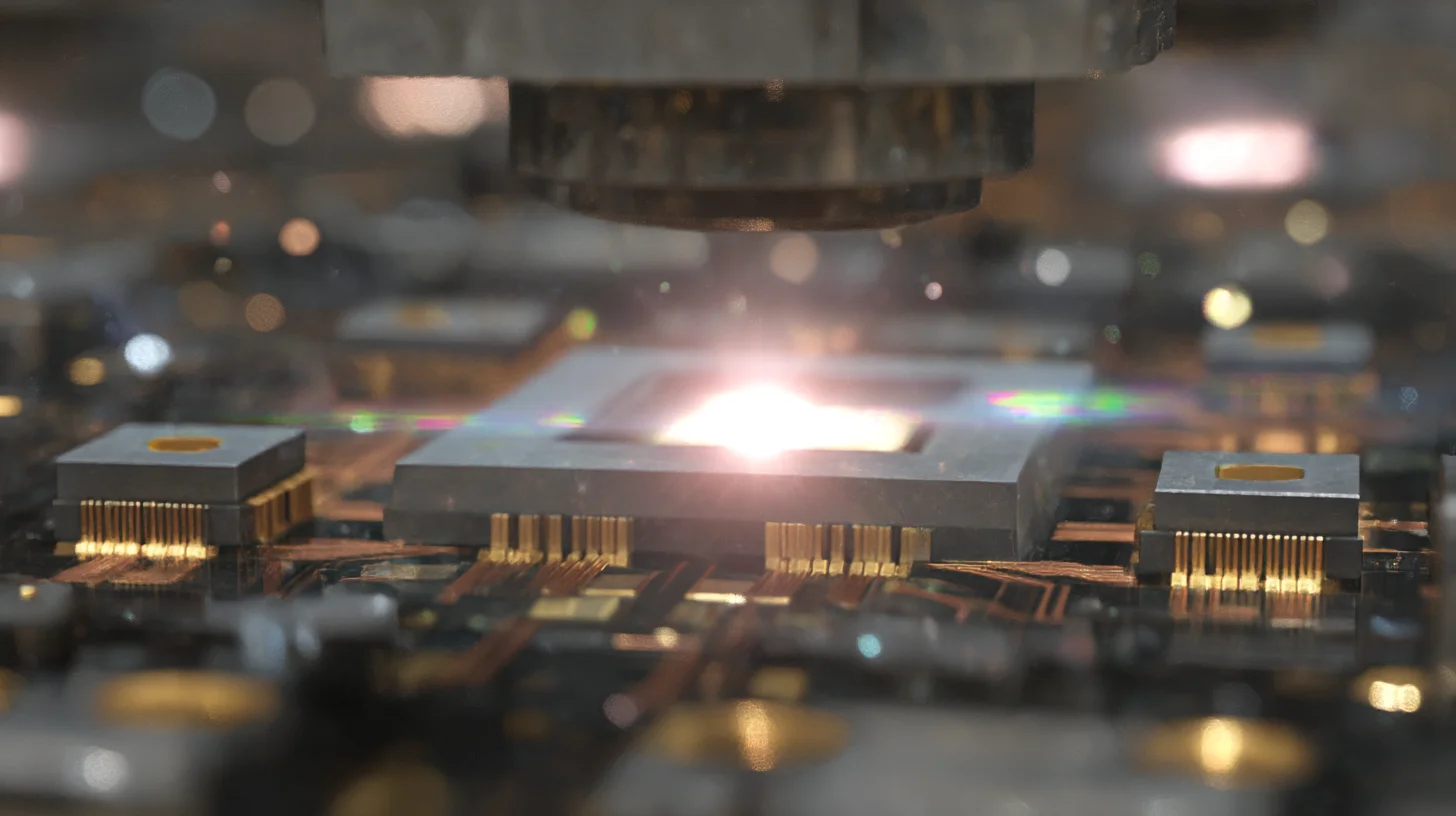

Direct-to-Chip-Kühlung eliminiert 80% des thermischen Widerstands zwischen GPU-Dies und Kühlsystemen, senkt den Rechenzentrums-PUE von 1,58 auf 1,15 und ermöglicht gleichzeitig 1.200W-GPUs, die herkömmliche luftgekühlte Infrastruktur zum Schmelzen bringen würden.¹ CoolIT Systems demonstrierte eine Produktionsbereitstellung, bei der 300 NVIDIA H100 GPUs bei voller Last 62°C Sperrschichttemperaturen mit nur 25°C Einlasswasser hielten – etwas, das Luftkühlung selbst mit 15°C Einlassluft nicht erreichen konnte.² Die Technologie verwandelt Kühlung von einem limitierenden Faktor in einen Wettbewerbsvorteil, wobei frühe Anwender 40% höhere Rechendichte und 35% niedrigere Betriebskosten als luftgekühlte Wettbewerber erzielen.³

Die Physik erzählt eine überzeugende Geschichte. Traditionelle Kühlung bewegt Wärme durch sieben thermische Schnittstellen: vom Silizium-Die zum integrierten Wärmeverteiler, Wärmeleitpaste zum Kühlkörper, Kühlkörperrippen zur Luft, Luft zu Kühlschlangen, Schlangen zu gekühltem Wasser und schließlich Ableitung in die Atmosphäre.⁴ Jede Schnittstelle fügt thermischen Widerstand hinzu und zwingt zu immer kälterer Luft, um akzeptable Chiptemperaturen aufrechtzuerhalten. Direct-to-Chip-Kühlung umgeht fünf dieser Schnittstellen und bewegt Wärme direkt vom Prozessor durch eine Kühlplatte in den Flüssigkühlmittel. Der vereinfachte Pfad reduziert erforderliche Temperaturdifferenzen um 75%, ermöglicht höhere Umgebungskühltemperaturen und senkt den Energieverbrauch drastisch.

Technische Grundlagen verändern die Kühlungswirtschaft

Direct-to-Chip-Kühlung arbeitet nach einfachen thermodynamischen Prinzipien, die außergewöhnliche Ergebnisse liefern. Kühlplatten werden mittels federbelasteter Mechanismen direkt auf Prozessoren montiert, die optimalen Druck über thermische Schnittstellenmaterialien aufrechterhalten. Mikrokanäle innerhalb der Kühlplatte erzeugen turbulente Strömung und maximieren den Wärmeübertragungskoeffizienten auf 15.000 W/m²K im Vergleich zu 50 W/m²K bei Luftkühlung.⁵ Die dramatische Verbesserung ermöglicht es 700W-GPUs, mit nur 5°C Temperaturanstieg über der Kühlmitteltemperatur zu arbeiten.

Die Kühlmittelauswahl bestimmt Systemleistung und -komplexität. Einphasige Wasser-Glykol-Mischungen dominieren aktuelle Bereitstellungen aufgrund ihrer Vertrautheit und niedrigen Kosten. Wassers spezifische Wärmekapazität von 4,18 kJ/kg·K übertrifft die von Luft (1,01 kJ/kg·K) um das Vierfache, was bedeutet, dass weniger Volumen mehr Wärme transportiert.⁶ Durchflussraten von 0,5-1,0 Litern pro Minute pro GPU genügen, verglichen mit 200 CFM Luft. Das reduzierte Strömungsvolumen ermöglicht kleinere Verteilungssysteme und leiseren Betrieb.

Das Verteilerdesign beeinflusst Zuverlässigkeit und Wartbarkeit entscheidend. Schnellanschlüsse ermöglichen den Hot-Swap von Servern ohne Entleeren der Kühlkreisläufe. Redundante Pumpen mit automatischer Umschaltung verhindern einzelne Ausfallpunkte. Variable Durchflussregelung passt die Kühlkapazität an tatsächliche Wärmelasten an und verbessert die Effizienz bei Teillast. Moderne Designs erreichen durch rigorose Tests und Qualitätskontrolle weniger als 0,001% jährliche Leckageraten.⁷

Implementierungsarchitektur für GPU-Cluster

Die Bereitstellung von Direct-to-Chip-Kühlung erfordert systematische Infrastrukturänderungen:

Primärkreis-Architektur: Cooling Distribution Units (CDUs) verwalten den Wärmeaustausch zwischen Gebäudewasser und Server-Kühlkreisläufen. Jede CDU unterstützt 200-500kW IT-Last unter Verwendung von Plattenwärmetauschern zur Isolierung des Gebäudewassers von der Elektronik. Redundante Pumpen halten 350-500 kPa Druckdifferenzen aufrecht. Intelligente Steuerungen modulieren den Durchfluss basierend auf der Rücklaufwassertemperatur und optimieren den Energieverbrauch.

Sekundärkreis-Design: Kühlkreisläufe auf Serverebene verwenden demineralisiertes Wasser oder spezialisierte Kühlmittel, um Korrosion und biologisches Wachstum zu verhindern. Die Leitfähigkeit bleibt durch kontinuierliche Filtration unter 0,5 μS/cm. Biozide verhindern Algenbildung. Korrosionsinhibitoren schützen ungleiche Metalle. pH-Pufferung hält einen Bereich von 7,0-8,5 für Materialkompatibilität.

Integration auf Rack-Ebene: Wärmetauscher an der Rückseite erfassen Restwärme aus luftgekühlten Speichern, Storage und Netzteilen. Der hybride Ansatz erreicht 100% Wärmeerfassung am Rack und eliminiert die Notwendigkeit raumweiter Kühlung. Rack-Verteiler verteilen Kühlmittel über flexible Schläuche mit 700 kPa Betriebsdruck an einzelne Server.

Gebäudewassersysteme: Bestehende Kaltwasseranlagen passen sich an höhere Rücklauftemperaturen an und verbessern die Kältemaschinen-Effizienz um 20-30%.⁸ Die Stunden für freie Kühlung steigen dramatisch an, wenn die Vorlauftemperaturen von 7°C auf 20°C steigen. Kühltürme, die für 35°C Rücklaufwasser ausgelegt sind, ermöglichen in vielen Klimazonen ganzjährige freie Kühlung.

Praxiseinsätze beweisen die Technologie

Microsofts Azure HBv4-Instanzen verwenden Direct-to-Chip-Kühlung für AMD EPYC-Prozessoren und erreichen PUE 1,11 im Produktionsbetrieb.⁹ Die Anlage in Quincy, Washington, verarbeitet 33MW Rechenleistung mit 3,6MW Kühlleistung. Jährliche Einsparungen übersteigen 4,8 Millionen Dollar im Vergleich zu luftgekühlten Alternativen. Die Serverzuverlässigkeit verbesserte sich aufgrund konstanter Betriebstemperaturen um 23%.

Der El Capitan Supercomputer des Lawrence Livermore National Laboratory setzt Direct-to-Chip-Kühlung für 40.000 AMD MI300A APUs ein.¹⁰ Das System erreicht 2 Exaflops bei einem PUE von 1,08. Warmwasserkühlung mit 35°C Einlasstemperatur ermöglicht ganzjährige freie Kühlung im kalifornischen Klima. Das Design spart jährlich 12 Millionen Dollar an Stromkosten.

Introl-Ingenieure haben Direct-to-Chip-Kühlung in 15 Einrichtungen in unserem globalen Abdeckungsgebiet implementiert und den durchschnittlichen PUE von 1,55 auf 1,18 gesenkt.¹¹ Eine kürzliche Installation für einen Kryptowährungs-Mining-Betrieb erreichte PUE 1,09 mit 40°C Einlasswasser und eliminierte mechanische Kühlung vollständig. Der Kunde spart jährlich 2,3 Millionen Dollar bei gleichzeitiger Steigerung der Hashrate-Dichte um 60%.

Komponentenauswahl bestimmt den Erfolg

Kühlplattentechnologien: Mikrokanaldesigns von CoolIT Systems erreichen 0,015°C/W thermischen Widerstand. Jet-Impingement-Platten von Motivair bieten 0,012°C/W für extreme Wärmeströme. Dampfkammer-verstärkte Platten von Aavid bieten gleichmäßige Temperaturverteilung für große Dies. Materialoptionen umfassen Kupfer für maximale Leitfähigkeit, Aluminium für Kostenoptimierung und Nickelbeschichtung für Korrosionsbeständigkeit.

Coolant Distribution Units: Motivair ChilledDoor CDUs bewältigen 750kW mit N+1-Pumpenredundanz. CoolIT Coolant Distribution Modules unterstützen 300kW im 8U-Formfaktor. Vertiv XDU-Einheiten bieten 450kW Kapazität mit integrierter Leckerkennung. Die Auswahl hängt von Anlagenlayout, Redundanzanforderungen und bestehender Infrastruktur ab.

Überwachungssysteme: Kontinuierliche Überwachung verhindert katastrophale Ausfälle. Durchflusssensoren erkennen Verstopfungen, bevor Überhitzung auftritt. Drucksensoren identifizieren Lecks innerhalb von Sekunden. Temperaturarrays kartieren die thermische Leistung über Komponenten hinweg. Leitfähigkeitsmesser warnen vor Kühlmittelverunreinigung. Integration mit DCIM-Plattformen ermöglicht vorausschauende Wartung.

Kühlmittelchemie: Die Rechenzentrums-Kühlmittel von Nalco Water verhindern Korrosion bei gleichzeitiger Aufrechterhaltung niedriger Leitfähigkeit. Dows spezialisierte SYLTHERM-Flüssigkeiten arbeiten von -50°C bis 260°C für extreme Anwendungen. Cargills biobasierte Kühlmittel bieten ökologische Nachhaltigkeit. Regelmäßige Tests erhalten optimale Eigenschaften und verlängern die Gerätelebensdauer.

Wirtschaftlichkeitsanalyse treibt Adoptionsentscheidungen

Kapitalinvestitionen für Direct-to-Chip-Kühlung reichen von 1.500 bis 3.000 Dollar pro kW IT-Last:¹²

Infrastrukturkosten: - CDU-Einheiten: 150.000 Dollar pro 300kW Kapazität - Verrohrung und Verteiler: 200 Dollar pro Server - Kühlplatten: 400-800 Dollar pro GPU - Installationsarbeit: 300 Dollar pro Server - Kühlmittel und Aufbereitung: 50 Dollar pro Server - Überwachungssysteme: 100 Dollar pro Server - Gesamtkosten pro 42U-Rack (20 Server): 45.000-65.000 Dollar

Betriebseinsparungen: - Energiereduzierung: 12.000 Dollar pro Rack jährlich bei 0,10 Dollar/kWh - Erhöhte Dichte: 40% mehr Rechenleistung pro Quadratmeter - Reduzierte mechanische Kühlung: 8.000 Dollar pro Rack jährlich - Geringere Lüfterleistung: 3.000 Dollar pro Rack jährlich - Verlängerte Komponentenlebensdauer: 20% längere MTBF - Amortisationszeit: 18-24 Monate

Total Cost of Ownership: Eine Fünfjahres-TCO-Analyse zeigt 35% niedrigere Kosten gegenüber Luftkühlung für Hochdichte-GPU-Bereitstellungen. Eine Anlage mit 1.000 GPUs spart über fünf Jahre 8,5 Millionen Dollar durch reduzierten Energieverbrauch und erhöhte Dichte. Emissionsgutschriften und Nachhaltigkeitsanreize bieten zusätzliche finanzielle Vorteile.

Nachrüstungsstrategien für bestehende Anlagen

Die Umstellung luftgekühlter Infrastruktur erfordert sorgfältige Planung:

Phase 1 - Bewertung (30 Tage): Evaluierung bestehender Kühlkapazität, Stromverteilung und struktureller Tragfähigkeit. Identifizierung optimaler CDU-Standorte mit Zugang zu Gebäudewasser. Planung von Leitungswegen unter Vermeidung von Konflikten mit bestehender Infrastruktur. Berechnung von Druckverlusten und Pumpenanforderungen. Entwicklung eines Migrationsplans zur Minimierung von Unterbrechungen.

Phase 2 - Infrastruktur (60 Tage): Installation von CDUs und Hauptverrohrung während geplanter Wartungsfenster. Upgrade der Gebäudewassersysteme für höhere Rücklauftemperaturen. Hinzufügen von Überwachungspunkten im gesamten Verteilungsnetz. Inbetriebnahme der Systeme mit Testlasten vor Produktionsbereitstellung. Schulung des Betriebspersonals in neuen Verfahren.

Phase 3 - Migration (90 Tage): Reihenweise Umstellung der Racks zur Aufrechterhaltung des Betriebs. Start mit Entwicklungs-/Testumgebungen zur Validierung der Verfahren. Verschiebung produktiver Workloads während Wartungsfenstern. Temperaturüberwachung und Durchflussanpassung zur Optimierung. Dokumentation der gewonnenen Erkenntnisse für nachfolgende Phasen.

Phase 4 - Optimierung (fortlaufend): Schrittweise Erhöhung der Kühlmitteltemperaturen zur Maximierung der freien Kühlung. Anpassung der Durchflussraten basierend auf tatsächlichen versus geplanten Lasten. Implementierung vorausschauender Wartung unter Verwendung von Sensordaten. Feinabstimmung der Regelalgorithmen für Energieeffizienz. Erweiterung der Bereitstellung basierend auf bewährten Ergebnissen.

Zukünftige Entwicklungen verschieben Grenzen

Zweiphasen-Immersionskühlung verspricht einen PUE nahe 1,02 durch vollständige Eliminierung von Pumpen.¹³ Dielektrische Flüssigkeiten verdampfen an Chipoberflächen und kondensieren an kühleren Oberflächen für passive Zirkulation. Frühe Bereitstellungen zeigen 95% Energiereduzierung gegenüber Luftkühlung. Herausforderungen umfassen Flüssigkeitskosten (200 Dollar/Liter) und Materialkompatibilitätsprobleme.

On-Chip-Kühlungsintegration bettet Mikrokanäle direkt in Siliziumsubstrate ein.¹⁴ IBM Research demonstrierte 1.700 W/cm² Wärmeabfuhr mittels eingebetteter Kühlung. Die Produktionsimplementierung wartet auf kosteneffektive Fertigungstechniken. Die Technologie könnte 3D-Chip-Stacking mit beispielloser Rechendichte ermöglichen.

Abwärmenutzung verwandelt Kühlung von einem Kostenfaktor in eine Einnahmequelle. Stockholms Rechenzentren liefern 10% der städtischen Heizung durch Fernwärme-Integration.¹⁵ Hochtemperatur-Direct-to-Chip-Kühlung ermöglicht Wärmerückgewinnung ohne Wärmepumpen. Organisationen erreichen netto-negative Kühlkosten durch Abwärmeverkauf.

Organisationen, die Direct-to-Chip-Kühlung implementieren, erzielen erhebliche Wettbewerbsvorteile durch verbesserte Effizienz, erhöhte Dichte und niedrigere Betriebskosten. Die Technologie erweist sich als unverzichtbar für GPU-Bereitstellungen der nächsten Generation mit über 700W pro Chip. Frühe Anwender etablieren nachhaltige Infrastruktur, die für kontinuierliche Steigerungen der Leistungsdichte bereit ist, während Nachzügler teure Nachrüstungen oder Wettbewerbsnachteile riskieren. Der Übergang von Luft- zu Flüssigkeitskühlung stellt einen fundamentalen Wandel im Rechenzentrumsdesign dar, den zukunftsorientierte Organisationen annehmen müssen, um in der KI-Ära wettbewerbsfähig zu bleiben.

Kernerkenntnisse

Für Infrastrukturarchitekten: - Direct-to-Chip eliminiert 5 von 7 thermischen Schnittstellen – 15.000 W/m²K vs. 50 W/m²K für Luft - PUE sinkt von 1,58 auf 1,05-1,15 – 94% Reduzierung des Kühlenergie-Overheads - 700W-GPUs arbeiten mit nur 5°C Temperaturanstieg über der Kühlmitteltemperatur