การติดตั้งระบบระบายความร้อนแบบ Direct-to-Chip: ลด PUE ให้ต่ำกว่า 1.2 ในปี 2025

อัปเดต 8 ธันวาคม 2025

อัปเดตธันวาคม 2025: ระบบระบายความร้อนแบบ Direct-to-chip ครองส่วนแบ่งตลาดระบบระบายความร้อนด้วยของเหลวสำหรับ AI datacenter ถึง 47% Microsoft เริ่มติดตั้งทั่วทั้ง Azure campus ในเดือนกรกฎาคม 2025 และกำลังทดสอบระบบ microfluidics สำหรับระบบรุ่นถัดไป ด้วย NVIDIA Blackwell GPU (GB200/GB300) ที่ทำงานที่ 1,200-1,400W และระบบ Vera Rubin ที่มุ่งเป้า 600kW ต่อ rack ระบบ direct-to-chip cooling จึงเปลี่ยนจากเทคโนโลยีเฉพาะทางมาเป็นสิ่งจำเป็น ตลาดระบบระบายความร้อนด้วยของเหลวมีมูลค่าถึง 5.52 พันล้านดอลลาร์ในปี 2025 และคาดว่าจะแตะ 15.75 พันล้านดอลลาร์ภายในปี 2030

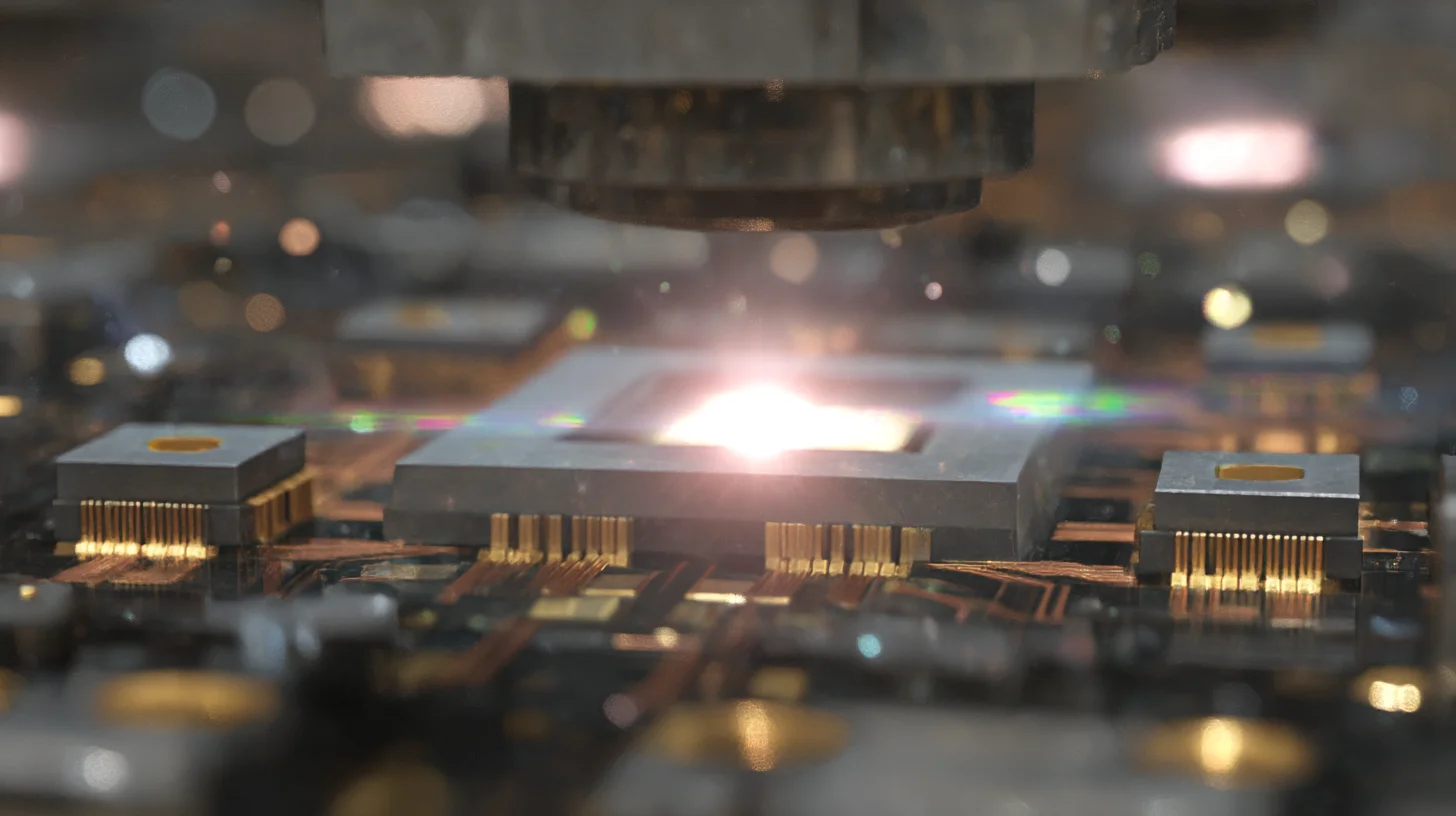

ระบบระบายความร้อนแบบ Direct-to-chip ลดความต้านทานความร้อนระหว่าง GPU die และระบบระบายความร้อนได้ 80% ทำให้ PUE ของ data center ลดจาก 1.58 เหลือ 1.15 พร้อมรองรับ GPU 1,200W ที่จะทำให้โครงสร้างพื้นฐานแบบระบายความร้อนด้วยอากาศแบบเดิมละลายได้¹ CoolIT Systems สาธิตการติดตั้งจริงที่ NVIDIA H100 จำนวน 300 ตัวรักษาอุณหภูมิ junction ที่ 62°C ภายใต้โหลดเต็มที่โดยใช้น้ำอุณหภูมิขาเข้าเพียง 25°C ซึ่งเป็นสิ่งที่ระบบระบายความร้อนด้วยอากาศทำไม่ได้แม้จะใช้อากาศขาเข้า 15°C ก็ตาม² เทคโนโลยีนี้เปลี่ยนระบบระบายความร้อนจากปัจจัยจำกัดให้กลายเป็นข้อได้เปรียบทางการแข่งขัน โดยผู้นำร่องได้รับความหนาแน่นการประมวลผลสูงขึ้น 40% และต้นทุนการดำเนินงานต่ำกว่าคู่แข่งที่ใช้ระบบระบายความร้อนด้วยอากาศถึง 35%³

หลักฟิสิกส์บอกเล่าเรื่องราวที่น่าสนใจ ระบบระบายความร้อนแบบดั้งเดิมเคลื่อนย้ายความร้อนผ่าน thermal interface เจ็ดจุด: จาก silicon die ไปยัง integrated heat spreader, thermal paste ไปยัง heatsink, ครีบ heatsink ไปยังอากาศ, อากาศไปยัง cooling coil, coil ไปยังน้ำเย็น และสุดท้ายปล่อยสู่บรรยากาศ⁴ แต่ละ interface เพิ่มความต้านทานความร้อน ทำให้ต้องใช้อากาศเย็นขึ้นเรื่อยๆ เพื่อรักษาอุณหภูมิชิปให้อยู่ในระดับที่ยอมรับได้ ระบบ Direct-to-chip cooling ข้ามผ่าน interface เหล่านี้ไปห้าจุด เคลื่อนย้ายความร้อนโดยตรงจากโปรเซสเซอร์ผ่าน cold plate เข้าสู่สารหล่อเย็น เส้นทางที่ง่ายขึ้นนี้ลดความแตกต่างของอุณหภูมิที่ต้องการลง 75% ทำให้สามารถใช้อุณหภูมิการระบายความร้อนแวดล้อมที่สูงขึ้นซึ่งลดการใช้พลังงานอย่างมาก

หลักพื้นฐานทางวิศวกรรมเปลี่ยนโฉมเศรษฐศาสตร์การระบายความร้อน

ระบบระบายความร้อนแบบ Direct-to-chip ทำงานบนหลักอุณหพลศาสตร์ที่ตรงไปตรงมาแต่ให้ผลลัพธ์ที่โดดเด่น Cold plate ติดตั้งโดยตรงบนโปรเซสเซอร์โดยใช้กลไกสปริงที่รักษาแรงกดที่เหมาะสมตลอดพื้นผิว thermal interface material Microchannel ภายใน cold plate สร้างการไหลแบบปั่นป่วนเพื่อเพิ่มค่า heat transfer coefficient ให้สูงถึง 15,000 W/m²K เทียบกับ 50 W/m²K สำหรับการระบายความร้อนด้วยอากาศ⁵ การปรับปรุงอย่างมากนี้ทำให้ GPU 700W สามารถทำงานโดยมีอุณหภูมิสูงขึ้นเพียง 5°C จากอุณหภูมิสารหล่อเย็น

การเลือกสารหล่อเย็นกำหนดประสิทธิภาพและความซับซ้อนของระบบ ส่วนผสม water-glycol แบบเฟสเดียวครองการติดตั้งในปัจจุบันเนื่องจากความคุ้นเคยและต้นทุนต่ำ ความจุความร้อนจำเพาะของน้ำที่ 4.18 kJ/kg·K สูงกว่าอากาศที่ 1.01 kJ/kg·K ถึง 4 เท่า หมายความว่าปริมาณที่น้อยกว่าเคลื่อนย้ายความร้อนได้มากกว่า⁶ อัตราการไหล 0.5-1.0 ลิตรต่อนาทีต่อ GPU เพียงพอแล้ว เทียบกับอากาศ 200 CFM ปริมาณการไหลที่ลดลงทำให้ระบบจ่ายมีขนาดเล็กลงและเงียบกว่า

การออกแบบ manifold มีผลกระทบอย่างมากต่อความน่าเชื่อถือและความสะดวกในการบำรุงรักษา ข้อต่อ quick-disconnect ช่วยให้สลับเซิร์ฟเวอร์ได้โดยไม่ต้องถ่ายสารหล่อเย็นออกจากวงจร ปั๊มสำรองพร้อม automatic failover ป้องกัน single point of failure การควบคุมการไหลแบบปรับได้จับคู่ความสามารถในการระบายความร้อนกับภาระความร้อนจริง ปรับปรุงประสิทธิภาพในช่วงที่ใช้งานบางส่วน การออกแบบสมัยใหม่มีอัตราการรั่วไหลน้อยกว่า 0.001% ต่อปีผ่านการทดสอบและควบคุมคุณภาพอย่างเข้มงวด⁷

สถาปัตยกรรมการติดตั้งสำหรับ GPU cluster

การติดตั้งระบบระบายความร้อนแบบ Direct-to-chip ต้องมีการเปลี่ยนแปลงโครงสร้างพื้นฐานอย่างเป็นระบบ:

สถาปัตยกรรม Primary Loop: Cooling Distribution Unit (CDU) จัดการการแลกเปลี่ยนความร้อนระหว่างน้ำของสถานที่และวงจรระบายความร้อนเซิร์ฟเวอร์ CDU แต่ละตัวรองรับโหลด IT 200-500kW โดยใช้ plate heat exchanger เพื่อแยกน้ำของสถานที่ออกจากอุปกรณ์อิเล็กทรอนิกส์ ปั๊มสำรองรักษาความแตกต่างของความดัน 350-500 kPa การควบคุมอัจฉริยะปรับการไหลตามอุณหภูมิน้ำขากลับเพื่อเพิ่มประสิทธิภาพการใช้พลังงาน

การออกแบบ Secondary Loop: วงจรระดับเซิร์ฟเวอร์ใช้น้ำกลั่นหรือสารหล่อเย็นพิเศษเพื่อป้องกันการกัดกร่อนและการเติบโตของสิ่งมีชีวิต ค่าการนำไฟฟ้าต่ำกว่า 0.5 μS/cm ผ่านการกรองอย่างต่อเนื่อง สารฆ่าเชื้อป้องกันการก่อตัวของสาหร่าย สารยับยั้งการกัดกร่อนปกป้องโลหะต่างชนิด การบัฟเฟอร์ pH รักษาช่วง 7.0-8.5 เพื่อความเข้ากันได้ของวัสดุ

การผสานระดับ Rack: Rear-door heat exchanger จับความร้อนที่ระบายด้วยอากาศที่เหลือจากหน่วยความจำ storage และ power supply วิธีการแบบไฮบริดนี้จับความร้อนได้ 100% ที่ rack ขจัดความจำเป็นในการระบายความร้อนระดับห้อง Rack manifold กระจายสารหล่อเย็นไปยังเซิร์ฟเวอร์แต่ละตัวผ่านท่ออ่อนที่รองรับแรงดันใช้งาน 700 kPa

ระบบน้ำของสถานที่: ระบบน้ำเย็นที่มีอยู่ปรับตัวให้เข้ากับอุณหภูมิน้ำกลับที่สูงขึ้น ปรับปรุงประสิทธิภาพ chiller 20-30%⁸ ชั่วโมง free cooling เพิ่มขึ้นอย่างมากเมื่ออุณหภูมิจ่ายเพิ่มจาก 7°C เป็น 20°C Cooling tower ที่ออกแบบสำหรับน้ำกลับ 35°C ทำให้สามารถ free cooling ได้ตลอดปีในหลายภูมิอากาศ

การติดตั้งจริงพิสูจน์เทคโนโลยี

Azure HBv4 instance ของ Microsoft ใช้ระบบระบายความร้อนแบบ direct-to-chip สำหรับโปรเซสเซอร์ AMD EPYC ทำ PUE 1.11 ในการติดตั้งจริง⁹ สถานที่ใน Quincy รัฐ Washington ประมวลผลพลังงานคำนวณ 33MW โดยใช้พลังงานระบายความร้อนเพียง 3.6MW ประหยัดรายปีเกิน 4.8 ล้านดอลลาร์เมื่อเทียบกับทางเลือกที่ระบายความร้อนด้วยอากาศ ความน่าเชื่อถือของเซิร์ฟเวอร์ปรับปรุงขึ้น 23% เนื่องจากอุณหภูมิการทำงานที่สม่ำเสมอ

ซูเปอร์คอมพิวเตอร์ El Capitan ของ Lawrence Livermore National Laboratory ใช้ระบบระบายความร้อนแบบ direct-to-chip สำหรับ AMD MI300A APU จำนวน 40,000 ตัว¹⁰ ระบบทำได้ 2 exaflops พร้อมรักษา PUE 1.08 การระบายความร้อนด้วยน้ำอุ่นที่อุณหภูมิขาเข้า 35°C ทำให้สามารถ free cooling ได้ตลอดปีในภูมิอากาศของ California การออกแบบนี้ประหยัดค่าไฟฟ้า 12 ล้านดอลลาร์ต่อปี

วิศวกรของ Introl ได้ติดตั้งระบบระบายความร้อนแบบ direct-to-chip ใน 15 สถานที่ในพื้นที่ให้บริการทั่วโลกของเรา ลด PUE เฉลี่ยจาก 1.55 เหลือ 1.18¹¹ การติดตั้งล่าสุดสำหรับการดำเนินงานขุด cryptocurrency ทำ PUE 1.09 โดยใช้น้ำขาเข้า 40°C ขจัดการระบายความร้อนด้วยเครื่องจักรทั้งหมด ลูกค้าประหยัดได้ 2.3 ล้านดอลลาร์ต่อปีพร้อมเพิ่มความหนาแน่น hashrate 60%

การเลือกส่วนประกอบกำหนดความสำเร็จ

เทคโนโลยี Cold Plate: การออกแบบ Microchannel จาก CoolIT Systems ทำความต้านทานความร้อน 0.015°C/W Jet impingement plate จาก Motivair ให้ 0.012°C/W สำหรับ heat flux สูงมาก Vapor chamber enhanced plate จาก Aavid ให้การกระจายอุณหภูมิสม่ำเสมอสำหรับ die ขนาดใหญ่ ตัวเลือกวัสดุรวมถึงทองแดงสำหรับการนำความร้อนสูงสุด อะลูมิเนียมสำหรับการเพิ่มประสิทธิภาพต้นทุน และการชุบนิกเกิลสำหรับความต้านทานการกัดกร่อน

Coolant Distribution Unit: Motivair ChilledDoor CDU รองรับ 750kW พร้อมปั๊มสำรอง N+1 CoolIT Coolant Distribution Module รองรับ 300kW ในฟอร์มแฟคเตอร์ 8U Vertiv XDU unit ให้ความจุ 450kW พร้อมระบบตรวจจับการรั่วแบบบูรณาการ การเลือกขึ้นอยู่กับผังสถานที่ ข้อกำหนดความซ้ำซ้อน และโครงสร้างพื้นฐานที่มีอยู่

ระบบตรวจสอบ: การตรวจสอบอย่างต่อเนื่องป้องกันความล้มเหลวร้ายแรง เซ็นเซอร์การไหลตรวจจับการอุดตันก่อนเกิดความร้อนสูงเกิน เซ็นเซอร์ความดันระบุการรั่วไหลภายในไม่กี่วินาที อาร์เรย์อุณหภูมิแผนที่ประสิทธิภาพความร้อนทั่วส่วนประกอบ มิเตอร์ค่าการนำไฟฟ้าเตือนการปนเปื้อนของสารหล่อเย็น การผสานกับแพลตฟอร์ม DCIM ช่วยให้สามารถบำรุงรักษาเชิงคาดการณ์ได้

เคมีสารหล่อเย็น: สารหล่อเย็นสำหรับ data center ของ Nalco Water ป้องกันการกัดกร่อนในขณะที่รักษาค่าการนำไฟฟ้าต่ำ ของเหลวพิเศษ SYLTHERM ของ Dow ทำงานได้ตั้งแต่ -50°C ถึง 260°C สำหรับการใช้งานสุดขั้ว สารหล่อเย็นชีวภาพของ Cargill ให้ความยั่งยืนต่อสิ่งแวดล้อม การทดสอบสม่ำเสมอรักษาคุณสมบัติที่เหมาะสมและยืดอายุอุปกรณ์

การวิเคราะห์เศรษฐกิจขับเคลื่อนการตัดสินใจนำไปใช้

การลงทุนเงินทุนสำหรับระบบระบายความร้อนแบบ direct-to-chip อยู่ในช่วง $1,500 ถึง $3,000 ต่อ kW ของโหลด IT:¹²

ต้นทุนโครงสร้างพื้นฐาน: - CDU unit: $150,000 ต่อความจุ 300kW - ท่อและ manifold: $200 ต่อเซิร์ฟเวอร์ - Cold plate: $400-800 ต่อ GPU - ค่าแรงติดตั้ง: $300 ต่อเซิร์ฟเวอร์ - สารหล่อเย็นและการบำบัด: $50 ต่อเซิร์ฟเวอร์ - ระบบตรวจสอบ: $100 ต่อเซิร์ฟเวอร์ - รวมต่อ rack 42U (20 เซิร์ฟเวอร์): $45,000-65,000

การประหยัดจากการดำเนินงาน: - ลดพลังงาน: $12,000 ต่อ rack ต่อปีที่ $0.10/kWh - เพิ่มความหนาแน่น: การประมวลผลมากขึ้น 40% ต่อตารางฟุต - ลดการระบายความร้อนด้วยเครื่องจักร: $8,000 ต่อ rack ต่อปี - ลดพลังงานพัดลม: $3,000 ต่อ rack ต่อปี - ยืดอายุส่วนประกอบ: MTBF นานขึ้น 20% - ระยะเวลาคืนทุน: 18-24 เดือน

ต้นทุนรวมในการเป็นเจ้าของ: การวิเคราะห์ TCO ห้าปีแสดงต้นทุนต่ำกว่า 35% เทียบกับการระบายความร้อนด้วยอากาศสำหรับการติดตั้ง GPU ความหนาแน่นสูง สถานที่ GPU 1,000 ตัวประหยัดได้ 8.5 ล้านดอลลาร์ในห้าปีผ่านการลดการใช้พลังงานและเพิ่มความหนาแน่น เครดิตคาร์บอนและสิ่งจูงใจด้านความยั่งยืนให้ประโยชน์ทางการเงินเพิ่มเติม

กลยุทธ์การปรับปรุงสถานที่ที่มีอยู่

การแปลงโครงสร้างพื้นฐานที่ระบายความร้อนด้วยอากาศต้องมีการวางแผนอย่างรอบคอบ:

เฟส 1 - การประเมิน (30 วัน): ประเมินความจุการระบายความร้อนที่มีอยู่ การกระจายพลังงาน และการรองรับโครงสร้าง ระบุตำแหน่ง CDU ที่เหมาะสมที่มีการเข้าถึงน้ำของสถานที่ วางแผนเส้นทางท่อหลีกเลี่ยงความขัดแย้งกับโครงสร้างพื้นฐานที่มีอยู่ คำนวณการลดลงของความดันและข้อกำหนดของปั๊ม พัฒนาตารางการย้ายที่ลดการหยุดชะงัก

เฟส 2 - โครงสร้างพื้นฐาน (60 วัน): ติดตั้ง CDU และท่อหลักในช่วงหน้าต่างการบำรุงรักษาตามกำหนด อัปเกรดระบบน้ำของสถานที่สำหรับอุณหภูมิน้ำกลับที่สูงขึ้น เพิ่มจุดตรวจสอบทั่วเครือข่ายการกระจาย ทดสอบระบบโดยใช้โหลดจำลองก่อนการติดตั้งจริง ฝึกอบรมเจ้าหน้าที่ปฏิบัติการเกี่ยวกับขั้นตอนใหม่

เฟส 3 - การย้าย (90 วัน): แปลง rack ทีละแถวเพื่อรักษาการดำเนินงาน เริ่มด้วยสภาพแวดล้อมพัฒนา/ทดสอบเพื่อตรวจสอบขั้นตอน ย้าย workload การผลิตในช่วงหน้าต่างการบำรุงรักษา ตรวจสอบอุณหภูมิและปรับอัตราการไหลเพื่อการเพิ่มประสิทธิภาพ บันทึกบทเรียนที่ได้รับสำหรับเฟสถัดไป

เฟส 4 - การเพิ่มประสิทธิภาพ (ต่อเนื่อง): ค่อยๆ เพิ่มอุณหภูมิสารหล่อเย็นเพื่อเพิ่ม free cooling ปรับอัตราการไหลตามโหลดจริงเทียบกับการออกแบบ นำการบำรุงรักษาเชิงคาดการณ์มาใช้โดยใช้ข้อมูลเซ็นเซอร์ ปรับแต่งอัลกอริทึมการควบคุมเพื่อประสิทธิภาพพลังงาน ขยายการติดตั้งตามผลลัพธ์ที่พิสูจน์แล้ว

การพัฒนาในอนาคตผลักดันขีดจำกัด

การระบายความร้อนแบบ two-phase immersion สัญญาว่าจะให้ PUE เข้าใกล้ 1.02 โดยการขจัดปั๊มทั้งหมด¹³ ของเหลว dielectric เดือดที่พื้นผิวชิปและควบแน่นบนพื้นผิวที่เย็นกว่าเพื่อการหมุนเวียนแบบ passive การติดตั้งในระยะแรกแสดงการลดพลังงาน 95% เทียบกับการระบายความร้อนด้วยอากาศ ความท้าทายรวมถึงต้นทุนของเหลว ($200/ลิตร) และข้อกังวลด้านความเข้ากันได้ของวัสดุ

การบูรณาการระบบระบายความร้อนบนชิปฝัง microchannel โดยตรงใน silicon substrate¹⁴ IBM Research สาธิตการกำจัดความร้อน 1,700W/cm² โดยใช้ระบบระบายความร้อนแบบฝัง การนำไปใช้ในการผลิตรอเทคนิคการผลิตที่คุ้มค่า เทคโนโลยีนี้อาจทำให้สามารถซ้อนชิป 3D ด้วยความหนาแน่นการประมวลผลที่ไม่เคยมีมาก่อน

การกู้คืนความร้อนเหลือทิ้งเปลี่ยนระบบระบายความร้อนจากศูนย์ต้นทุนเป็นตัวสร้างรายได้ data center ของ Stockholm จัดหาความร้อน 10% ของเมืองผ่านการบูรณาการ district heating¹⁵ การระบายความร้อนแบบ direct-to-chip อุณหภูมิสูงช่วยให้การกู้คืนความร้อนทำได้โดยไม่ต้องใช้ heat pump องค์กรบรรลุต้นทุนการระบายความร้อนสุทธิติดลบผ่านการขายความร้อนเหลือทิ้ง

องค์กรที่ติดตั้งระบบระบายความร้อนแบบ direct-to-chip ได้รับข้อได้เปรียบทางการแข่งขันอย่างมากผ่านประสิทธิภาพที่ปรับปรุง ความหนาแน่นที่เพิ่มขึ้น และต้นทุนการดำเนินงานที่ต่ำลง เทคโนโลยีนี้พิสูจน์แล้วว่าจำเป็นสำหรับการติดตั้ง GPU รุ่นถัดไปที่เกิน 700W ต่อชิป ผู้นำร่องสร้างโครงสร้างพื้นฐานที่ยั่งยืนพร้อมสำหรับการเพิ่มความหนาแน่นพลังงานอย่างต่อเนื่อง ในขณะที่ผู้ตามหลังเผชิญกับการปรับปรุงที่มีราคาแพงหรือเสียเปรียบทางการแข่งขัน การเปลี่ยนจากระบบระบายความร้อนด้วยอากาศเป็นของเหลวแสดงถึงการเปลี่ยนแปลงพื้นฐานในการออกแบบ data center ที่องค์กรที่มองการณ์ไกลต้องยอมรับเพื่อให้คงความสามารถในการแข่งขันในยุค AI

ประเด็นสำคัญ

สำหรับสถาปนิกโครงสร้างพื้นฐาน: - Direct-to-chip ขจัด 5 ใน 7 thermal interface—15,000 W/m²K เทียบกับ 50 W/m²K สำหรับอากาศ - PUE ลดจาก 1.58 เหลือ 1.05-1.15—ลดค่าใช้จ่ายพลังงานระบายความร้อน 94% - GPU 700W ทำงาน

[เนื้อหาถูกตัดทอนสำหรับการแปล]