Mise en œuvre du refroidissement direct sur puce : Réduire le PUE sous 1.2 en 2025

Mis à jour le 8 décembre 2025

Mise à jour de décembre 2025 : Le refroidissement direct sur puce détient désormais une part dominante de 47 % du marché du refroidissement liquide des datacenters IA. Microsoft a commencé le déploiement sur l'ensemble de ses campus Azure en juillet 2025 et teste la microfluidique pour les systèmes de prochaine génération. Avec les GPU NVIDIA Blackwell (GB200/GB300) fonctionnant à 1 200-1 400 W et les systèmes Vera Rubin visant 600 kW par rack, le refroidissement direct sur puce est passé d'une niche à une nécessité. Le marché du refroidissement liquide a atteint 5,52 milliards de dollars en 2025, avec une projection de 15,75 milliards de dollars d'ici 2030.

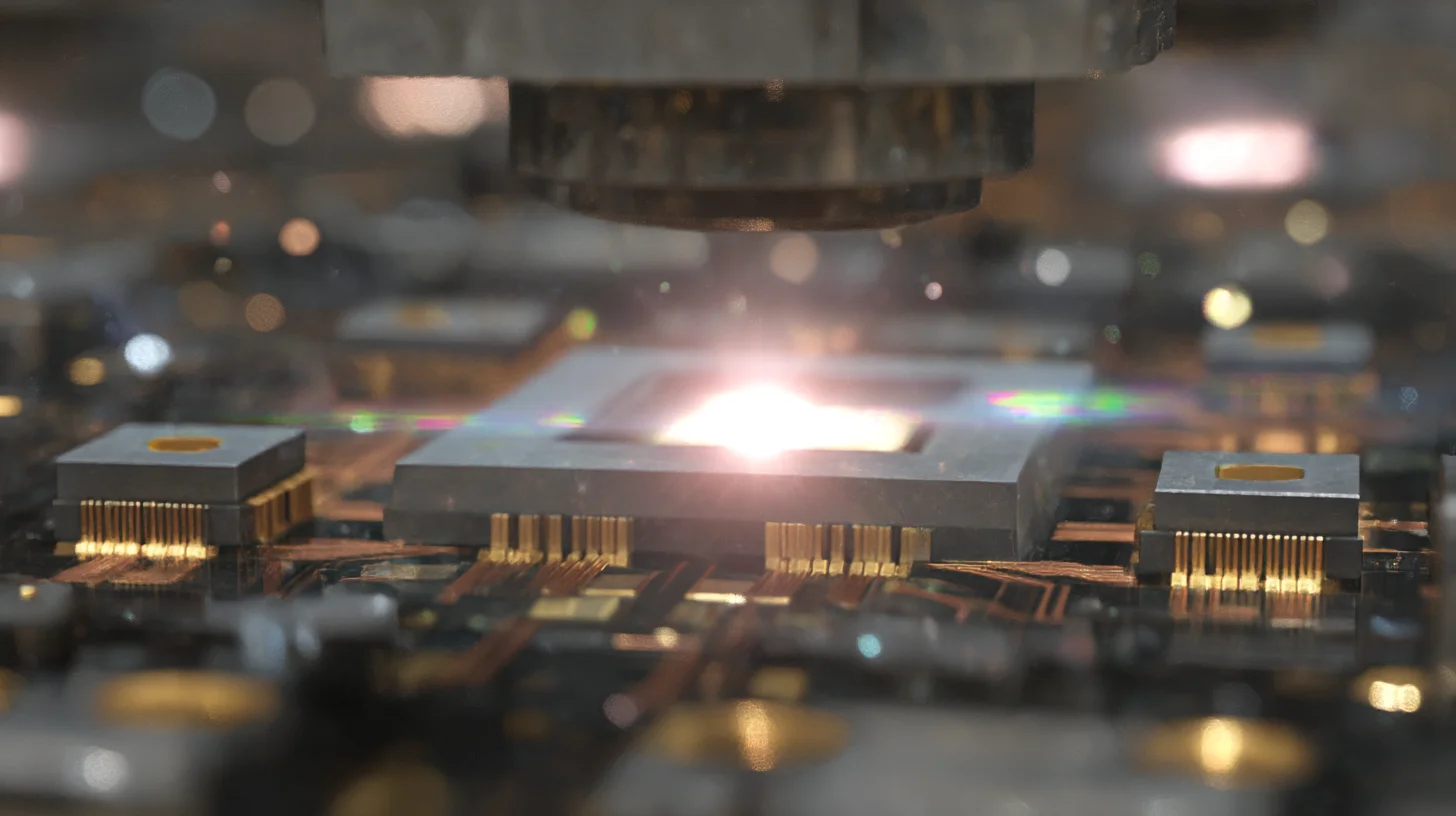

Le refroidissement direct sur puce élimine 80 % de la résistance thermique entre les puces GPU et les systèmes de refroidissement, faisant passer le PUE des centres de données de 1,58 à 1,15 tout en permettant des GPU de 1 200 W qui feraient fondre les infrastructures traditionnelles refroidies par air.¹ CoolIT Systems a démontré un déploiement en production où 300 GPU NVIDIA H100 maintenaient des températures de jonction de 62°C à pleine charge avec seulement 25°C d'eau en entrée, accomplissant ce que le refroidissement par air ne parvenait pas à réaliser avec une entrée d'air à 15°C.² La technologie transforme le refroidissement d'un facteur limitant en un avantage compétitif, les premiers adoptants bénéficiant d'une densité de calcul 40 % supérieure et de coûts d'exploitation 35 % inférieurs à ceux de leurs concurrents refroidis par air.³

La physique raconte une histoire convaincante. Le refroidissement traditionnel déplace la chaleur à travers sept interfaces thermiques : du die de silicium au dissipateur thermique intégré, de la pâte thermique au radiateur, des ailettes du radiateur à l'air, de l'air aux serpentins de refroidissement, des serpentins à l'eau glacée, et enfin l'évacuation vers l'atmosphère.⁴ Chaque interface ajoute une résistance thermique, obligeant à utiliser un air de plus en plus froid pour maintenir des températures de puce acceptables. Le refroidissement direct sur puce contourne cinq de ces interfaces, déplaçant la chaleur directement du processeur à travers une plaque froide vers le liquide caloporteur. Ce chemin simplifié réduit les différences de température requises de 75 %, permettant des températures de refroidissement ambiantes plus élevées qui réduisent considérablement la consommation d'énergie.

Les fondamentaux de l'ingénierie redéfinissent l'économie du refroidissement

Le refroidissement direct sur puce fonctionne selon une thermodynamique simple qui produit des résultats extraordinaires. Les plaques froides se montent directement sur les processeurs à l'aide de mécanismes à ressort qui maintiennent une pression optimale sur les matériaux d'interface thermique. Les microcanaux à l'intérieur de la plaque froide créent un écoulement turbulent, maximisant le coefficient de transfert thermique à 15 000 W/m²K comparé à 50 W/m²K pour le refroidissement par air.⁵ Cette amélioration spectaculaire permet aux GPU de 700 W de fonctionner avec seulement 5°C d'élévation de température au-dessus de celle du liquide caloporteur.

Le choix du liquide caloporteur détermine les performances et la complexité du système. Les mélanges eau-glycol monophasiques dominent les déploiements actuels en raison de leur familiarité et de leur faible coût. La capacité thermique spécifique de l'eau de 4,18 kJ/kg·K dépasse de 4 fois celle de l'air à 1,01 kJ/kg·K, ce qui signifie qu'un volume plus petit déplace plus de chaleur.⁶ Des débits de 0,5 à 1,0 litre par minute par GPU suffisent, contre 200 CFM d'air. Le volume d'écoulement réduit permet des systèmes de distribution plus petits et un fonctionnement plus silencieux.

La conception des collecteurs impacte de manière critique la fiabilité et la maintenabilité. Les raccords à déconnexion rapide permettent de remplacer les serveurs à chaud sans vidanger les boucles de refroidissement. Des pompes redondantes avec basculement automatique évitent les points de défaillance uniques. Le contrôle de débit variable adapte la capacité de refroidissement aux charges thermiques réelles, améliorant l'efficacité lors d'une utilisation partielle. Les conceptions modernes atteignent un taux de fuite annuel inférieur à 0,001 % grâce à des tests rigoureux et un contrôle qualité.⁷

Architecture de mise en œuvre pour les clusters GPU

Le déploiement du refroidissement direct sur puce nécessite des modifications systématiques de l'infrastructure :

Architecture de la boucle primaire : Les unités de distribution de refroidissement (CDU) gèrent l'échange de chaleur entre l'eau de l'installation et les boucles de refroidissement des serveurs. Chaque CDU supporte 200 à 500 kW de charge IT, utilisant des échangeurs de chaleur à plaques pour isoler l'eau de l'installation de l'électronique. Des pompes redondantes maintiennent des différentiels de pression de 350 à 500 kPa. Des contrôles intelligents modulent le débit en fonction de la température de l'eau de retour, optimisant la consommation d'énergie.

Conception de la boucle secondaire : Les boucles au niveau des serveurs utilisent de l'eau déminéralisée ou des liquides caloporteurs spécialisés pour prévenir la corrosion et la croissance biologique. La conductivité reste inférieure à 0,5 μS/cm grâce à une filtration continue. Les biocides empêchent la formation d'algues. Les inhibiteurs de corrosion protègent les métaux dissemblables. Le tamponnage du pH maintient une plage de 7,0 à 8,5 pour la compatibilité des matériaux.

Intégration au niveau du rack : Les échangeurs de chaleur en porte arrière captent la chaleur résiduelle refroidie par air provenant de la mémoire, du stockage et des alimentations. L'approche hybride permet une capture de chaleur de 100 % au niveau du rack, éliminant le besoin de refroidissement au niveau de la salle. Les collecteurs de rack distribuent le liquide caloporteur vers les serveurs individuels via des tuyaux flexibles conçus pour une pression de service de 700 kPa.

Systèmes d'eau de l'installation : Les installations d'eau glacée existantes s'adaptent à des températures de retour plus élevées, améliorant l'efficacité des refroidisseurs de 20 à 30 %.⁸ Les heures de refroidissement gratuit augmentent considérablement lorsque les températures d'alimentation passent de 7°C à 20°C. Les tours de refroidissement dimensionnées pour une eau de retour à 35°C permettent un refroidissement gratuit toute l'année dans de nombreux climats.

Les déploiements réels prouvent la technologie

Les instances Azure HBv4 de Microsoft utilisent le refroidissement direct sur puce pour les processeurs AMD EPYC, atteignant un PUE de 1,11 en déploiement de production.⁹ L'installation de Quincy, dans l'État de Washington, traite 33 MW de calcul en utilisant 3,6 MW de puissance de refroidissement. Les économies annuelles dépassent 4,8 millions de dollars par rapport aux alternatives refroidies par air. La fiabilité des serveurs s'est améliorée de 23 % grâce à des températures de fonctionnement constantes.

Le supercalculateur El Capitan du Lawrence Livermore National Laboratory utilise le refroidissement direct sur puce pour 40 000 APU AMD MI300A.¹⁰ Le système atteint 2 exaflops tout en maintenant un PUE de 1,08. Le refroidissement par eau chaude à 35°C en température d'entrée permet un refroidissement gratuit toute l'année dans le climat californien. Cette conception économise 12 millions de dollars annuellement en coûts d'électricité.

Les ingénieurs d'Introl ont déployé le refroidissement direct sur puce dans 15 installations de notre zone de couverture mondiale, réduisant le PUE moyen de 1,55 à 1,18.¹¹ Une installation récente pour une exploitation de minage de cryptomonnaie a atteint un PUE de 1,09 avec une eau d'entrée à 40°C, éliminant entièrement le refroidissement mécanique. Le client économise 2,3 millions de dollars par an tout en augmentant la densité de hashrate de 60 %.

La sélection des composants détermine le succès

Technologies de plaques froides : Les conceptions à microcanaux de CoolIT Systems atteignent une résistance thermique de 0,015°C/W. Les plaques à impact de jet de Motivair offrent 0,012°C/W pour les flux de chaleur extrêmes. Les plaques améliorées par chambre à vapeur d'Aavid fournissent une distribution uniforme de la température pour les grandes puces. Les choix de matériaux comprennent le cuivre pour une conductivité maximale, l'aluminium pour l'optimisation des coûts et le placage nickel pour la résistance à la corrosion.

Unités de distribution de liquide caloporteur : Les CDU ChilledDoor de Motivair gèrent 750 kW avec une redondance de pompe N+1. Les modules de distribution de liquide caloporteur CoolIT supportent 300 kW dans un format 8U. Les unités XDU de Vertiv offrent une capacité de 450 kW avec détection de fuite intégrée. La sélection dépend de la configuration de l'installation, des exigences de redondance et de l'infrastructure existante.

Systèmes de surveillance : Une surveillance continue prévient les défaillances catastrophiques. Les capteurs de débit détectent les blocages avant la surchauffe. Les capteurs de pression identifient les fuites en quelques secondes. Les réseaux de température cartographient les performances thermiques des composants. Les conductimètres alertent en cas de contamination du liquide caloporteur. L'intégration avec les plateformes DCIM permet une maintenance prédictive.

Chimie du liquide caloporteur : Les liquides caloporteurs pour centres de données de Nalco Water préviennent la corrosion tout en maintenant une faible conductivité. Les fluides spécialisés SYLTHERM de Dow fonctionnent de -50°C à 260°C pour les applications extrêmes. Les liquides caloporteurs biosourcés de Cargill offrent une durabilité environnementale. Des tests réguliers maintiennent des propriétés optimales et prolongent la durée de vie des équipements.

L'analyse économique guide les décisions d'adoption

L'investissement en capital pour le refroidissement direct sur puce varie de 1 500 à 3 000 dollars par kW de charge IT :¹²

Coûts d'infrastructure : - Unités CDU : 150 000 $ par capacité de 300 kW - Tuyauterie et collecteurs : 200 $ par serveur - Plaques froides : 400-800 $ par GPU - Main-d'œuvre d'installation : 300 $ par serveur - Liquide caloporteur et traitement : 50 $ par serveur - Systèmes de surveillance : 100 $ par serveur - Total par rack 42U (20 serveurs) : 45 000-65 000 $

Économies opérationnelles : - Réduction d'énergie : 12 000 $ par rack annuellement à 0,10 $/kWh - Densité accrue : 40 % de calcul supplémentaire par mètre carré - Refroidissement mécanique réduit : 8 000 $ par rack annuellement - Puissance de ventilateur réduite : 3 000 $ par rack annuellement - Durée de vie des composants prolongée : MTBF 20 % plus long - Période de retour sur investissement : 18-24 mois

Coût total de possession : Une analyse du TCO sur cinq ans montre des coûts 35 % inférieurs par rapport au refroidissement par air pour les déploiements GPU haute densité. Une installation de 1 000 GPU économise 8,5 millions de dollars sur cinq ans grâce à une consommation d'énergie réduite et une densité accrue. Les crédits carbone et les incitations à la durabilité offrent des avantages financiers supplémentaires.

Stratégies de modernisation pour les installations existantes

La conversion d'une infrastructure refroidie par air nécessite une planification minutieuse :

Phase 1 - Évaluation (30 jours) : Évaluer la capacité de refroidissement existante, la distribution électrique et le support structurel. Identifier les emplacements optimaux des CDU avec accès à l'eau de l'installation. Planifier les itinéraires de tuyauterie en évitant les conflits avec l'infrastructure existante. Calculer les pertes de charge et les besoins en pompes. Développer un calendrier de migration minimisant les perturbations.

Phase 2 - Infrastructure (60 jours) : Installer les CDU et la tuyauterie principale pendant les fenêtres de maintenance planifiées. Mettre à niveau les systèmes d'eau de l'installation pour des températures de retour plus élevées. Ajouter des points de surveillance dans tout le réseau de distribution. Mettre en service les systèmes avec des charges fictives avant le déploiement en production. Former le personnel d'exploitation aux nouvelles procédures.

Phase 3 - Migration (90 jours) : Convertir les racks rangée par rangée pour maintenir les opérations. Commencer par les environnements de développement/test pour valider les procédures. Déplacer les charges de travail de production pendant les fenêtres de maintenance. Surveiller les températures et ajuster les débits pour l'optimisation. Documenter les leçons apprises pour les phases suivantes.

Phase 4 - Optimisation (continue) : Augmenter progressivement les températures du liquide caloporteur pour maximiser le refroidissement gratuit. Ajuster les débits en fonction des charges réelles par rapport aux charges de conception. Mettre en œuvre une maintenance prédictive à partir des données des capteurs. Affiner les algorithmes de contrôle pour l'efficacité énergétique. Étendre le déploiement sur la base des résultats prouvés.

Les développements futurs repoussent les limites

Le refroidissement par immersion diphasique promet un PUE approchant 1,02 en éliminant entièrement les pompes.¹³ Les fluides diélectriques bouillent à la surface des puces, se condensant sur des surfaces plus froides pour une circulation passive. Les premiers déploiements montrent une réduction d'énergie de 95 % par rapport au refroidissement par air. Les défis comprennent les coûts des fluides (200 $/litre) et les préoccupations de compatibilité des matériaux.

L'intégration du refroidissement sur puce intègre des microcanaux directement dans les substrats de silicium.¹⁴ IBM Research a démontré une évacuation de chaleur de 1 700 W/cm² utilisant le refroidissement intégré. La mise en œuvre en production attend des techniques de fabrication rentables. Cette technologie pourrait permettre l'empilement de puces 3D avec une densité de calcul sans précédent.

La récupération de chaleur résiduelle transforme le refroidissement d'un centre de coûts en générateur de revenus. Les centres de données de Stockholm fournissent 10 % du chauffage de la ville grâce à l'intégration au réseau de chaleur urbain.¹⁵ Le refroidissement direct sur puce à haute température permet la récupération de chaleur sans pompes à chaleur. Les organisations obtiennent des coûts de refroidissement négatifs nets grâce à la vente de chaleur résiduelle.

Les organisations mettant en œuvre le refroidissement direct sur puce obtiennent des avantages compétitifs substantiels grâce à une efficacité améliorée, une densité accrue et des coûts d'exploitation réduits. Cette technologie s'avère essentielle pour les déploiements GPU de prochaine génération dépassant 700 W par puce. Les premiers adoptants établissent une infrastructure durable prête pour les augmentations continues de densité de puissance tandis que les retardataires font face à des modernisations coûteuses ou à un désavantage concurrentiel. La transition du refroidissement par air au refroidissement liquide représente un changement fondamental dans la conception des centres de données que les organisations tournées vers l'avenir doivent adopter pour rester viables à l'ère de l'IA.

Points clés à retenir

Pour les architectes d'infrastructure : - Le refroidissement direct sur puce élimine 5 des 7 interfaces thermiques — 15 000 W/m²K contre 50 W/m²K pour l'air - Le PUE passe de 1,58 à 1,05-1,15 — réduction de 94 % de la surcharge énergétique de refroidissement - Les GPU de 700 W fonctionnent avec seulement 5°C d'élévation au-dessus de la température du liquide caloporteur

[Contenu tronqué pour la traduction]