직접 칩 냉각 구현: 2025년 PUE 1.2 이하 달성하기

2025년 12월 8일 업데이트

2025년 12월 업데이트: 직접 칩 냉각은 현재 AI 데이터센터 액체 냉각 시장에서 47%의 압도적인 점유율을 차지하고 있습니다. Microsoft는 2025년 7월부터 Azure 캠퍼스 전역에 대규모 배포를 시작했으며, 차세대 시스템용 마이크로유체공학 기술을 테스트 중입니다. NVIDIA Blackwell GPU(GB200/GB300)가 1,200-1,400W로 작동하고 Vera Rubin 시스템이 랙당 600kW를 목표로 하면서, 직접 칩 냉각은 틈새 기술에서 필수 기술로 전환되었습니다. 액체 냉각 시장은 2025년 55억 2천만 달러에 도달했으며, 2030년까지 157억 5천만 달러에 이를 것으로 예상됩니다.

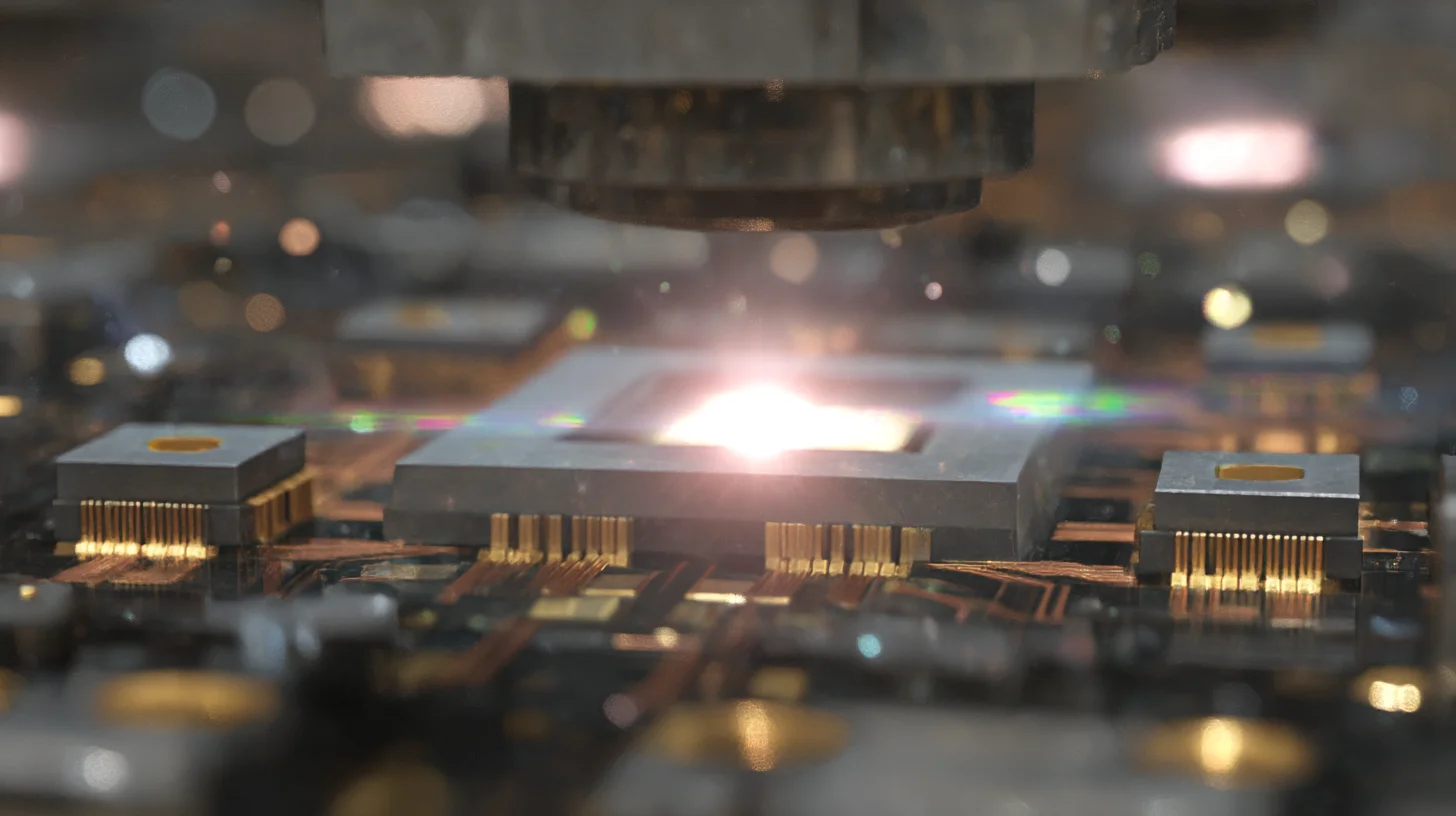

직접 칩 냉각은 GPU 다이와 냉각 시스템 사이의 열저항을 80% 제거하여 데이터센터 PUE를 1.58에서 1.15로 낮추고, 기존 공랭 인프라에서는 녹아버릴 1,200W GPU를 가능하게 합니다.¹ CoolIT Systems는 25°C 유입수만으로 300개의 NVIDIA H100 GPU가 전부하에서 62°C 접합 온도를 유지하는 생산 배포를 시연했으며, 이는 15°C 유입 공기로도 달성하지 못한 결과입니다.² 이 기술은 냉각을 제한 요소에서 경쟁 우위로 전환시켜, 선도 도입 기업들이 공랭 경쟁사 대비 40% 높은 컴퓨팅 밀도와 35% 낮은 운영 비용을 확보하고 있습니다.³

물리학이 설득력 있는 이야기를 들려줍니다. 기존 냉각은 7개의 열 인터페이스를 통해 열을 이동시킵니다: 실리콘 다이에서 통합 히트 스프레더, 열전도 페이스트에서 히트싱크, 히트싱크 핀에서 공기, 공기에서 냉각 코일, 코일에서 냉각수, 그리고 최종적으로 대기로 방출. 각 인터페이스는 열저항을 추가하여 허용 가능한 칩 온도를 유지하기 위해 점점 더 차가운 공기가 필요합니다.⁴ 직접 칩 냉각은 이 인터페이스 중 5개를 우회하여 프로세서에서 콜드 플레이트를 통해 액체 냉각제로 열을 직접 이동시킵니다. 단순화된 경로는 필요한 온도 차이를 75% 줄여 더 높은 주변 냉각 온도를 가능하게 하고 에너지 소비를 크게 절감합니다.

엔지니어링 기본 원리가 냉각 경제학을 재편하다

직접 칩 냉각은 탁월한 결과를 제공하는 간단한 열역학에 기반합니다. 콜드 플레이트는 열 인터페이스 재료 전체에 최적의 압력을 유지하는 스프링 장착 메커니즘을 사용하여 프로세서에 직접 장착됩니다. 콜드 플레이트 내의 마이크로채널은 난류 흐름을 생성하여 열전달 계수를 공랭의 50 W/m²K에 비해 15,000 W/m²K까지 극대화합니다.⁵ 이러한 극적인 개선으로 700W GPU가 냉각제 온도보다 단 5°C 높은 온도 상승만으로 작동할 수 있습니다.

냉각제 선택은 시스템 성능과 복잡성을 결정합니다. 단상 물-글리콜 혼합물이 친숙함과 저비용으로 인해 현재 배포의 대부분을 차지합니다. 물의 비열용량 4.18 kJ/kg·K는 공기의 1.01 kJ/kg·K보다 4배 높아 더 적은 부피로 더 많은 열을 이동시킵니다.⁶ GPU당 0.5-1.0리터/분의 유량이면 충분하며, 이는 200 CFM의 공기와 비교됩니다. 감소된 유량은 더 작은 분배 시스템과 더 조용한 운영을 가능하게 합니다.

매니폴드 설계는 신뢰성과 서비스 용이성에 중대한 영향을 미칩니다. 퀵 디스커넥트 피팅은 냉각 루프를 배수하지 않고 서버를 핫스왑할 수 있게 합니다. 자동 페일오버가 있는 이중화 펌프는 단일 장애점을 방지합니다. 가변 유량 제어는 냉각 용량을 실제 열부하에 맞춰 부분 활용 시 효율성을 향상시킵니다. 현대적 설계는 엄격한 테스트와 품질 관리를 통해 연간 0.001% 미만의 누수율을 달성합니다.⁷

GPU 클러스터를 위한 구현 아키텍처

직접 칩 냉각 배포에는 체계적인 인프라 변경이 필요합니다:

1차 루프 아키텍처: 냉각제 분배 장치(CDU)는 시설 용수와 서버 냉각 루프 간의 열교환을 관리합니다. 각 CDU는 200-500kW의 IT 부하를 지원하며, 플레이트 열교환기를 사용하여 시설 용수를 전자장치로부터 분리합니다. 이중화 펌프가 350-500 kPa 압력차를 유지합니다. 스마트 제어장치가 반환수 온도에 따라 유량을 조절하여 에너지 소비를 최적화합니다.

2차 루프 설계: 서버 레벨 루프는 부식과 생물학적 성장을 방지하기 위해 탈이온수 또는 특수 냉각제를 사용합니다. 전도도는 지속적인 여과를 통해 0.5 μS/cm 이하로 유지됩니다. 살균제가 조류 형성을 방지합니다. 부식 억제제가 이종 금속을 보호합니다. pH 완충액이 재료 호환성을 위해 7.0-8.5 범위를 유지합니다.

랙 레벨 통합: 후면 도어 열교환기가 메모리, 스토리지, 전원 공급 장치의 잔여 공랭 열을 포착합니다. 이 하이브리드 방식은 랙에서 100% 열 포착을 달성하여 룸 레벨 냉각의 필요성을 제거합니다. 랙 매니폴드는 700 kPa 작동 압력 등급의 유연한 호스를 통해 개별 서버에 냉각제를 분배합니다.

시설 용수 시스템: 기존 냉각수 플랜트가 더 높은 반환 온도에 적응하여 냉동기 효율을 20-30% 향상시킵니다.⁸ 공급 온도가 7°C에서 20°C로 상승하면 프리쿨링 시간이 크게 증가합니다. 35°C 반환수를 위해 설계된 냉각탑은 많은 기후에서 연중 프리쿨링을 가능하게 합니다.

실제 배포가 기술을 입증하다

Microsoft의 Azure HBv4 인스턴스는 AMD EPYC 프로세서용 직접 칩 냉각을 사용하여 생산 배포에서 PUE 1.11을 달성했습니다.⁹ 워싱턴주 퀸시 시설은 3.6MW의 냉각 전력을 사용하여 33MW의 컴퓨팅을 처리합니다. 연간 절감액은 공랭 대안 대비 480만 달러를 초과합니다. 일정한 운영 온도로 인해 서버 신뢰성이 23% 향상되었습니다.

Lawrence Livermore 국립연구소의 El Capitan 슈퍼컴퓨터는 40,000개의 AMD MI300A APU용 직접 칩 냉각을 사용합니다.¹⁰ 이 시스템은 PUE 1.08을 유지하면서 2 엑사플롭스를 달성합니다. 35°C 유입 온도의 온수 냉각은 캘리포니아 기후에서 연중 프리쿨링을 가능하게 합니다. 이 설계로 연간 1,200만 달러의 전기 비용을 절감합니다.

Introl 엔지니어들은 글로벌 서비스 지역 전역의 15개 시설에 직접 칩 냉각을 배포하여 평균 PUE를 1.55에서 1.18로 낮췄습니다.¹¹ 최근 암호화폐 채굴 운영을 위한 설치에서는 40°C 유입수를 사용하여 PUE 1.09를 달성하고 기계식 냉각을 완전히 제거했습니다. 고객은 해시레이트 밀도를 60% 높이면서 연간 230만 달러를 절감하고 있습니다.

구성 요소 선택이 성공을 결정한다

콜드 플레이트 기술: CoolIT Systems의 마이크로채널 설계는 0.015°C/W 열저항을 달성합니다. Motivair의 제트 충돌 플레이트는 극한 열유속을 위해 0.012°C/W를 제공합니다. Aavid의 베이퍼 챔버 강화 플레이트는 대형 다이에 균일한 온도 분포를 제공합니다. 재료 선택에는 최대 전도성을 위한 구리, 비용 최적화를 위한 알루미늄, 내식성을 위한 니켈 도금이 포함됩니다.

냉각제 분배 장치: Motivair ChilledDoor CDU는 N+1 펌프 이중화로 750kW를 처리합니다. CoolIT 냉각제 분배 모듈은 8U 폼팩터로 300kW를 지원합니다. Vertiv XDU 장치는 통합 누수 감지 기능과 함께 450kW 용량을 제공합니다. 선택은 시설 배치, 이중화 요구사항, 기존 인프라에 따라 달라집니다.

모니터링 시스템: 지속적인 모니터링이 치명적인 고장을 방지합니다. 유량 센서가 과열 전에 막힘을 감지합니다. 압력 센서가 몇 초 내에 누수를 식별합니다. 온도 어레이가 구성 요소 전체의 열 성능을 매핑합니다. 전도도 측정기가 냉각제 오염을 경고합니다. DCIM 플랫폼과의 통합으로 예측 유지보수가 가능합니다.

냉각제 화학: Nalco Water의 데이터센터 냉각제는 낮은 전도도를 유지하면서 부식을 방지합니다. Dow의 SYLTHERM 특수 유체는 극한 애플리케이션을 위해 -50°C에서 260°C까지 작동합니다. Cargill의 바이오 기반 냉각제는 환경 지속 가능성을 제공합니다. 정기 테스트로 최적의 특성을 유지하고 장비 수명을 연장합니다.

경제성 분석이 도입 결정을 이끌다

직접 칩 냉각을 위한 자본 투자는 IT 부하 kW당 1,500~3,000달러 범위입니다:¹²

인프라 비용: - CDU 장치: 300kW 용량당 150,000달러 - 배관 및 매니폴드: 서버당 200달러 - 콜드 플레이트: GPU당 400-800달러 - 설치 인건비: 서버당 300달러 - 냉각제 및 처리: 서버당 50달러 - 모니터링 시스템: 서버당 100달러 - 42U 랙당 총계(20서버): 45,000-65,000달러

운영 절감액: - 에너지 절감: $0.10/kWh 기준 랙당 연간 12,000달러 - 밀도 증가: 평방피트당 40% 더 많은 컴퓨팅 - 기계식 냉각 감소: 랙당 연간 8,000달러 - 팬 전력 감소: 랙당 연간 3,000달러 - 구성 요소 수명 연장: MTBF 20% 증가 - 투자 회수 기간: 18-24개월

총 소유 비용: 5년 TCO 분석에 따르면 고밀도 GPU 배포의 경우 공랭 대비 35% 낮은 비용을 보여줍니다. 1,000-GPU 시설은 에너지 소비 감소와 밀도 증가를 통해 5년간 850만 달러를 절감합니다. 탄소 크레딧과 지속 가능성 인센티브는 추가적인 재정적 이점을 제공합니다.

기존 시설 개조 전략

공랭 인프라 전환에는 신중한 계획이 필요합니다:

1단계 - 평가(30일): 기존 냉각 용량, 전력 분배, 구조적 지지를 평가합니다. 시설 용수 접근이 가능한 최적의 CDU 위치를 식별합니다. 기존 인프라와의 충돌을 피하는 배관 경로를 계획합니다. 압력 강하와 펌프 요구사항을 계산합니다. 중단을 최소화하는 마이그레이션 일정을 개발합니다.

2단계 - 인프라(60일): 예정된 유지보수 기간 동안 CDU와 1차 배관을 설치합니다. 더 높은 반환 온도를 위해 시설 용수 시스템을 업그레이드합니다. 분배 네트워크 전체에 모니터링 포인트를 추가합니다. 생산 배포 전에 더미 부하를 사용하여 시스템을 시운전합니다. 운영 직원에게 새로운 절차를 교육합니다.

3단계 - 마이그레이션(90일): 운영을 유지하면서 열 단위로 랙을 전환합니다. 절차 검증을 위해 개발/테스트 환경부터 시작합니다. 유지보수 기간 동안 생산 워크로드를 이동합니다. 온도를 모니터링하고 최적화를 위해 유량을 조정합니다. 후속 단계를 위한 교훈을 문서화합니다.

4단계 - 최적화(지속): 프리쿨링을 극대화하기 위해 냉각제 온도를 점진적으로 높입니다. 실제 부하 대 설계 부하를 기반으로 유량을 조정합니다. 센서 데이터를 사용하여 예측 유지보수를 구현합니다. 에너지 효율을 위해 제어 알고리즘을 미세 조정합니다. 입증된 결과를 바탕으로 배포를 확장합니다.

미래 개발이 한계를 넘어서다

2상 침지 냉각은 펌프를 완전히 제거하여 PUE 1.02에 접근할 것을 약속합니다.¹³ 유전체 유체가 칩 표면에서 끓어오르고 더 차가운 표면에서 응축되어 수동 순환을 형성합니다. 초기 배포에서 공랭 대비 95% 에너지 절감을 보여줍니다. 도전 과제에는 유체 비용(리터당 200달러)과 재료 호환성 우려가 포함됩니다.

온칩 냉각 통합은 마이크로채널을 실리콘 기판에 직접 내장합니다.¹⁴ IBM Research는 내장 냉각을 사용하여 1,700W/cm² 열 제거를 시연했습니다. 생산 구현은 비용 효율적인 제조 기술을 기다리고 있습니다. 이 기술은 전례 없는 컴퓨팅 밀도로 3D 칩 스태킹을 가능하게 할 수 있습니다.

폐열 회수는 냉각을 비용 센터에서 수익 창출원으로 전환합니다. 스톡홀름의 데이터센터는 지역 난방 통합을 통해 도시 난방의 10%를 제공합니다.¹⁵ 고온 직접 칩 냉각은 히트 펌프 없이 폐열 회수를 가능하게 합니다. 조직들은 폐열 판매를 통해 순 마이너스 냉각 비용을 달성합니다.

직접 칩 냉각을 구현하는 조직은 향상된 효율성, 증가된 밀도, 낮아진 운영 비용을 통해 상당한 경쟁 우위를 확보합니다. 이 기술은 칩당 700W를 초과하는 차세대 GPU 배포에 필수적입니다. 선도 도입자들은 지속적인 전력 밀도 증가에 대비한 지속 가능한 인프라를 구축하는 반면, 후발 주자들은 값비싼 개조나 경쟁 열위에 직면합니다. 공랭에서 액체 냉각으로의 전환은 미래 지향적인 조직이 AI 시대에 경쟁력을 유지하기 위해 반드시 수용해야 하는 데이터센터 설계의 근본적인 변화를 나타냅니다.

핵심 요점

인프라 설계자를 위해: - 직접 칩 냉각은 7개의 열 인터페이스 중 5개를 제거—공기의 50 W/m²K 대비 15,000 W/m²K - PUE가 1.58에서 1.05-1.15로 감소—냉각 에너지 오버헤드 94% 감소 - 700W GPU가

[번역을 위해 내용 일부 생략됨]