Implementação de Resfriamento Direto no Chip: Reduzindo o PUE Abaixo de 1,2 em 2025

Atualizado em 8 de dezembro de 2025

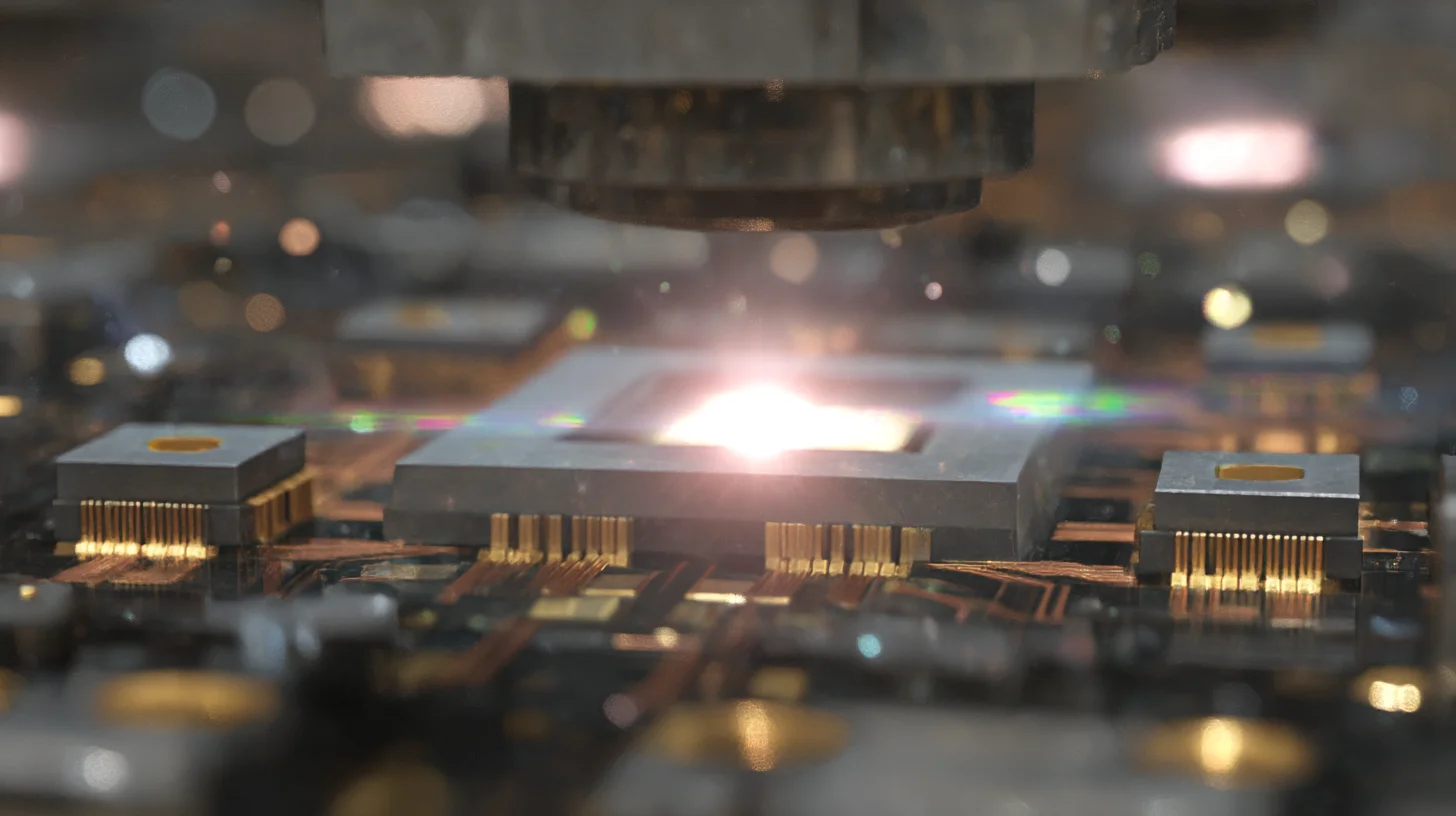

Atualização de Dezembro de 2025: O resfriamento direto no chip agora detém uma participação dominante de 47% no mercado de resfriamento líquido para datacenters de IA. A Microsoft iniciou a implantação em toda a frota nos campus do Azure em julho de 2025 e está testando microfluídica para sistemas de próxima geração. Com as GPUs NVIDIA Blackwell (GB200/GB300) operando entre 1.200-1.400W e os sistemas Vera Rubin visando 600kW por rack, o resfriamento direto no chip passou de nicho para necessidade. O mercado de resfriamento líquido alcançou US$ 5,52 bilhões em 2025, com projeção de atingir US$ 15,75 bilhões até 2030.

O resfriamento direto no chip elimina 80% da resistência térmica entre os dies das GPUs e os sistemas de resfriamento, reduzindo o PUE dos data centers de 1,58 para 1,15 enquanto permite GPUs de 1.200W que derreteriam a infraestrutura tradicional resfriada a ar.¹ A CoolIT Systems demonstrou uma implantação em produção onde 300 GPUs NVIDIA H100 mantiveram temperaturas de junção de 62°C em carga total usando apenas água de entrada a 25°C, alcançando o que o resfriamento a ar não conseguiu com ar de entrada a 15°C.² A tecnologia transforma o resfriamento de um fator limitante em uma vantagem competitiva, com os primeiros adotantes obtendo 40% mais densidade de computação e 35% menos custos operacionais do que concorrentes resfriados a ar.³

A física conta uma história convincente. O resfriamento tradicional move o calor através de sete interfaces térmicas: do die de silício para o dissipador de calor integrado, pasta térmica para o heatsink, aletas do heatsink para o ar, ar para as serpentinas de resfriamento, serpentinas para água gelada e, finalmente, rejeição para a atmosfera.⁴ Cada interface adiciona resistência térmica, forçando ar cada vez mais frio para manter temperaturas aceitáveis nos chips. O resfriamento direto no chip contorna cinco dessas interfaces, movendo o calor diretamente do processador através de uma placa fria para o líquido refrigerante. O caminho simplificado reduz os diferenciais de temperatura necessários em 75%, permitindo temperaturas de resfriamento ambiente mais altas que reduzem drasticamente o consumo de energia.

Fundamentos de engenharia reformulam a economia do resfriamento

O resfriamento direto no chip opera com base em termodinâmica direta que entrega resultados extraordinários. As placas frias são montadas diretamente nos processadores usando mecanismos com molas que mantêm pressão ideal através dos materiais de interface térmica. Microcanais dentro da placa fria criam fluxo turbulento, maximizando o coeficiente de transferência de calor para 15.000 W/m²K em comparação com 50 W/m²K para resfriamento a ar.⁵ A melhoria dramática permite que GPUs de 700W operem com apenas 5°C de aumento de temperatura acima da temperatura do refrigerante.

A seleção do refrigerante determina o desempenho e a complexidade do sistema. Misturas monofásicas de água-glicol dominam as implantações atuais devido à familiaridade e baixo custo. A capacidade térmica específica da água de 4,18 kJ/kg·K excede os 1,01 kJ/kg·K do ar em 4x, significando que menos volume move mais calor.⁶ Vazões de 0,5-1,0 litros por minuto por GPU são suficientes, comparado a 200 CFM de ar. O volume de fluxo reduzido permite sistemas de distribuição menores e operação mais silenciosa.

O design do manifold impacta criticamente a confiabilidade e a manutenibilidade. Conexões de desconexão rápida permitem a troca a quente de servidores sem drenar os circuitos de resfriamento. Bombas redundantes com failover automático previnem pontos únicos de falha. O controle de fluxo variável ajusta a capacidade de resfriamento às cargas térmicas reais, melhorando a eficiência durante utilização parcial. Projetos modernos alcançam menos de 0,001% de taxa anual de vazamento através de testes rigorosos e controle de qualidade.⁷

Arquitetura de implementação para clusters de GPU

A implantação do resfriamento direto no chip requer mudanças sistemáticas na infraestrutura:

Arquitetura do Circuito Primário: Unidades de Distribuição de Refrigerante (CDUs) gerenciam a troca de calor entre a água da instalação e os circuitos de resfriamento dos servidores. Cada CDU suporta 200-500kW de carga de TI, usando trocadores de calor de placas para isolar a água da instalação dos eletrônicos. Bombas redundantes mantêm diferenciais de pressão de 350-500 kPa. Controles inteligentes modulam o fluxo com base na temperatura da água de retorno, otimizando o consumo de energia.

Design do Circuito Secundário: Circuitos no nível do servidor usam água desmineralizada ou refrigerantes especializados para prevenir corrosão e crescimento biológico. A condutividade permanece abaixo de 0,5 μS/cm através de filtragem contínua. Biocidas previnem formação de algas. Inibidores de corrosão protegem metais dissimilares. Tamponamento de pH mantém a faixa de 7,0-8,5 para compatibilidade de materiais.

Integração no Nível do Rack: Trocadores de calor na porta traseira capturam o calor residual resfriado a ar da memória, armazenamento e fontes de alimentação. A abordagem híbrida alcança 100% de captura de calor no rack, eliminando a necessidade de resfriamento no nível da sala. Manifolds do rack distribuem refrigerante para servidores individuais através de mangueiras flexíveis classificadas para pressão de trabalho de 700 kPa.

Sistemas de Água da Instalação: Plantas de água gelada existentes se adaptam a temperaturas de retorno mais altas, melhorando a eficiência do chiller em 20-30%.⁸ As horas de free cooling aumentam dramaticamente quando as temperaturas de fornecimento sobem de 7°C para 20°C. Torres de resfriamento dimensionadas para água de retorno a 35°C permitem free cooling durante todo o ano em muitos climas.

Implantações reais comprovam a tecnologia

As instâncias Azure HBv4 da Microsoft usam resfriamento direto no chip para processadores AMD EPYC, alcançando PUE 1,11 em implantações de produção.⁹ A instalação de Quincy, Washington, processa 33MW de computação usando 3,6MW de potência de resfriamento. A economia anual excede US$ 4,8 milhões em comparação com alternativas resfriadas a ar. A confiabilidade dos servidores melhorou 23% devido às temperaturas de operação consistentes.

O supercomputador El Capitan do Lawrence Livermore National Laboratory emprega resfriamento direto no chip para 40.000 APUs AMD MI300A.¹⁰ O sistema alcança 2 exaflops mantendo PUE 1,08. O resfriamento com água morna a 35°C de temperatura de entrada permite free cooling durante todo o ano no clima da Califórnia. O projeto economiza US$ 12 milhões anualmente em custos de eletricidade.

Engenheiros da Introl implantaram resfriamento direto no chip em 15 instalações em nossa área de cobertura global, reduzindo o PUE médio de 1,55 para 1,18.¹¹ Uma instalação recente para uma operação de mineração de criptomoedas alcançou PUE 1,09 usando água de entrada a 40°C, eliminando completamente o resfriamento mecânico. O cliente economiza US$ 2,3 milhões anualmente enquanto aumenta a densidade de hashrate em 60%.

A seleção de componentes determina o sucesso

Tecnologias de Placa Fria: Designs de microcanais da CoolIT Systems alcançam resistência térmica de 0,015°C/W. Placas de impacto de jato da Motivair oferecem 0,012°C/W para fluxos de calor extremos. Placas aprimoradas com câmara de vapor da Aavid fornecem distribuição uniforme de temperatura para dies grandes. As escolhas de materiais incluem cobre para máxima condutividade, alumínio para otimização de custos e revestimento de níquel para resistência à corrosão.

Unidades de Distribuição de Refrigerante: CDUs ChilledDoor da Motivair lidam com 750kW com redundância de bomba N+1. Módulos de Distribuição de Refrigerante da CoolIT suportam 300kW em formato 8U. Unidades XDU da Vertiv oferecem capacidade de 450kW com detecção de vazamento integrada. A seleção depende do layout da instalação, requisitos de redundância e infraestrutura existente.

Sistemas de Monitoramento: O monitoramento contínuo previne falhas catastróficas. Sensores de fluxo detectam bloqueios antes que o superaquecimento ocorra. Sensores de pressão identificam vazamentos em segundos. Matrizes de temperatura mapeiam o desempenho térmico dos componentes. Medidores de condutividade alertam sobre contaminação do refrigerante. A integração com plataformas DCIM permite manutenção preditiva.

Química do Refrigerante: Os refrigerantes para data centers da Nalco Water previnem corrosão enquanto mantêm baixa condutividade. Os fluidos especializados SYLTHERM da Dow operam de -50°C a 260°C para aplicações extremas. Os refrigerantes de base biológica da Cargill oferecem sustentabilidade ambiental. Testes regulares mantêm propriedades ideais e estendem a vida útil dos equipamentos.

A análise econômica impulsiona decisões de adoção

O investimento de capital para resfriamento direto no chip varia de US$ 1.500 a US$ 3.000 por kW de carga de TI:¹²

Custos de Infraestrutura: - Unidades CDU: US$ 150.000 por capacidade de 300kW - Tubulação e manifolds: US$ 200 por servidor - Placas frias: US$ 400-800 por GPU - Mão de obra de instalação: US$ 300 por servidor - Refrigerante e tratamento: US$ 50 por servidor - Sistemas de monitoramento: US$ 100 por servidor - Total por rack 42U (20 servidores): US$ 45.000-65.000

Economia Operacional: - Redução de energia: US$ 12.000 por rack anualmente a US$ 0,10/kWh - Densidade aumentada: 40% mais computação por metro quadrado - Resfriamento mecânico reduzido: US$ 8.000 por rack anualmente - Menor consumo de ventiladores: US$ 3.000 por rack anualmente - Vida útil estendida dos componentes: MTBF 20% maior - Período de retorno: 18-24 meses

Custo Total de Propriedade: A análise de TCO de cinco anos mostra custos 35% menores versus resfriamento a ar para implantações de GPU de alta densidade. Uma instalação de 1.000 GPUs economiza US$ 8,5 milhões em cinco anos através de consumo reduzido de energia e densidade aumentada. Créditos de carbono e incentivos de sustentabilidade fornecem benefícios financeiros adicionais.

Estratégias de retrofit para instalações existentes

A conversão de infraestrutura resfriada a ar requer planejamento cuidadoso:

Fase 1 - Avaliação (30 dias): Avaliar capacidade de resfriamento existente, distribuição de energia e suporte estrutural. Identificar locais ideais para CDUs com acesso à água da instalação. Planejar rotas de tubulação evitando conflitos com infraestrutura existente. Calcular quedas de pressão e requisitos de bomba. Desenvolver cronograma de migração minimizando interrupções.

Fase 2 - Infraestrutura (60 dias): Instalar CDUs e tubulação primária durante janelas de manutenção programadas. Atualizar sistemas de água da instalação para temperaturas de retorno mais altas. Adicionar pontos de monitoramento em toda a rede de distribuição. Comissionar sistemas usando cargas simuladas antes da implantação em produção. Treinar equipe de operações em novos procedimentos.

Fase 3 - Migração (90 dias): Converter racks fileira por fileira para manter as operações. Começar com ambientes de desenvolvimento/teste para validar procedimentos. Mover cargas de trabalho de produção durante janelas de manutenção. Monitorar temperaturas e ajustar vazões para otimização. Documentar lições aprendidas para fases subsequentes.

Fase 4 - Otimização (contínua): Aumentar gradualmente as temperaturas do refrigerante para maximizar o free cooling. Ajustar vazões com base em cargas reais versus projetadas. Implementar manutenção preditiva usando dados dos sensores. Refinar algoritmos de controle para eficiência energética. Expandir implantação com base em resultados comprovados.

Desenvolvimentos futuros expandem os limites

O resfriamento por imersão bifásico promete PUE se aproximando de 1,02 ao eliminar completamente as bombas.¹³ Fluidos dielétricos fervem nas superfícies dos chips, condensando em superfícies mais frias para circulação passiva. Implantações iniciais mostram 95% de redução de energia versus resfriamento a ar. Os desafios incluem custos de fluido (US$ 200/litro) e preocupações com compatibilidade de materiais.

A integração de resfriamento on-chip incorpora microcanais diretamente nos substratos de silício.¹⁴ A IBM Research demonstrou remoção de calor de 1.700W/cm² usando resfriamento incorporado. A implementação em produção aguarda técnicas de fabricação economicamente viáveis. A tecnologia poderia permitir empilhamento de chips 3D com densidade de computação sem precedentes.

A recuperação de calor residual transforma o resfriamento de centro de custo em gerador de receita. Os data centers de Estocolmo fornecem 10% do aquecimento da cidade através da integração com aquecimento distrital.¹⁵ O resfriamento direto no chip em alta temperatura permite a recuperação de calor sem bombas de calor. Organizações alcançam custos de resfriamento líquidos negativos através da venda de calor residual.

Organizações que implementam resfriamento direto no chip obtêm vantagens competitivas substanciais através de eficiência aprimorada, densidade aumentada e custos operacionais mais baixos. A tecnologia se prova essencial para implantações de GPUs de próxima geração excedendo 700W por chip. Os primeiros adotantes estabelecem infraestrutura sustentável pronta para aumentos contínuos de densidade de potência, enquanto os retardatários enfrentam retrofits caros ou desvantagem competitiva. A transição do resfriamento a ar para líquido representa uma mudança fundamental no design de data centers que organizações com visão de futuro devem abraçar para permanecerem viáveis na era da IA.

Principais conclusões

Para arquitetos de infraestrutura: - O resfriamento direto no chip elimina 5 de 7 interfaces térmicas—15.000 W/m²K vs 50 W/m²K para ar - O PUE cai de 1,58 para 1,05-1,15—94% de redução na sobrecarga de energia de resfriamento - GPUs de 700W o

[Conteúdo truncado para tradução]