投機的デコーディング:LLM推論を2〜3倍高速化する技術

投機的デコーディングが研究段階から本番環境の標準技術へと成熟。NVIDIAがH200 GPUで3.6倍のスループット向上を実証。vLLMとTensorRT-LLMがネイティブサポートを搭載。ドラフトモデルが5〜8トークンを提案し、並列で検証—単一トークン生成では活用しきれないGPU容量を有効活用。出力品質は変わらず、レイテンシを2〜3倍短縮。

GPU インフラストラクチャ、AI、データセンターに関する知見。

投機的デコーディングが研究段階から本番環境の標準技術へと成熟。NVIDIAがH200 GPUで3.6倍のスループット向上を実証。vLLMとTensorRT-LLMがネイティブサポートを搭載。ドラフトモデルが5〜8トークンを提案し、並列で検証—単一トークン生成では活用しきれないGPU容量を有効活用。出力品質は変わらず、レイテンシを2〜3倍短縮。

高価値GPUデプロイメントを保護するAIインフラストラクチャ専用のセキュリティオペレーション。

データコム光学市場は2025年に60%以上成長し、160億ドルを超える見込み。800Gトランシーバー出荷は前年比100%増を達成。1.6TトランシーバーがNVIDIAおよびハイパースケール向けに量産開始。NVIDIAがシリコンフォトニクスを用いたコパッケージドオプティクス搭載スイッチを発表。Googleが光回路スイッチングで40%の省電力化を実証。OSFP-XDが主要1.6Tキャリアとして標準化(...

2029年までに推論がAIコンピューティングの65%を占め、AIの生涯コストの80〜90%を占めるようになる。トレーニングと推論のインフラが異なる最適化を必要とする理由を解説する。

UAE・米国AIキャンパスが5GWで発表—米国外最大規模、10平方マイルに展開。Microsoftが2023年から2029年にかけてUAEに152億ドルを投資。NEOMがDataVoltと50億ドルの契約を締結し、1.5GWのAIファクトリーを建設。Groqがサウジアラビアに15億ドルを投資し、世界最大の推論データセンターを発表。地域の容量は2030年までに1GWから3.3GWへ3倍に拡大。

ハイパースケーラーが原子力へ転換—Amazon(X-energy)、Google(Kairos Power)、Microsoft(スリーマイル島)が合計100億ドル以上を投資。AIデータセンターの電力需要は2030年までに165%増加。24/7 CFE(カーボンフリーエネルギー)が年間再生可能エネルギーマッチングに代わる標準的コミットメントに...

スマートハンズサービスが液体冷却の専門知識を含むように拡大—CDUメンテナンス、漏水対応、冷却液品質チェック。H100/H200のダウンタイムは現在GPU1台あたり1日25,000〜40,000ドルとなり、プレミアムSLAが不可欠に。AI専門技術者はプレミアム料金を獲得。コロケーションプロバイダーがGPU専用トレーニングプログラムを追加。予測保全がAI駆動監視により現場介入を30%削減。...

市場環境は大きく変化しました。H100 GPUの購入価格は現在25,000〜40,000ドル(ピーク時のプレミアムから下落)、8-GPUシステムは350,000〜400,000ドルとなっています。H200は15〜20%のプレミアムで...

この構想は2025年下半期に重要なマイルストーンを達成した。8月、科学技術情報通信部はNaver、SKテレコム、LGグループ、NCSoft、Upstageが率いる5つのコンソーシアムをソブリンAI開発の担い手として選定し、政府は3億8100万ドルの支援資金を割り当てた...

GPU に 300 万ドル投資しても、5 年間で実際には 1,570 万ドルのコストがかかります。電力、冷却、人件費により TCO はハードウェアの 165% 増となります。エンタープライズ AI の完全なコストモデルをご紹介します。

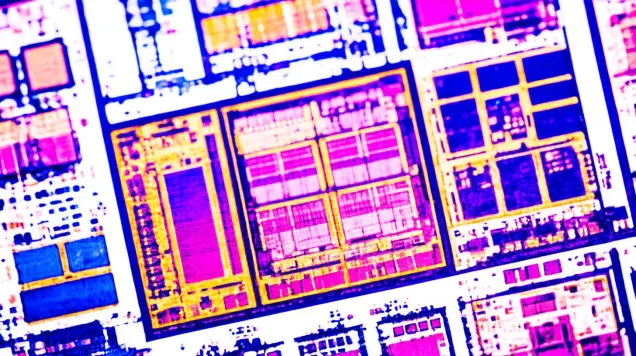

WSE-3搭載のCS-3がLlama 4 Maverickでユーザーあたり毎秒2,500トークンを達成—DGX B200 Blackwellの2倍以上の速度。WSE-3は4兆個のトランジスタ、90万個のAIコア、21 PB/sのメモリ帯域幅を持つ44GBオンチップSRAMを搭載...

ハイパースケーラーが原子力投資を加速—Amazon(X-energy)、Google(Kairos Power)、Microsoft(スリーマイル島再稼働)が合計100億ドル以上を投資。AIデータセンターの電力需要は2030年までに165%増加...

プロジェクトについてお聞かせください。72時間以内にご回答いたします。

お問い合わせありがとうございます。弊社チームがリクエストを確認し、72時間以内に回答いたします。