GPU 클러스터를 위한 환경 모니터링: 온도, 습도 및 공기 흐름 최적화

액체 냉각이 모니터링 요구사항을 변화시키고 있습니다—냉각수 온도, 유량, 압력이 공기 온도와 함께 중요한 지표가 되었습니다. H100/H200의 열 임계값이 80-83°C로 더욱 엄격해졌습니다...

GPU 인프라, AI, 데이터 센터에 대한 인사이트.

액체 냉각이 모니터링 요구사항을 변화시키고 있습니다—냉각수 온도, 유량, 압력이 공기 온도와 함께 중요한 지표가 되었습니다. H100/H200의 열 임계값이 80-83°C로 더욱 엄격해졌습니다...

AWS는 2025년 6월 H100 가격을 44% 인하했습니다(p5 인스턴스가 기존 시간당 약 $98에서 현재 약 $50-55 범위로 하락). H100 구매 가격이 $25,000-40,000로 안정되면서 손익분기점이 기존 7-11개월에서 12-18개월로 이동했습니다...

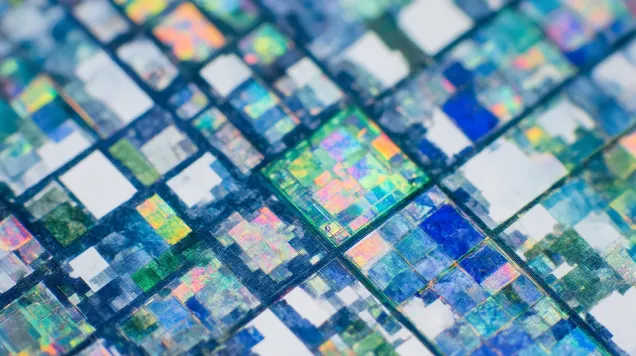

AI 데이터 센터는 기존 시설 대비 10배 더 많은 광섬유를 필요로 합니다. 평균 랙 밀도가 2022년 15kW에서 새로운 AI 홀에서는 40kW로 상승하며, 랙당 수평 케이블 배선이 2배로 증가하고 있습니다. 데이터 센터...

Meta의 데이터 전처리 서비스(DPP)가 엑사바이트 규모 학습 클러스터에서 데이터 지연을 완전히 제거합니다. WEKApod는 8개의 스토리지 노드에서 768개의 H100 GPU에 720GB/s 처리량을 제공합니다. PCIe Gen5...

Meta는 GPU 요구량을 400% 과소평가하여 8억 달러의 긴급 비용이 추가 발생했습니다. McKinsey는 2030년까지 156GW가 필요하며 5.2조 달러의 자본 지출이 필요할 것으로 전망합니다. 용량 계획 프레임워크를 소개합니다.

Waymo의 700대 차량은 14 PFLOPS 엣지 + 500 PFLOPS 클라우드를 필요로 합니다. Tesla는 월 30억 마일을 시뮬레이션합니다. 완전한 자율주행차 GPU 인프라 요구사항을 살펴봅니다.

FP8 훈련은 프로덕션 품질을 유지하면서 BF16 대비 연산량과 메모리 요구량을 약 절반으로 줄입니다. Microsoft, Meta, Google이 FP8로 프론티어 모델을 훈련하여 30-40%의 처리량 향상을 달성하고 있습니다...

8×H100 서버를 보유한 조직들이 수동 할당 방식으로 30-50% GPU 활용률을 보고—수십만 달러가 낭비되고 있습니다. NVIDIA의 Run:ai 인수로 GPU 오케스트레이션이 핵심 인프라 계층으로 자리잡았습니다...

에이전틱 AI 배포로 인해 토큰 소비량이 표준 생성형 AI 대비 20-30배 증가하고 있습니다. Gartner는 인프라 비용 초과로 인해 2027년까지 에이전트 프로젝트의 40%가 취소될 것으로 예측합니다. 메모리 아키텍처가 핵심으로 부상—에이전트는 지속적인 컨텍스트를 위해 3-5년의 데이터 보존이 필요합니다....

초고가용성이 요구되는 고밀도 AI 워크로드를 위해 특별히 설계된 백업 전원 인프라.

비트코인 채굴업체들이 50만 대의 ASIC을 안전하게 수중 운영하며 냉각 비용 96% 절감. GRC는 2.2년 투자 회수 달성. 계산기로 GPU 침수 냉각 ROI를 확인하세요.

마이크로소프트(300억 달러)와 구글(50억 파운드)이 2025년 9월 360억 달러 이상의 영국 합동 투자를 발표했습니다. 마이크로소프트는 영국 최대 슈퍼컴퓨터(23,000개 이상의 NVIDIA GPU)를 배치합니다. 4개의 AI 성장 구역이 데이터센터 건설을 가속화하고 있습니다...

프로젝트에 대해 알려주시면 72시간 내에 답변드리겠습니다.

문의해 주셔서 감사합니다. 저희 팀이 요청사항을 검토한 후 72시간 내에 답변드리겠습니다.