로컬 LLM 하드웨어 가이드 2025: 가격 및 사양

Dual RTX 5090은 70B 모델에서 H100과 동등한 성능을 25% 비용으로 제공합니다. 소비자용부터 엔터프라이즈 GPU까지 로컬 LLM 배포를 위한 완전한 하드웨어 가격 가이드.

Our most valuable guides on GPU infrastructure, AI hardware, and data center technology. Start here for expert insights that help you make better decisions.

Dual RTX 5090은 70B 모델에서 H100과 동등한 성능을 25% 비용으로 제공합니다. 소비자용부터 엔터프라이즈 GPU까지 로컬 LLM 배포를 위한 완전한 하드웨어 가격 가이드.

DeepSeek-V3.2는 10배 낮은 비용으로 수학적 추론에서 GPT-5와 동등한 성능을 보여줍니다. 오픈소스, MIT 라이선스이며, 최첨단 AI 경제성을 가능하게 하는 아키텍처 혁신을 제공합니다.

Google의 TPU 아키텍처는 256×256 시스톨릭 배열, 광학 회로 스위칭, 그리고 42.5 exaflop 슈퍼포드를 통해 Gemini 2.0과 Claude를 구동합니다.

NVIDIA의 H100, H200, B200 GPU는 각각 다른 AI 인프라 요구사항을 충족합니다. 검증된 워크호스 H100부터 메모리가 풍부한 H200, 그리고 획기적인 B200까지. 실제 성능, 비용, 전력 요구사항을 분석하여 특정 워크로드와 예산에 맞는 적절한 GPU를 선택할 수 있도록 도와드립니다

Claude Code CLI 완벽 가이드: 설치, 구성, 서브에이전트, MCP 통합, 훅, 스킬, 원격 실행, IDE 통합, 엔터프라이즈 배포 패턴을 다룹니다.

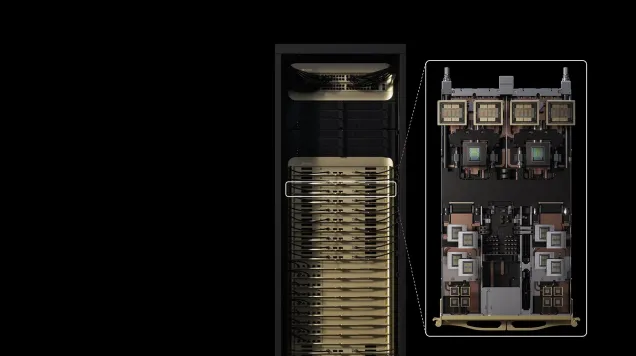

NVIDIA Vera Rubin은 2027년까지 데이터센터를 600kW 랙으로 발전시켜 7.5배의 성능 향상을 제공하면서 완전한 인프라 혁신을 요구합니다.

거대 기술 기업들이 AI 데이터센터에 전력을 공급하는 소형모듈원자로(SMR)에 100억 달러 이상을 투입하기로 약속했습니다. 원자력이 AI의 945 TWh 에너지 수요를 충족하면서 첫 번째 SMR 시설이 2030년까지 온라인에 구축될 예정입니다.

DeepSeek의 새로운 다양체 제약 하이퍼 연결(Manifold-Constrained Hyper-Connections) 프레임워크가 10년 묵은 확장 문제를 해결했다. 단 6.7%의 오버헤드만으로 270억 개 이상의 파라미터 모델을 안정적으로 학습할 수 있게 됐다.

프로젝트에 대해 알려주시면 72시간 내에 답변드리겠습니다.

문의해 주셔서 감사합니다. 저희 팀이 요청사항을 검토한 후 72시간 내에 답변드리겠습니다.