Local LLM Hardware Leitfaden 2025: Preise & Spezifikationen

Duale RTX 5090s erreichen H100-Leistung für 70B-Modelle bei 25% der Kosten. Vollständiger Hardware-Preisleitfaden für lokale LLM-Bereitstellung von Consumer- bis Enterprise-GPUs.

Our most valuable guides on GPU infrastructure, AI hardware, and data center technology. Start here for expert insights that help you make better decisions.

Duale RTX 5090s erreichen H100-Leistung für 70B-Modelle bei 25% der Kosten. Vollständiger Hardware-Preisleitfaden für lokale LLM-Bereitstellung von Consumer- bis Enterprise-GPUs.

DeepSeek-V3.2 erreicht die gleiche Leistung wie GPT-5 beim mathematischen Denken bei 10× niedrigeren Kosten. Open Source, MIT-lizenziert, mit architektonischen Innovationen, die fr...

Googles TPU-Architektur treibt Gemini 2.0 und Claude durch 256×256 systolische Arrays, optisches Circuit Switching und 42,5 Exaflop Superpods an – erklärt.

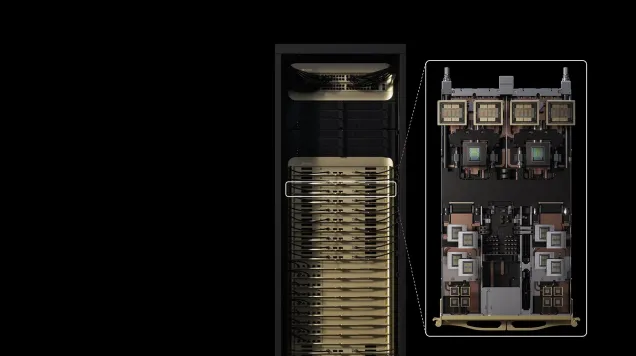

NVIDIAs H100-, H200- und B200-GPUs bedienen jeweils unterschiedliche AI-Infrastrukturbedürfnisse – vom bewährten H100-Arbeitstier über die speicherreiche H200 bis hin zur bahnbrech...

Vollständiger Claude Code CLI-Leitfaden: Installation, Konfiguration, Subagents, MCP-Integrationen, Hooks, Skills, Remote-Ausführung, IDE-Integration und Enterprise-Deployment-Patt...

NVIDIA Vera Rubin drängt Rechenzentren bis 2027 zu 600kW-Racks und liefert 7,5-fache Leistungssteigerungen, während eine vollständige Infrastrukturtransformation erforderlich wird.

Tech-Giganten verpflichten sich zu 10+ Milliarden Dollar für kleine modulare Reaktoren zur Stromversorgung von AI-Rechenzentren. Erste SMR-Anlagen gehen bis 2030 online, da Kernene...

DeepSeeks neues Manifold-Constrained Hyper-Connections Framework löst ein jahrzehntealtes Skalierungsproblem und ermöglicht stabiles Training von Modellen mit über 27 Milliarden Pa...

Erzählen Sie uns von Ihrem Projekt und wir antworten innerhalb von 72 Stunden.

Vielen Dank für Ihre Anfrage. Unser Team wird Ihre Anfrage prüfen und innerhalb von 72 Stunden antworten.