小型模块化核反应堆(SMR)为AI提供动力:100亿美元核能革命正在改变数据中心

科技巨头承诺投资超过100亿美元用于为AI数据中心提供动力的小型模块化反应堆。首批SMR设施将于2030年上线,以核能满足AI 945 TWh的能源需求。

关于 GPU 基础设施、AI 和数据中心的深度洞察。

科技巨头承诺投资超过100亿美元用于为AI数据中心提供动力的小型模块化反应堆。首批SMR设施将于2030年上线,以核能满足AI 945 TWh的能源需求。

新加坡承诺投入16亿美元政府资金和260亿美元科技投资,致力于成为东南亚AI中心,创造NVIDIA全球收入的15%。

日本10万亿日元AI推进计划驱动2.1GW数据中心,部署10,000+个GPU。政府-企业1350亿美元融合打造亚洲量子-AI强国。

韩国承诺到2027年投资650亿美元用于AI基础设施建设,Samsung和SK Hynix控制着全球90%的HBM内存市场。数据中心扩展至3千兆瓦,部署15,000个GPU,并与AWS、Microsoft和NVIDIA建立合作伙伴关系,将首尔打造成亚洲的AI之都。

GPU机架达到50kW热限制。液冷技术实现21%节能,40%成本降低。AI基础设施团队面临瓶颈的必备指南。

印尼以92%的采用率领跑全球AI应用,预计到2030年市场规模将达到108.8亿美元。科技巨头在基础设施方面投资数十亿美元,同时本土初创企业在这个东南亚最大经济体中推动本土创新。

Isambard-AI创纪录地部署了5,448个NVIDIA GPU,这揭示了为什么现代AI基础设施需要液体冷却、高密度供电和复杂网络方面的专业技术。

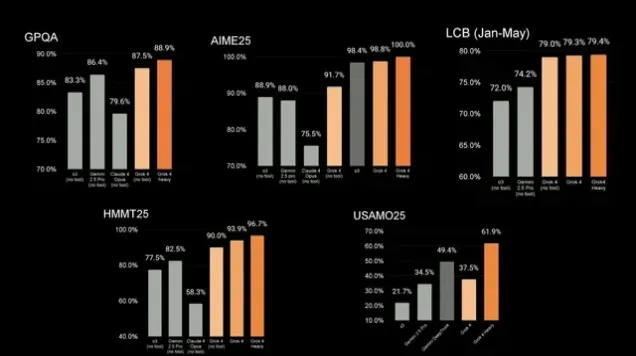

xAI的Grok 4凭借其200,000个GPU的基础设施实现了前所未有的基准测试分数,在关键推理测试中的表现是竞争对手的两倍。该模型独特的多智能体方法以及与Tesla的CFD软件的集成,标志着从AI助手向真正推理伙伴的转变。

NVIDIA的功率平滑技术将电网需求降低30%。液冷系统可处理1,600W GPU。明智的公司看到350% ROI,而其他公司面临80%的失败率。

随着AI工作负载将机架密度推至100千瓦以上,数据中心必须掌握用于数据流的结构化布线和用于散热的液冷技术。了解如何设计能够让GPU保持峰值性能运行的基础设施。

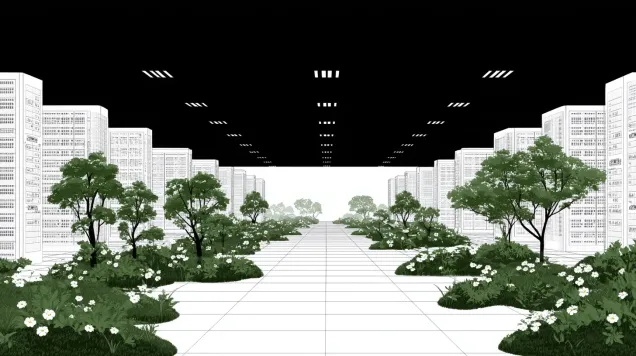

数据中心为我们的数字世界提供动力,但消耗大量资源。了解可持续设计的成熟策略——从液体冷却和节水到智能选址和绿色建设——既能降低成本又能实现ESG目标。

英伟达的GB300 NVL72采用72个Blackwell Ultra GPU,每个GPU配备288 GB内存,NVLink带宽达130 TB/s,AI性能比GB200提升1.5倍。以下是部署工程师需要了解的关于这些120千瓦AI数据中心机柜的电力、冷却和布线信息。

告诉我们您的项目需求,我们将在72小时内回复。

感谢您的咨询。我们的团队将审核您的请求并在72小时内回复。