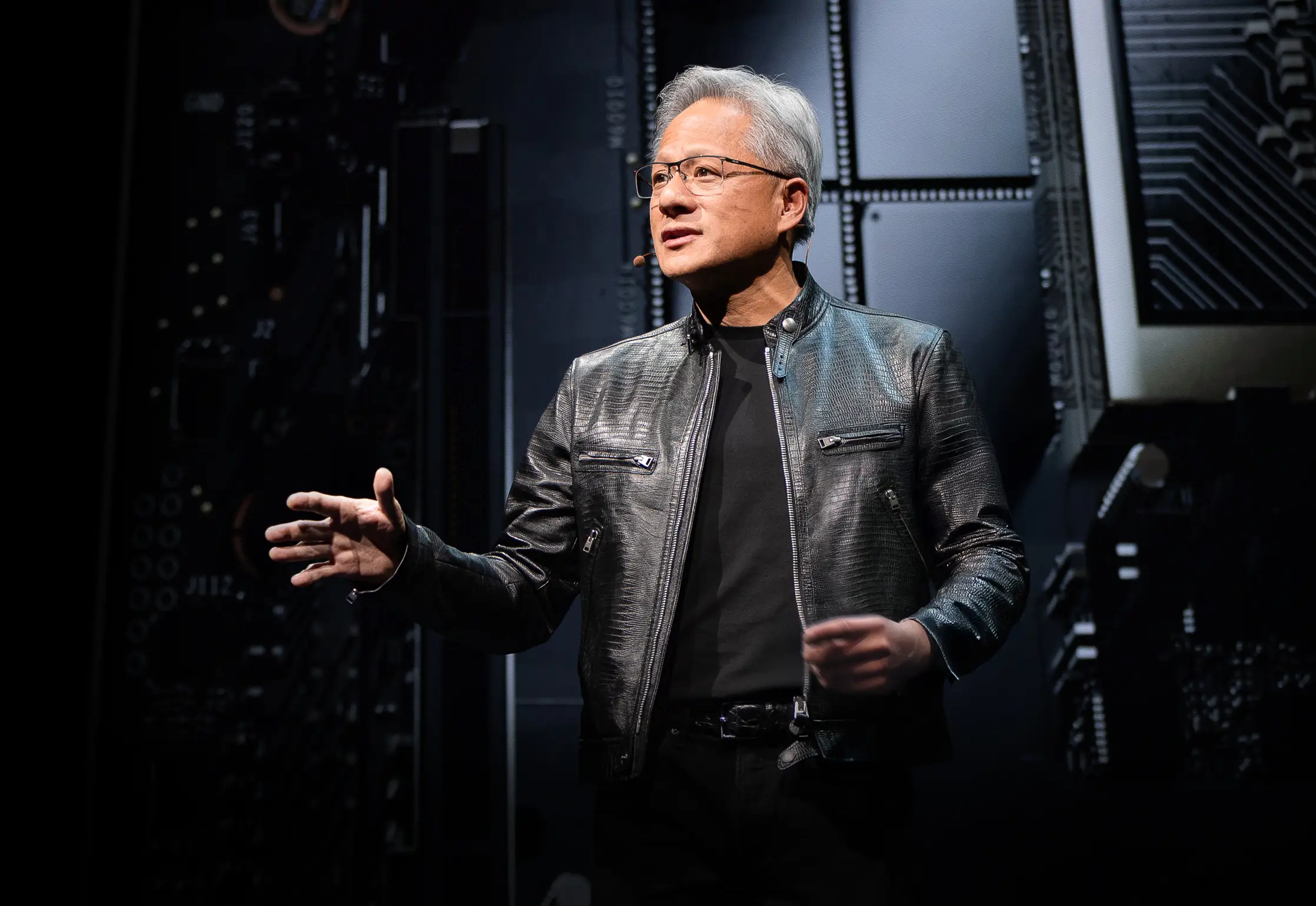

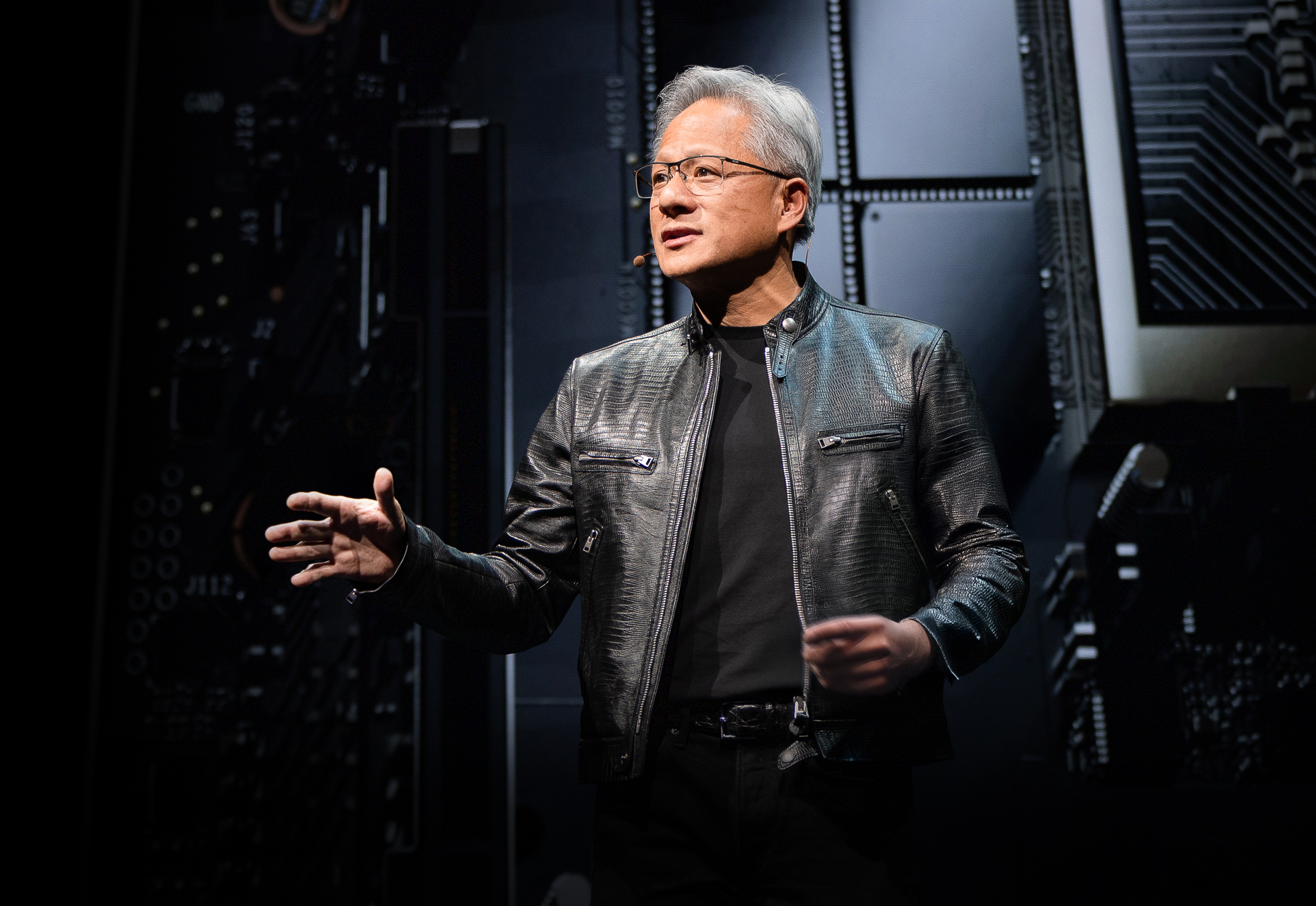

El CEO de NVIDIA, Jensen Huang, subió al escenario en Computex 2025 con su característica chaqueta de cuero y presentó nuevo hardware y un paradigma computacional completamente reimaginado. El gigante de los semiconductores se ha transformado decisivamente en una empresa de infraestructura de IA, construyendo los cimientos de lo que Huang llama "la infraestructura de la inteligencia"—la tercera gran revolución de infraestructura después de la electricidad e internet.

Este discurso no fue solo otro anuncio de producto—fue Jensen exponiendo el plan de NVIDIA para remodelar el panorama computacional. Los avances técnicos, los giros estratégicos y las jugadas de mercado que reveló probablemente harán de este el Computex que referenciaremos durante años. Mira el discurso completo de NVIDIA en Computex 2025.

La Evolución Estratégica de NVIDIA: De Tarjetas Gráficas a Proveedor de Infraestructura

La historia de transformación de NVIDIA es impresionante. En 1993, Jensen vio una "oportunidad de chip de $300 millones"—un mercado sustancial. Avancemos hasta hoy, y está al mando de un gigante de infraestructura de IA de un billón de dólares. Ese tipo de crecimiento explosivo no sucede por casualidad—NVIDIA se reinventó fundamentalmente múltiples veces en el camino.

Durante su discurso, Jensen destacó los puntos de inflexión que hicieron posible la NVIDIA de hoy:

-

2006: CUDA llegó y revolucionó la computación paralela. De repente, desarrolladores que nunca habían considerado usar GPUs para computación general estaban construyendo aplicaciones que habrían sido imposibles en CPUs tradicionales.

-

2016: El DGX1 emergió como el primer sistema de NVIDIA sin compromisos, enfocado en IA. En lo que ahora parece un presagio casi inquietante, Jensen donó la primera unidad a OpenAI, efectivamente dándoles la base computacional que eventualmente llevaría a nuestra actual revolución de IA.

-

2019: La adquisición de Mellanox, permitiendo a NVIDIA reconceptualizar los centros de datos como unidades de computación unificadas

Esta transformación culmina en la posición actual de NVIDIA como "una empresa de infraestructura esencial"—un estatus que Huang enfatizó al destacar sus hojas de ruta públicas de cinco años sin precedentes, que permiten la planificación global de infraestructura para el despliegue de IA.

Redefiniendo las Métricas de Rendimiento: La Economía de Tokens

NVIDIA ha introducido un cambio fundamental en cómo medimos la producción computacional. En lugar de métricas tradicionales como FLOPs u operaciones por segundo, Huang posicionó los centros de datos de IA como fábricas que producen "tokens"—unidades de inteligencia computacional:

"Las empresas están empezando a hablar sobre cuántos tokens produjeron el último trimestre y cuántos tokens produjeron el mes pasado. Muy pronto, discutiremos cuántos tokens producimos cada hora, tal como lo hace cada fábrica."

Este reencuadre conecta directamente la inversión computacional y la producción empresarial, alineando la infraestructura de IA con los marcos industriales tradicionales. El modelo posiciona a NVIDIA en el epicentro de un nuevo paradigma económico donde la eficiencia computacional se traduce directamente en capacidad empresarial.

Mejoras de la Arquitectura Blackwell: Especificaciones y Métricas de Rendimiento del GB300

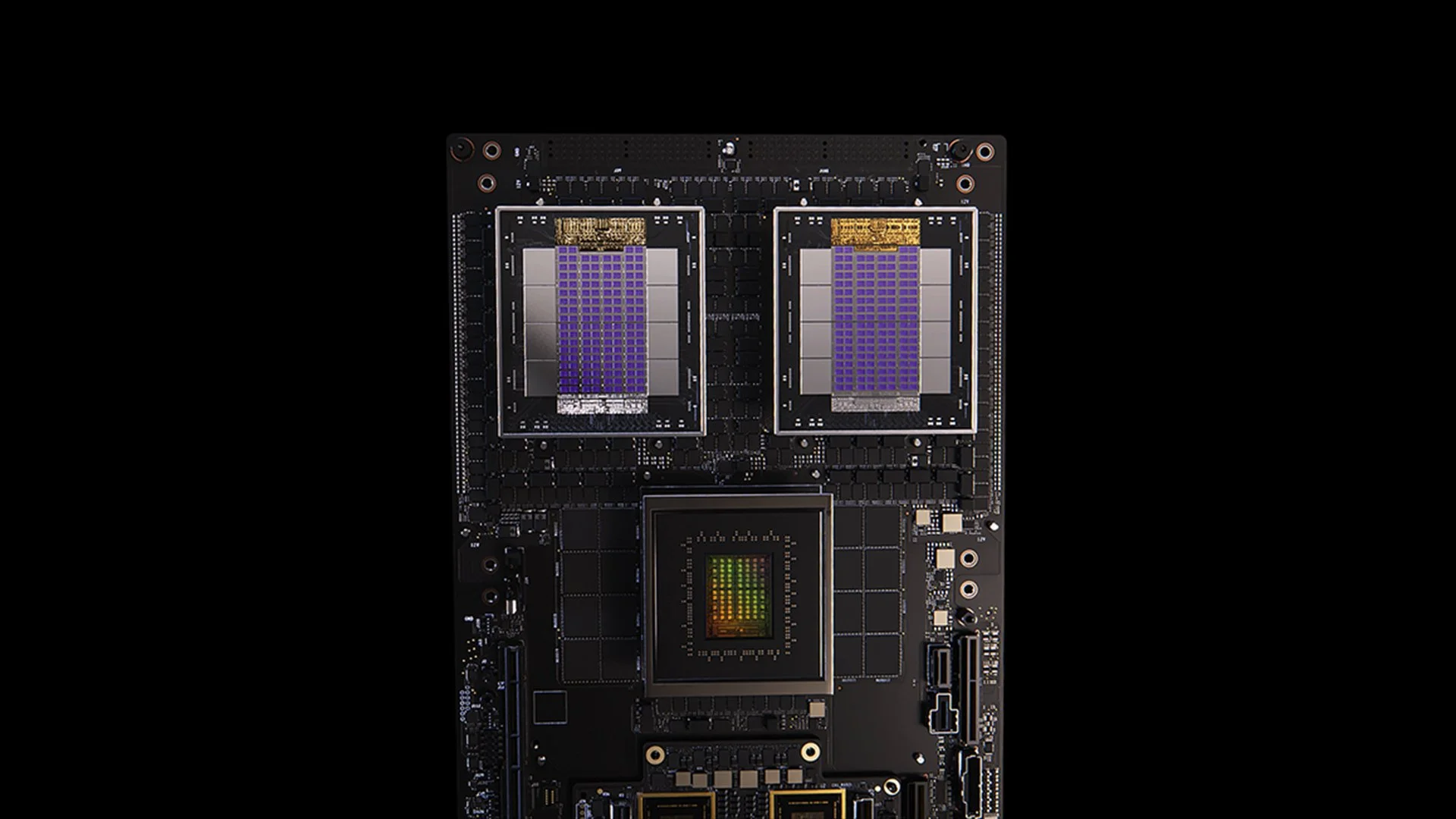

[caption id="" align="alignnone" width="1280"] Sistema GB200 [/caption]

Sistema GB200 [/caption]

La actualización GB300 de la arquitectura Blackwell ejemplifica el ciclo implacable de mejora de rendimiento de NVIDIA. Programado para el Q3 2025, el GB300 ofrece:

-

1.5x de aumento en rendimiento de inferencia sobre GB200

-

1.5x de incremento en capacidad de memoria HBM

-

2x de mejora en ancho de banda de red

-

Diseño completamente refrigerado por líquido

-

Compatible con chasis y sistemas existentes

Cada nodo GB300 entrega aproximadamente 40 petaflops—reemplazando efectivamente toda la supercomputadora Sierra (circa 2018), que requería 18,000 GPUs Volta. Esta ganancia de rendimiento de 4,000x en seis años supera ampliamente el escalado tradicional de la Ley de Moore, demostrando el enfoque multifacético de NVIDIA para la aceleración del rendimiento a través de innovaciones en arquitectura, software e interconexión.

MVLink: Redefiniendo la Tecnología de Interconexión

MVLink representa el avance más significativo en tecnología de interconexión de GPUs desde la introducción de NVLink. El sistema permite la desagregación completa de recursos de cómputo a través de todo un rack, convirtiendo 72 GPUs (144 dies de GPU) en una única unidad computacional masiva.

Las especificaciones técnicas son impresionantes:

-

Switches MVLink individuales: 7.2 TB/s de ancho de banda

-

Spine MVLink: 130 TB/s de ancho de banda todos-a-todos

-

Implementación física: 5,000 cables coaxiales de longitud precisamente igualada (aproximadamente 2 millas en total)

-

Densidad de potencia: 120 kilovatios por rack (requiriendo refrigeración líquida)

Para contexto, Huang señaló que el tráfico pico de todo internet es aproximadamente 900 terabits por segundo (112.5 TB/s), haciendo que un solo spine MVLink sea capaz de manejar más tráfico que internet global en su capacidad máxima.

MVLink Fusion: Creando un Ecosistema Abierto de Infraestructura de IA

MVLink Fusion podría ser la jugada de ecosistema más innovadora que NVIDIA ha hecho en años. En lugar de forzar a los socios a apostar todo por el hardware de NVIDIA, están abriendo la arquitectura para permitir que las empresas construyan sistemas de IA semi-personalizados que aún se conectan al universo de NVIDIA.

El enfoque es sorprendentemente flexible:

-

Integración de ASIC Personalizado: ¿Tienes tu acelerador especializado? No hay problema. Los socios pueden incorporar chiplets MVLink para conectar su silicio personalizado al ecosistema de NVIDIA. Es como si NVIDIA dijera: "Construye el hardware especializado que quieras—solo asegúrate de que pueda comunicarse con nuestros sistemas."

-

Integración de CPU Personalizada: Los proveedores de CPU tampoco quedan fuera. Pueden implementar directamente las interfaces chip-a-chip de MVLink, creando una autopista directa entre sus procesadores y las GPUs Blackwell (o la próxima arquitectura Ruben). MVLink es enorme para empresas invertidas en arquitecturas de CPU específicas.

Los anuncios de socios abarcan la industria de semiconductores:

-

Socios de implementación de silicio: LCHIP, Astera Labs, Marll, MediaTek

-

Proveedores de CPU: Fujitsu, Qualcomm

-

Proveedores de EDA: Cadence, Synopsis

Este enfoque posiciona estratégicamente a NVIDIA para capturar valor independientemente de la mezcla de hardware específica que los clientes desplieguen, reflejando la declaración franca de Huang: "Nada me da más alegría que cuando compras todo de NVIDIA. Quiero que sepan eso. Pero me da una tremenda alegría si compras algo de NVIDIA."

Despliegue de IA Empresarial: RTX Pro Enterprise y Omniverse Server

RTX Pro Enterprise y Omniverse server representan la oferta de cómputo más significativa enfocada en empresas de NVIDIA, diseñada específicamente para integrar capacidades de IA en entornos de TI tradicionales:

-

Arquitectura completamente compatible con x86

-

Soporte para hipervisores tradicionales (VMware, Red Hat, Nanix)

-

Integración con Kubernetes para orquestación familiar de cargas de trabajo

-

GPUs Blackwell RTX Pro 6000s (8 por servidor)

-

Chip de red CX8 que proporciona 800 Gb/s de ancho de banda

-

1.7x de mejora en rendimiento versus Hopper H100

-

4x de rendimiento en modelos optimizados como Deepseek R1

El sistema establece un nuevo umbral de rendimiento para inferencia de IA, medido en un marco de doble eje de throughput (tokens por segundo) y capacidad de respuesta (tokens por segundo por usuario)—métricas críticas para lo que Huang describe como la era del "escalado en tiempo de inferencia" o "IA pensante."

Plataforma de Datos de IA: Reimaginando el Almacenamiento para Datos No Estructurados

La Plataforma de Datos de IA de NVIDIA introduce un enfoque fundamentalmente diferente al almacenamiento empresarial:

"Los humanos consultan bases de datos estructuradas como SQL... Pero la IA quiere consultar datos no estructurados. Quieren semántica. Quieren significado. Y por eso tenemos que crear un nuevo tipo de plataforma de almacenamiento."

Componentes clave incluyen:

-

NVIDIA AIQ (o IQ): Una capa de consulta semántica

-

Nodos de almacenamiento acelerados por GPU reemplazando arquitecturas tradicionales centradas en CPU

-

Modelos de IA post-entrenados con procedencia transparente de datos de entrenamiento

-

15x más rápido en consultas con 50% de mejora en resultados comparado con soluciones existentes

Socios de la industria de almacenamiento implementando esta arquitectura incluyen Dell, Hitachi, IBM, NetApp y Vast, creando un ecosistema integral de gestión de datos de IA empresarial.

Operaciones de IA y Robótica: Frameworks de Software para la Empresa Inteligente

El discurso introdujo dos frameworks de software cruciales:

-

Operaciones de IA (AIOps): Un stack completo para gestionar agentes de IA en contextos empresariales, incluyendo curación de datos, ajuste fino de modelos, evaluación, barreras de seguridad y protección. Los socios incluyen Crowdstrike, Data IQ, Data Robots, Elastic, Newonix, Red Hat y Trend Micro.

-

Isaac Groot Platform N1.5: Un ecosistema de desarrollo de robótica de código abierto que incluye:

Motor de física Newton (desarrollado con Google DeepMind y Disney Research)

-

Procesador de robótica Jetson Thor

-

Sistema operativo NVIDIA Isaac

-

Blueprint Groot Dreams para generación de datos de trayectoria sintéticos

La iniciativa de robótica aborda un desafío crítico: "Para que la robótica suceda, necesitas IA. Pero para enseñar a la IA, necesitas IA." Este patrón de optimización recursiva aprovecha la IA generativa para expandir datos limitados de demostración humana en conjuntos de entrenamiento de robótica completos.

La Posición Estratégica de Taiwán en la Revolución de Manufactura de IA

Una porción significativa del discurso destacó el papel fundamental de Taiwán tanto en producir como en implementar tecnologías de IA:

-

Empresas manufactureras taiwanesas (TSMC, Foxconn, Wistron, Pegatron, Delta Electronics, Quanta, Wiiwin, Gigabyte) están desplegando NVIDIA Omniverse para implementaciones de gemelos digitales.

-

TSMC está usando herramientas potenciadas por IA en CUDA para optimizar diseños de fábricas y sistemas de tuberías

-

Los socios de manufactura usan gemelos digitales para planificación virtual, mantenimiento predictivo y como "gimnasios de robots" para entrenar sistemas robóticos.

-

Foxconn, TSMC, el gobierno taiwanés y NVIDIA están construyendo la primera supercomputadora de IA a gran escala de Taiwán.

Huang cementó aún más el compromiso de NVIDIA con la región al anunciar planes para "NVIDIA Constellation", una nueva sede en Taipei.

Análisis Técnico: Qué Significa Esto para la Estrategia de IA Empresarial

Estos anuncios colectivamente representan una reimaginación integral de la computación empresarial con varias implicaciones estratégicas:

-

Requisitos de Escala Computacional: Las demandas de rendimiento en tiempo de inferencia de la "IA de razonamiento" y los sistemas agénticos impulsarán requisitos de cómputo significativamente mayores que los despliegues iniciales de modelos de lenguaje grande, requiriendo planificación arquitectónica para capacidades masivas de escalado vertical y horizontal.

-

Desagregación de la IA Empresarial: El ecosistema MVLink Fusion permite una flexibilidad sin precedentes en la construcción de sistemas de IA heterogéneos, potencialmente acelerando la adopción de aceleradores de IA especializados mientras mantiene la posición de NVIDIA en el ecosistema a través de la tecnología de interconexión.

-

Cambio de Centros de Datos a Fábricas de IA: Necesitamos repensar completamente cómo medimos el valor de nuestras inversiones en infraestructura. Quedaron atrás los días en que la capacidad bruta de cómputo o almacenamiento contaba toda la historia. Ahora todo se trata de producción de tokens—¿cuántas unidades de salida de IA pueden generar tus sistemas por segundo, por vatio y por dólar? Jensen no bromeaba cuando dijo que las empresas pronto reportarían su producción de tokens como métricas de manufactura. El cambio a fábricas de IA reescribirá fundamentalmente la economía de cómo desplegamos y justificamos el gasto en infraestructura de IA.

-

Integración de Gemelos Digitales: El hecho de que cada fabricante taiwanés importante esté construyendo gemelos digitales en Omniverse nos dice todo lo que necesitamos saber—esto ya no es solo una demostración tecnológica genial. Los gemelos digitales se han convertido en infraestructura esencial para empresas serias sobre la optimización. Lo que es particularmente fascinante es cómo esto crea un ciclo de retroalimentación: las empresas construyen gemelos digitales para optimizar procesos físicos, luego usan esos mismos entornos para entrenar IA y robótica, mejorando aún más el mundo físico. Es un ciclo de mejora continua que sigue acelerándose.

-

Planificación de Fuerza Laboral Robótica: La convergencia de IA agéntica y robótica física sugiere que las organizaciones deberían desarrollar estrategias integradas de automatización digital y física, con implicaciones significativas para la planificación de fuerza laboral y el diseño de instalaciones.

-

Infraestructura Definida por Software: A pesar de los anuncios de hardware, el énfasis continuo de NVIDIA en bibliotecas y frameworks de software refuerza que la ventaja competitiva en IA vendrá de la optimización de software tanto como de las capacidades brutas del hardware.

Navegando la Transición a Fábricas de IA

Transformar centros de datos tradicionales en fábricas de IA requiere experiencia especializada que conecte el despliegue de hardware, la optimización de software y el diseño arquitectónico. En Introl, hemos estado implementando estas soluciones avanzadas de infraestructura GPU para empresas que dan el salto a la computación centrada en IA. La profunda experiencia de nuestro equipo con el ecosistema de NVIDIA—desde despliegues complejos de MVLink hasta implementaciones de gemelos digitales en Omniverse—ayuda a las organizaciones a navegar este cambio de paradigma sin la pronunciada curva de aprendizaje típicamente asociada con infraestructura de vanguardia. Ya sea escalando capacidades de IA de razonamiento o construyendo tu primera planta de fábrica de IA, asociarte con especialistas puede acelerar dramáticamente tu tiempo de valor en este panorama rápidamente evolutivo. ¿Listo para hacerlo realidad? Agenda una llamada hoy.

Conclusión: La Tercera Era de la Computación Ha Llegado

Computex no fue solo NVIDIA mostrando chips más rápidos. Lo que Jensen presentó fue más allá de los anuncios usuales de "20% mejor que el año pasado" a los que nos hemos insensibilizado. Está reencuadrando fundamentalmente para qué sirven las computadoras. Hemos pasado décadas construyendo máquinas que procesan números y mueven datos. Ahora, NVIDIA está construyendo sistemas que fabrican inteligencia como su producción principal. Es como comparar un archivador con un cerebro. Claro, ambos almacenan información, pero uno permanece ahí mientras el otro crea nuevas ideas. El cambio puede sonar como semántica hasta que te das cuenta de que cambia todo sobre cómo construimos, desplegamos y medimos los sistemas de computación.

"Por primera vez en todo nuestro tiempo juntos, no solo estamos creando la próxima generación de TI, sino que hemos hecho eso varias veces, desde PC a internet a la nube a la nube móvil. Lo hemos hecho varias veces. Pero esta vez, no solo estamos creando la próxima generación de TI, estamos creando toda una nueva industria."

Esta transición representa el tercer cambio de paradigma computacional importante, siguiendo a la revolución de la computación personal y la era de internet/nube. Las organizaciones que integren estas capacidades de infraestructura de IA probablemente establecerán ventajas competitivas insuperables en todas las industrias.

Las fábricas de inteligencia computacional están en construcción hoy. La pregunta ya no es si la IA transformará los negocios—es si tu organización está construyendo la infraestructura para permanecer competitiva en un mundo donde la inteligencia computacional se vuelve tan fundamental para las operaciones empresariales como la electricidad.

## Referencias y Recursos Adicionales

-

Descripción Oficial de la Arquitectura Blackwell de NVIDIA: https://www.nvidia.com/en-us/data-center/technologies/blackwell-architecture/

-

Documentación Técnica de MVLink de NVIDIA: https://developer.nvidia.com/mvlink

-

Plataforma NVIDIA Omniverse: https://www.nvidia.com/en-us/omniverse/

-

Plataforma de Robótica Isaac: https://developer.nvidia.com/isaac-ros

-

NVIDIA AI Enterprise: https://www.nvidia.com/en-us/data-center/products/ai-enterprise/

-

Materiales de Prensa Oficiales de NVIDIA Computex 2025: https://nvidianews.nvidia.com/news/computex-2025

-

Descripción de Bibliotecas NVIDIA CUDA-X: https://developer.nvidia.com/gpu-accelerated-libraries

-

Sistemas NVIDIA DGX: https://www.nvidia.com/en-us/data-center/dgx-systems/