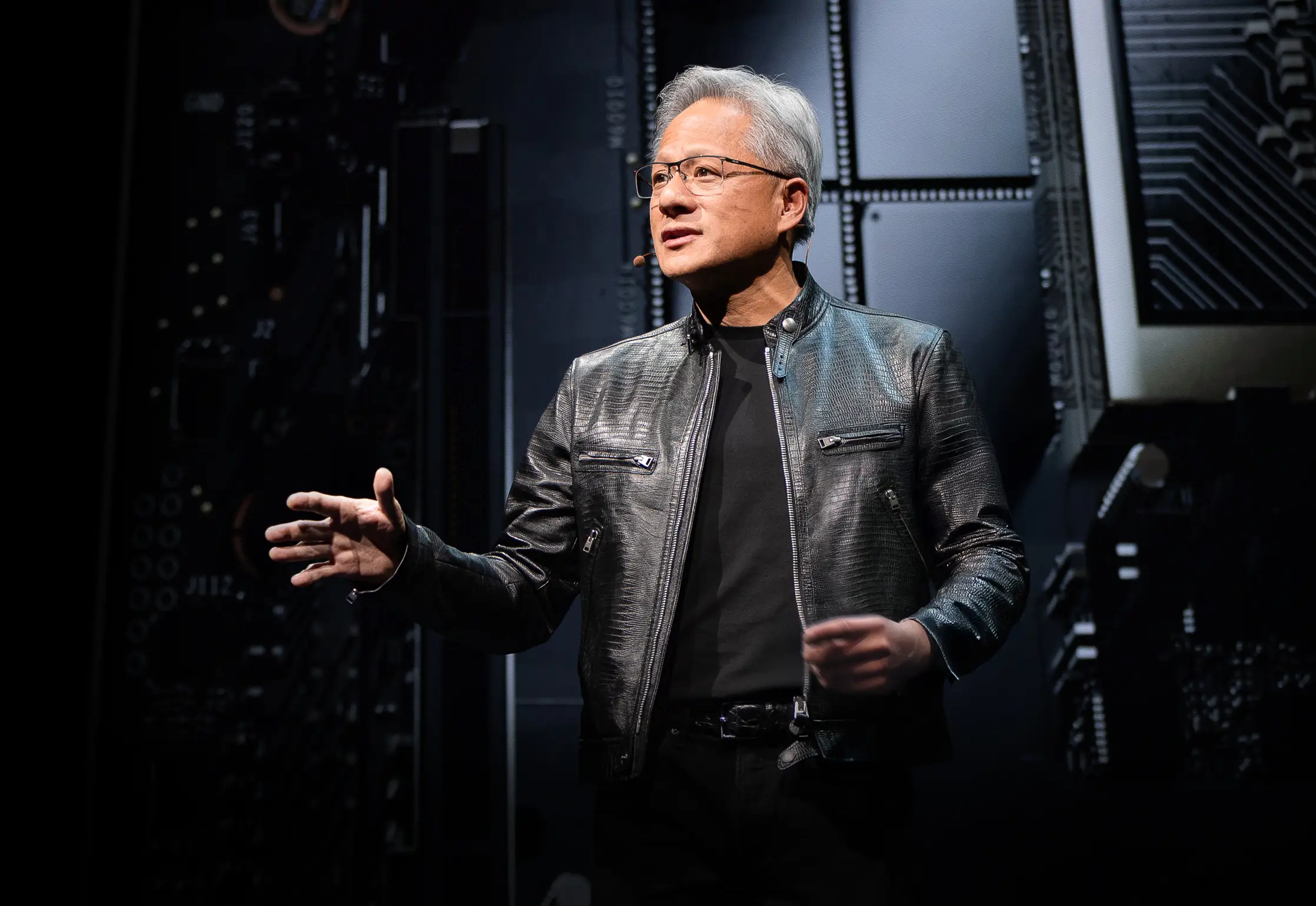

CEO NVIDIA Jensen Huang đã lên sân khấu tại Computex 2025 trong chiếc áo khoác da đặc trưng của mình và công bố phần cứng mới cùng một mô hình điện toán được tái tưởng tượng hoàn toàn. Gã khổng lồ bán dẫn này đã chuyển đổi một cách quyết định thành một công ty hạ tầng AI, xây dựng nền tảng cho thứ mà Huang gọi là "hạ tầng của trí tuệ"—cuộc cách mạng hạ tầng lớn thứ ba sau điện và internet.

Bài phát biểu chính này không chỉ là một thông báo sản phẩm khác—đây là Jensen trình bày kế hoạch chi tiết của NVIDIA để định hình lại bối cảnh điện toán. Những bước nhảy vọt về kỹ thuật, xoay trục chiến lược, và các động thái thị trường mà ông tiết lộ có khả năng khiến đây trở thành Computex mà chúng ta sẽ tham chiếu trong nhiều năm tới. Xem toàn bộ bài phát biểu chính Computex 2025 của Nvidia.

Sự Tiến Hóa Chiến Lược Của NVIDIA: Từ Card Đồ Họa Đến Nhà Cung Cấp Hạ Tầng

Câu chuyện chuyển đổi của NVIDIA thật đáng kinh ngạc. Năm 1993, Jensen nhìn thấy một "cơ hội chip 300 triệu đô la"—một thị trường đáng kể. Chuyển nhanh đến hôm nay, ông đang điều khiển một gã khổng lồ hạ tầng AI trị giá nghìn tỷ đô la. Sự tăng trưởng bùng nổ như vậy không chỉ xảy ra một cách tình cờ—NVIDIA đã tự cải tạo mình một cách căn bản nhiều lần trên con đường này.

Trong bài phát biểu chính, Jensen nhấn mạnh những bước ngoặt đã tạo nên NVIDIA ngày nay:

-

2006: CUDA ra đời và đã lật ngược điện toán song song. Đột nhiên, những nhà phát triển chưa từng cân nhắc sử dụng GPU cho điện toán tổng quát đã xây dựng các ứng dụng mà không thể thực hiện được trên CPU truyền thống.

-

2016: DGX1 xuất hiện như hệ thống AI tập trung đầu tiên không thỏa hiệp của NVIDIA. Trong cái mà giờ nhìn lại như một sự báo trước gần như kỳ lạ, Jensen đã tặng chiếc đầu tiên cho OpenAI, thực sự cung cấp cho họ nền tảng tính toán để cuối cùng dẫn đến cuộc cách mạng AI hiện tại.

-

2019: Việc mua lại Mellanox, cho phép NVIDIA tái khái niệm hóa các trung tâm dữ liệu thành các đơn vị điện toán thống nhất

Sự chuyển đổi này đỉnh điểm trong vị thế hiện tại của NVIDIA là "một công ty hạ tầng thiết yếu"—một địa vị mà Huang nhấn mạnh bằng cách làm nổi bật các lộ trình công cộng năm năm chưa từng có, cho phép lập kế hoạch hạ tầng toàn cầu cho triển khai AI.

Định Nghĩa Lại Thước Đo Hiệu Suất: Nền Kinh Tế Token

NVIDIA đã giới thiệu một sự thay đổi căn bản trong cách chúng ta đo lường đầu ra tính toán. Thay vì các thước đo truyền thống như FLOPs hay phép toán mỗi giây, Huang định vị các trung tâm dữ liệu AI như những nhà máy sản xuất "token"—đơn vị của trí tuệ tính toán:

"Các công ty đang bắt đầu nói về việc họ sản xuất bao nhiêu token trong quý vừa qua và bao nhiêu token họ sản xuất tháng vừa qua. Rất sớm, chúng ta sẽ thảo luận về việc chúng ta sản xuất bao nhiêu token mỗi giờ, giống như mọi nhà máy làm."

Việc đóng khung lại này kết nối trực tiếp đầu tư tính toán và đầu ra kinh doanh, gắn hạ tầng AI với các khuôn khổ công nghiệp truyền thống. Mô hình này định vị NVIDIA ở trung tâm của một mô hình kinh tế mới nơi hiệu quả tính toán trực tiếp chuyển đổi thành khả năng kinh doanh.

Nâng Cấp Kiến Trúc Blackwell: Thông Số Kỹ Thuật Và Thước Đo Hiệu Suất GB300

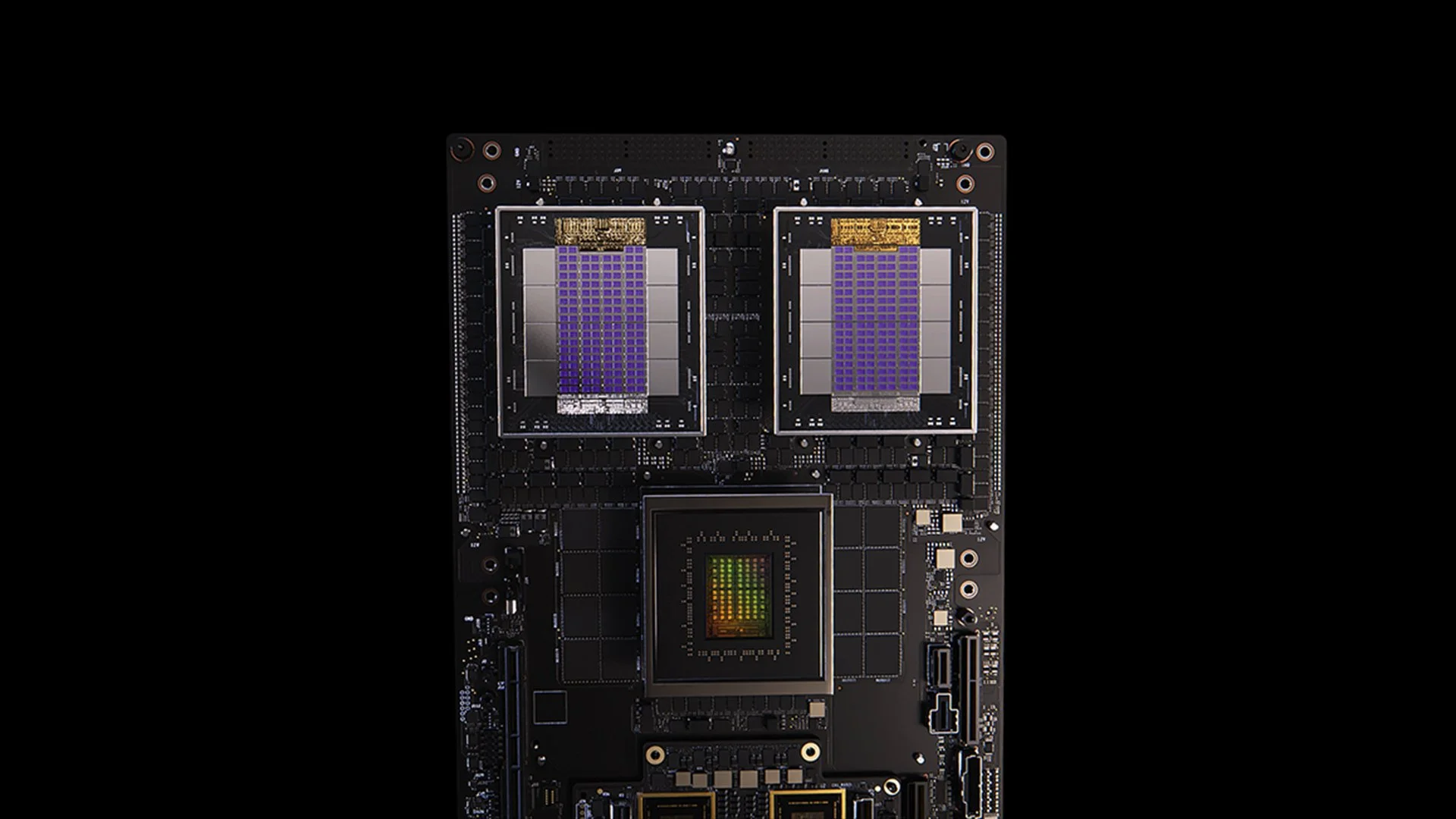

[caption id="" align="alignnone" width="1280"] Hệ thống GB200 [/caption]

Hệ thống GB200 [/caption]

Bản cập nhật GB300 cho kiến trúc Blackwell minh chứng cho chu kỳ cải tiến hiệu suất không ngừng nghỉ của NVIDIA. Được lên kế hoạch cho Q3 2025, GB300 mang lại:

-

Tăng 1.5x hiệu suất inference so với GB200

-

Tăng 1.5x dung lượng bộ nhớ HBM

-

Cải thiện 2x băng thông mạng

-

Thiết kế làm mát bằng chất lỏng hoàn toàn

-

Tương thích ngược với khung gầm và hệ thống hiện có

Mỗi node GB300 cung cấp khoảng 40 petaflops—thực sự thay thế toàn bộ siêu máy tính Sierra (khoảng 2018), cần 18,000 GPU Volta. Mức tăng hiệu suất 4,000x trong vòng sáu năm này vượt xa việc mở rộng theo Định luật Moore truyền thống, thể hiện cách tiếp cận đa chiều của NVIDIA đối với tăng tốc hiệu suất thông qua kiến trúc, phần mềm và đổi mới kết nối.

MVLink: Định Nghĩa Lại Công Nghệ Kết Nối

MVLink đại diện cho tiến bộ quan trọng nhất trong công nghệ kết nối GPU kể từ khi giới thiệu NVLink. Hệ thống cho phép tách biệt hoàn toàn các tài nguyên điện toán trên toàn bộ rack, biến 72 GPU (144 die GPU) thành một đơn vị tính toán khổng lồ duy nhất.

Thông số kỹ thuật thật đáng kinh ngạc:

-

Các switch MVLink riêng lẻ: băng thông 7.2 TB/s

-

MVLink spine: băng thông all-to-all 130 TB/s

-

Triển khai vật lý: 5,000 cáp đồng trục được khớp độ dài chính xác (tổng cộng khoảng 2 dặm)

-

Mật độ điện: 120 kilowatt mỗi rack (cần thiết phải làm mát bằng chất lỏng)

Để so sánh, Huang lưu ý rằng lưu lượng đỉnh của toàn bộ internet là khoảng 900 terabit mỗi giây (112.5 TB/s), khiến một MVLink spine duy nhất có khả năng xử lý nhiều lưu lượng hơn internet toàn cầu ở công suất đỉnh.

MVLink Fusion: Tạo Ra Hệ Sinh Thái Hạ Tầng AI Mở

MVLink Fusion có thể là động thái hệ sinh thái sáng tạo nhất mà NVIDIA đã thực hiện trong nhiều năm. Thay vì buộc các đối tác phải cam kết hoàn toàn với phần cứng NVIDIA, họ đang mở kiến trúc để cho phép các công ty xây dựng hệ thống AI bán tùy chỉnh vẫn liên kết với vũ trụ NVIDIA.

Cách tiếp cận này linh hoạt một cách đáng ngạc nhiên:

-

Tích Hợp ASIC Tùy Chỉnh: Có bộ gia tốc chuyên dụng? Không vấn đề. Đối tác có thể thả các chiplet MVLink để kết nối silicon tùy chỉnh của họ với hệ sinh thái NVIDIA. Giống như NVIDIA nói rằng, "Xây dựng bất kỳ phần cứng chuyên dụng nào bạn muốn—chỉ cần đảm bảo nó có thể giao tiếp với đồ của chúng tôi."

-

Tích Hợp CPU Tùy Chỉnh: Các nhà cung cấp CPU cũng không bị loại bỏ. Họ có thể trực tiếp triển khai giao diện chip-to-chip của MVLink, tạo ra một đường cao tốc trực tiếp giữa bộ xử lý của họ và GPU Blackwell (hoặc kiến trúc Ruben sắp tới). MVLink rất lớn cho các công ty đầu tư vào kiến trúc CPU cụ thể.

Thông báo đối tác bao trùm ngành công nghiệp bán dẫn:

-

Đối tác triển khai silicon: LCHIP, Astera Labs, Marll, MediaTek

-

Nhà cung cấp CPU: Fujitsu, Qualcomm

-

Nhà cung cấp EDA: Cadence, Synopsis

Cách tiếp cận này định vị NVIDIA một cách chiến lược để thu giá trị bất kể hỗn hợp phần cứng cụ thể mà khách hàng triển khai, phản ánh tuyên bố thẳng thắn của Huang: "Không có gì mang lại cho tôi niềm vui hơn là khi bạn mua tất cả từ NVIDIA. Tôi muốn các bạn biết điều đó. Nhưng nó mang lại cho tôi niềm vui to lớn nếu bạn mua cái gì đó từ NVIDIA."

Triển Khai AI Doanh Nghiệp: RTX Pro Enterprise Và Omniverse Server

RTX Pro Enterprise và server Omniverse đại diện cho dịch vụ điện toán tập trung doanh nghiệp quan trọng nhất của NVIDIA, được thiết kế đặc biệt để tích hợp khả năng AI vào môi trường IT truyền thống:

-

Kiến trúc tương thích x86 hoàn toàn

-

Hỗ trợ hypervisor truyền thống (VMware, Red Hat, Nanix)

-

Tích hợp Kubernetes cho điều phối workload quen thuộc

-

GPU Blackwell RTX Pro 6000s (8 mỗi server)

-

Chip mạng CX8 cung cấp băng thông 800 Gb/s

-

Tăng hiệu suất 1.7x so với Hopper H100

-

Hiệu suất 4x trên các mô hình được tối ưu hóa như Deepseek R1

Hệ thống thiết lập một phạm vi hiệu suất mới cho inference AI, được đo trong khung hai trục của throughput (token mỗi giây) và khả năng phản hồi (token mỗi giây mỗi người dùng)—các thước đo quan trọng cho cái mà Huang mô tả là kỷ nguyên của "inference time scaling" hay "thinking AI."

Nền Tảng Dữ Liệu AI: Tái Tưởng Tượng Lưu Trữ Cho Dữ Liệu Phi Cấu Trúc

Nền Tảng Dữ Liệu AI của NVIDIA giới thiệu một cách tiếp cận khác biệt căn bản đối với lưu trữ doanh nghiệp:

"Con người truy vấn cơ sở dữ liệu có cấu trúc như SQL... Nhưng AI muốn truy vấn dữ liệu phi cấu trúc. Họ muốn ngữ nghĩa. Họ muốn ý nghĩa. Và vì vậy chúng ta phải tạo ra một loại nền tảng lưu trữ mới."

Các thành phần chính bao gồm:

-

NVIDIA AIQ (hoặc IQ): Một lớp truy vấn ngữ nghĩa

-

Các node lưu trữ được gia tốc GPU thay thế kiến trúc CPU-centric truyền thống

-

Các mô hình AI được hậu huấn luyện với nguồn gốc dữ liệu huấn luyện minh bạch

-

Truy vấn nhanh hơn 15x với kết quả cải thiện 50% so với các giải pháp hiện có

Các đối tác ngành lưu trữ triển khai kiến trúc này bao gồm Dell, Hitachi, IBM, NetApp, và Vast, tạo ra một hệ sinh thái quản lý dữ liệu AI doanh nghiệp toàn diện.

AI Operations Và Robotics: Khung Phần Mềm Cho Doanh Nghiệp Thông Minh

Bài phát biểu chính giới thiệu hai khung phần mềm quan trọng:

-

AI Operations (AIOps): Một stack toàn diện để quản lý các AI agent trong ngữ cảnh doanh nghiệp, bao gồm curation dữ liệu, fine-tuning mô hình, đánh giá, guardrails, và bảo mật. Đối tác bao gồm Crowdstrike, Data IQ, Data Robots, Elastic, Newonix, Red Hat, và Trend Micro.

-

Isaac Groot Platform N1.5: Một hệ sinh thái phát triển robotics mã nguồn mở bao gồm:

Engine vật lý Newton (được phát triển với Google DeepMind và Disney Research)

-

Bộ xử lý robotics Jetson Thor

-

Hệ điều hành NVIDIA Isaac

-

Kế hoạch chi tiết NVIDIA Groot Dreams để tạo dữ liệu quỹ đạo tổng hợp

Sáng kiến robotics giải quyết một thách thức quan trọng: "Để robotics xảy ra, bạn cần AI. Nhưng để dạy AI, bạn cần AI." Mô hình tối ưu hóa đệ quy này tận dụng AI tạo sinh để mở rộng dữ liệu trình diễn con người hạn chế thành bộ dữ liệu huấn luyện robotics toàn diện.

Vị Thế Chiến Lược Của Đài Loan Trong Cuộc Cách Mạng Sản Xuất AI

Một phần đáng kể của bài phát biểu chính làm nổi bật vai trò then chốt của Đài Loan trong cả việc sản xuất và triển khai công nghệ AI:

-

Các công ty sản xuất Đài Loan (TSMC, Foxconn, Wistron, Pegatron, Delta Electronics, Quanta, Wiiwin, Gigabyte) đang triển khai NVIDIA Omniverse cho việc triển khai digital twin.

-

TSMC đang sử dụng các công cụ được hỗ trợ AI trên CUDA để tối ưu hóa bố cục fab và hệ thống đường ống

-

Các đối tác sản xuất sử dụng digital twin cho lập kế hoạch ảo và bảo trì dự đoán và như "phòng tập robot" để huấn luyện hệ thống robotics.

-

Foxconn, TSMC, chính phủ Đài Loan, và NVIDIA đang xây dựng siêu máy tính AI quy mô lớn đầu tiên của Đài Loan.

Huang tiếp tục củng cố cam kết của NVIDIA với khu vực bằng cách thông báo kế hoạch cho "NVIDIA Constellation," một cơ sở trụ sở mới tại Đài Bắc.

Phân Tích Kỹ Thuật: Ý Nghĩa Đối Với Chiến Lược AI Doanh Nghiệp

Những thông báo này tập thể đại diện cho việc tái tưởng tượng toàn diện điện toán doanh nghiệp với một số hàm ý chiến lược:

-

Yêu Cầu Quy Mô Tính Toán: Nhu cầu hiệu suất inference-time của "reasoning AI" và hệ thống agentic sẽ thúc đẩy yêu cầu điện toán cao hơn đáng kể so với triển khai mô hình ngôn ngữ lớn ban đầu, đòi hỏi lập kế hoạch kiến trúc cho khả năng scale-up và scale-out lớn.

-

Phân Tách AI Doanh Nghiệp: Hệ sinh thái MVLink Fusion cho phép tính linh hoạt chưa từng có trong việc xây dựng hệ thống AI không đồng nhất, có khả năng tăng tốc việc áp dụng bộ gia tốc AI chuyên dụng trong khi duy trì vị thế của NVIDIA trong hệ sinh thái thông qua công nghệ kết nối.

-

Chuyển Đổi Từ Trung Tâm Dữ Liệu Sang Nhà Máy AI: Chúng ta cần suy nghĩ lại hoàn toàn về cách đo lường giá trị của các khoản đầu tư hạ tầng. Thời đại mà khả năng điện toán thô hay lưu trữ kể toàn bộ câu chuyện đã qua. Bây giờ tất cả là về sản xuất token—bao nhiêu đơn vị đầu ra AI mà hệ thống của bạn có thể tạo ra mỗi giây, mỗi watt, và mỗi đô la? Jensen không đùa khi nói các công ty sẽ sớm báo cáo sản xuất token của họ, như các thước đo sản xuất. Sự chuyển đổi sang nhà máy AI sẽ viết lại cơ bản kinh tế học về cách chúng ta triển khai và biện minh chi tiêu hạ tầng AI.

-

Tích Hợp Digital Twin: Việc mọi nhà sản xuất lớn của Đài Loan đều xây dựng digital twin Omniverse nói lên tất cả—đây không còn chỉ là demo công nghệ thú vị nữa. Digital twin đã trở thành hạ tầng thiết yếu cho các công ty nghiêm túc về tối ưu hóa. Điều đặc biệt hấp dẫn là cách này tạo ra một vòng phản hồi: công ty xây dựng digital twin để tối ưu hóa quy trình vật lý, sau đó sử dụng chính những môi trường đó để huấn luyện AI và robotics, tiếp tục cải thiện thế giới vật lý. Đây là một chu kỳ cải tiến liên tục tiếp tục tăng tốc.

-

Lập Kế Hoạch Lực Lượng Lao Động Robot: Sự hội tụ của agentic AI và robotics vật lý gợi ý các tổ chức nên phát triển các chiến lược tự động hóa kỹ thuật số và vật lý tích hợp, với hàm ý quan trọng cho lập kế hoạch lực lượng lao động và thiết kế cơ sở.

-

Hạ Tầng Được Định Nghĩa Bởi Phần Mềm: Bất chấp các thông báo phần cứng, sự nhấn mạnh liên tục của NVIDIA về thư viện và khung phần mềm củng cố rằng lợi thế cạnh tranh trong AI sẽ đến từ tối ưu hóa phần mềm nhiều như khả năng phần cứng thô.

Điều Hướng Quá Trình Chuyển Đổi Nhà Máy AI

Chuyển đổi các trung tâm dữ liệu truyền thống thành nhà máy AI đòi hỏi chuyên môn chuyên dụng kết nối triển khai phần cứng, tối ưu hóa phần mềm, và thiết kế kiến trúc. Tại Introl, chúng tôi đã triển khai những giải pháp hạ tầng GPU tiên tiến này cho các doanh nghiệp nhảy vào điện toán AI-first. Kinh nghiệm sâu sắc của đội ngũ chúng tôi với hệ sinh thái NVIDIA—từ triển khai MVLink phức tạp đến triển khai digital twin Omniverse—giúp các tổ chức điều hướng sự thay đổi mô hình này mà không có đường cong học tập dốc thường liên quan với hạ tầng tiên tiến. Dù mở rộng khả năng reasoning AI hay xây dựng sàn nhà máy AI đầu tiên của bạn, hợp tác với các chuyên gia có thể tăng tốc đáng kể thời gian tạo giá trị của bạn trong bối cảnh phát triển nhanh chóng này. Sẵn sàng **hoàn thành công việc? Đặt lịch gọi ngay hôm nay.

Kết Luận: Kỷ Nguyên Thứ Ba Của Điện Toán Đã Đến

Computex không chỉ là NVIDIA khoe chip nhanh hơn. Những gì Jensen trình bày đã vượt qua những thông báo thông thường "tốt hơn 20% so với năm ngoái" mà chúng ta đã trở nên tê liệt. Ông đang đóng khung lại một cách căn bản những gì máy tính được tạo ra để làm. Chúng ta đã dành nhiều thập kỷ xây dựng máy móc xử lý số và di chuyển dữ liệu xung quanh. Bây giờ, NVIDIA đang xây dựng hệ thống sản xuất trí tuệ như đầu ra chính của chúng. Giống như so sánh một tủ hồ sơ với một bộ não. Chắc chắn, cả hai đều lưu trữ thông tin, nhưng một cái chỉ ngồi đó trong khi cái kia tạo ra ý tưởng mới. Sự thay đổi có thể nghe như ngữ nghĩa cho đến khi bạn nhận ra nó thay đổi mọi thứ về cách chúng ta xây dựng, triển khai, và đo lường hệ thống điện toán.

"Lần đầu tiên trong tất cả thời gian chúng ta ở bên nhau, chúng ta không chỉ tạo ra thế hệ IT tiếp theo, mà chúng ta cũng đã làm điều đó nhiều lần, từ PC đến internet đến cloud đến mobile cloud. Chúng ta đã làm điều đó nhiều lần. Nhưng lần này, chúng ta không chỉ tạo ra thế hệ IT tiếp theo, chúng ta đang tạo ra một ngành công nghiệp hoàn toàn mới."

Sự chuyển đổi này đại diện cho sự thay đổi mô hình điện toán lớn thứ ba, sau cuộc cách mạng máy tính cá nhân và kỷ nguyên internet/cloud. Các tổ chức tích hợp những khả năng hạ tầng AI này có khả năng thiết lập lợi thế cạnh tranh không thể vượt qua trên các ngành.

Các nhà máy của trí tuệ tính toán đang được xây dựng ngày hôm nay. Câu hỏi không còn là liệu AI có chuyển đổi kinh doanh hay không—mà là liệu tổ chức của bạn có đang xây dựng hạ tầng để duy trì cạnh tranh trong một thế giới nơi trí tuệ tính toán trở nên cơ bản đối với hoạt động kinh doanh như điện.

Tài Liệu Tham Khảo Và Tài Nguyên Bổ Sung

-

NVIDIA Official Blackwell Architecture Overview: https://www.nvidia.com/en-us/data-center/technologies/blackwell-architecture/

-

NVIDIA MVLink Technical Documentation: https://developer.nvidia.com/mvlink

-

NVIDIA Omniverse Platform: https://www.nvidia.com/en-us/omniverse/

-

Isaac Robotics Platform: https://developer.nvidia.com/isaac-ros

-

NVIDIA AI Enterprise: https://www.nvidia.com/en-us/data-center/products/ai-enterprise/

-

NVIDIA Computex 2025 Official Press Materials: https://nvidianews.nvidia.com/news/computex-2025

-

NVIDIA CUDA-X Libraries Overview: https://developer.nvidia.com/gpu-accelerated-libraries

-

NVIDIA DGX Systems: https://www.nvidia.com/en-us/data-center/dgx-systems/